Слайд 1Математические методы в психологии

Слайд 2Рекомендуемая литература

Наследов, А.Д. Математические методы психологического исследования. Анализ и интерпретация

данных. – СПб. : Речь, 2004. – 392 с.

Сидоренко, Е.В.

Методы математической обработки в психологии. – СПб. : Речь, 2001. – 350 с.

Кутейников, А.Н. Математические методы в психологии. – СПб. : Речь, 2008. – 172с.

Тюменева, Ю.А. Психологическое измерение. – М. : Аспект Пресс, 2007. – 192 с.

Халафян, А.А. STATISTICA 6. Статистический анализ данных. – М. : Бином-Пресс, 2007. – 512 с.

Боровиков, И.П. Боровиков В.П. Статистический анализ и обработка данных в среде Windows. – М. : Информационно-издательский дом Филинъ, 1998. – 608 с.

Слайд 3Тема 1. Измерение в психологии

Предмет и назначение дисциплины

Измерение в психологии.

Взаимоотношение параметров, признаков, показателей и переменных.

Шкалы измерений по С. Стивенсону

Слайд 4Определение статистики

Термин «статистика» имеет несколько значений:

∙ это совокупность данных и

сведений, посвященных какому-либо вопросу, в этом значении он используется во

многих международных и национальных изданиях, примером чего может служить «Ежегодник мировой санитарной статистики», «статистика, заболеваемости и смертности»; старое значение слова «статистика», как один из разделов науки об управлении государством, сбор, классификация и обсуждение сведений об обществе и государстве.

∙ это описательные или дистрибутивные характеристики описывающие какую то совокупность данных, по каким то параметрам (средняя, дисперсия и так далее);

и наконец статистика (или математическая статистика) это научная дисциплина, изучающая методы сбора и обработки фактов и данных, относящихся к человеческой деятельности и природным явлениям (из Оксфордского словаря английского языка).

Слайд 5Соотношение обыденного и научного познания

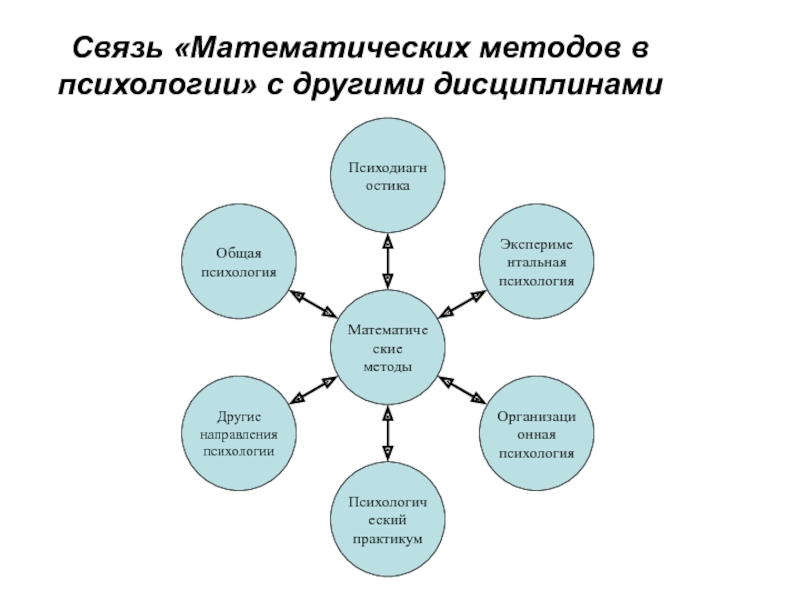

Слайд 6Связь «Математических методов в психологии» с другими дисциплинами

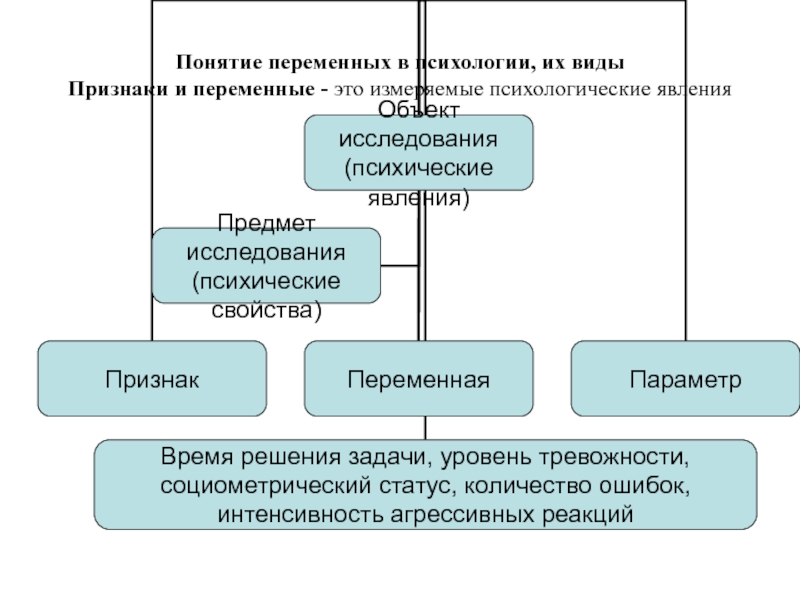

Слайд 7Понятие переменных в психологии, их виды

Признаки и переменные -

это измеряемые психологические явления

Слайд 8Измерение — это приписывание объекту числа по определенному правилу. Это

правило устанавливает соответствие между измеряемым свойством объекта и результатом измерения

— признаком.

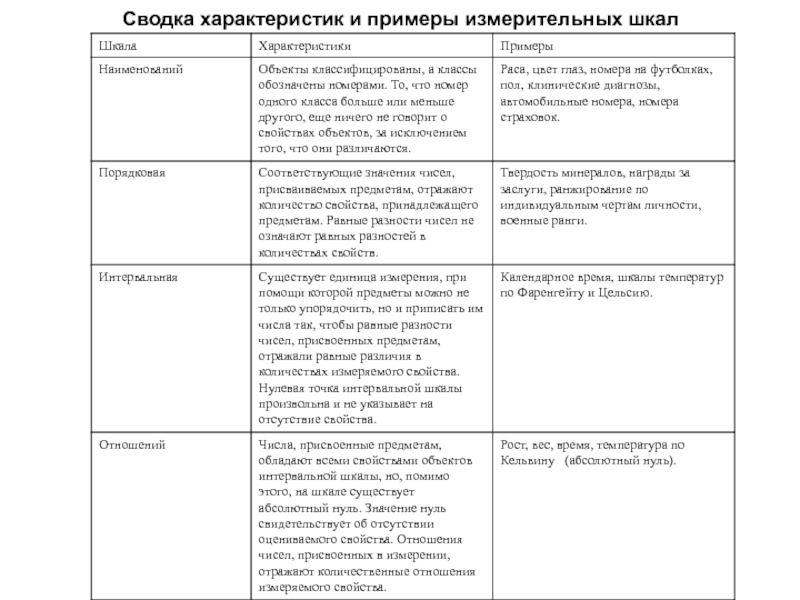

Слайд 9Сводка характеристик и примеры измерительных шкал

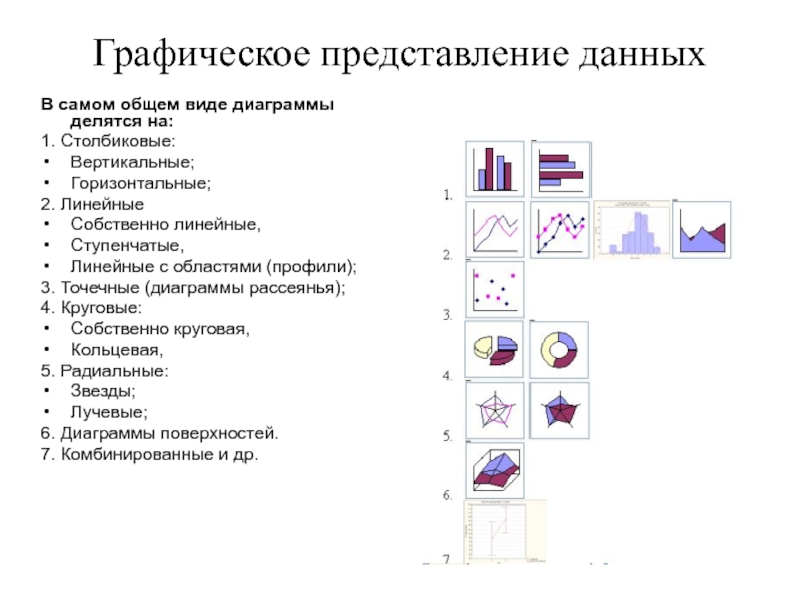

Слайд 12Графическое представление данных

В самом общем виде диаграммы делятся на:

1. Столбиковые:

Вертикальные;

Горизонтальные;

2.

Линейные

Собственно линейные,

Ступенчатые,

Линейные с областями (профили);

3. Точечные (диаграммы рассеянья);

4. Круговые:

Собственно круговая,

Кольцевая,

5.

Радиальные:

Звезды;

Лучевые;

6. Диаграммы поверхностей.

7. Комбинированные и др.

Слайд 13Правила графического оформления

Вся структура графика предполагает его чтение слева направо,

вертикальные шкалы — снизу вверх.

Чтобы диаграмма не получилась сплющенной или

вытянутой, выбирают такой масштаб шкалы, чтобы соотношение высоты к ширине составляли 3 к 5.

На вертикальной шкале необходимо разместить нулевую отметку.

Пороговые точки на шкалах желательно выделить размером или цветом, но если речь идет о временном интервале, предпочтительно не указывать начальной и конечной точек.

Подобрать такой масштаб, чтобы кривые линии резко отличались от прямых, желательно включить в график цифровые данные и изображение формулы, а при необходимости — использовать ясные, полные заголовки и подзаголовки как для самой диаграммы, так и для ее осей.

Слайд 14Правила табличного представления первичных данных

Вся структура таблицы предполагает ее чтение

слева направо.

В первом столбце предполагается размещение испытуемых.

В последующие столбцах располагаются

значения по признакам, полученные после проведения психодиагностической процедуры.

Слайд 15Тема 3.

Способы представления данных в психологии

Представление данных.

Понятие о квантилях.

Понятие

о рангах. Процедура ранжирования.

Табулирование данных.

Графическое представление данных.

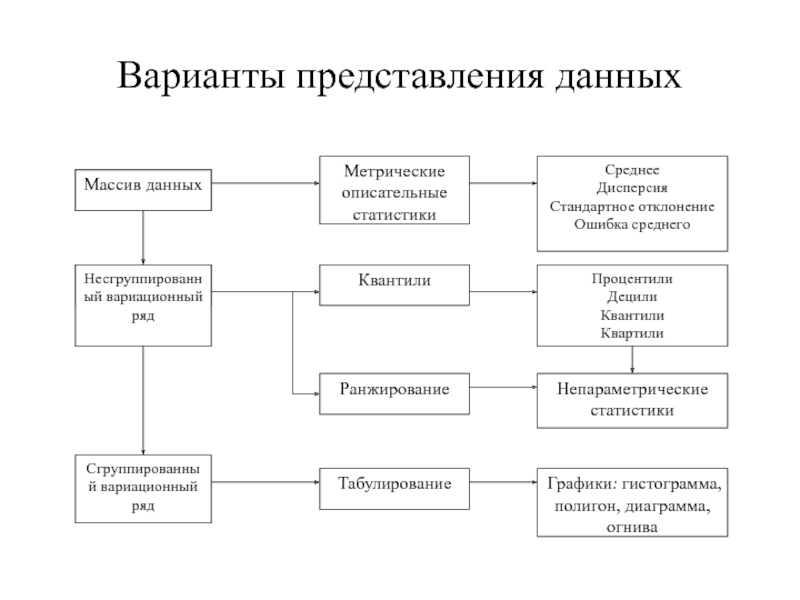

Слайд 16Представление данных в психологии бывает в виде:

Массив данных – первичные

результаты измерения искомых параметров сводятся в одну таблицу.

Несгруппированный вариационный ряд

– упорядочение всех значений переменной от минимального до максимального.

Сгруппированный вариационный ряд – вариационный ряд сворачивают, указывая все полученные значения однократно, а в соседнем столбце указывают частоту, с которой встречается данная оценка

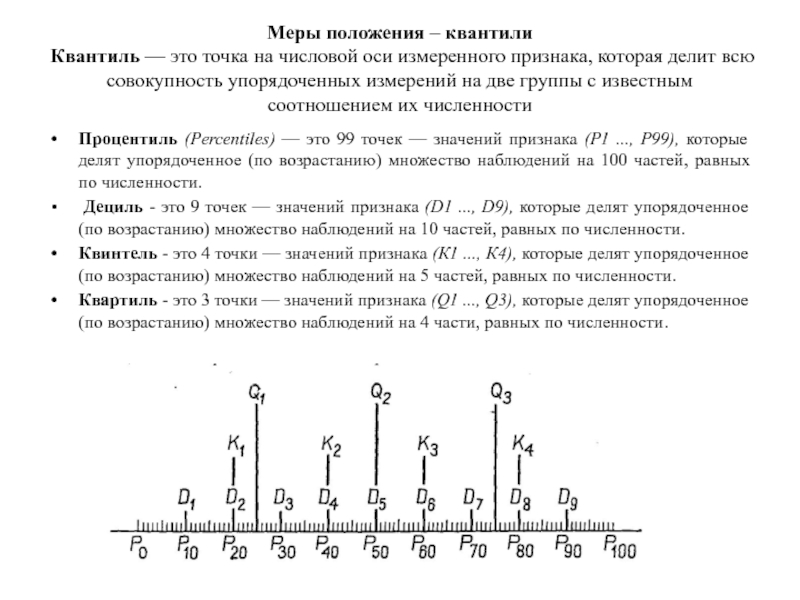

Слайд 18Меры положения – квантили

Квантиль — это точка на числовой оси

измеренного признака, которая делит всю совокупность упорядоченных измерений на две

группы с известным соотношением их численности

Процентиль (Percentiles) — это 99 точек — значений признака (Р1 ..., Р99), которые делят упорядоченное (по возрастанию) множество наблюдений на 100 частей, равных по численности.

Дециль - это 9 точек — значений признака (D1 ..., D9), которые делят упорядоченное (по возрастанию) множество наблюдений на 10 частей, равных по численности.

Квинтель - это 4 точки — значений признака (К1 ..., К4), которые делят упорядоченное (по возрастанию) множество наблюдений на 5 частей, равных по численности.

Квартиль - это 3 точки — значений признака (Q1 ..., Q3), которые делят упорядоченное (по возрастанию) множество наблюдений на 4 части, равных по численности.

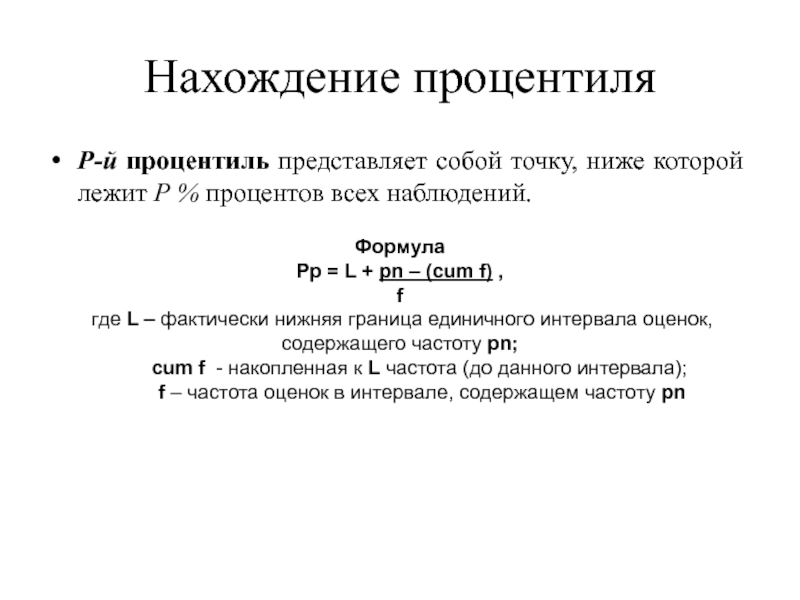

Слайд 19Нахождение процентиля

Р-й процентиль представляет собой точку, ниже которой лежит Р

% процентов всех наблюдений.

Формула

Pp = L + pn – (cum

f) ,

f

где L – фактически нижняя граница единичного интервала оценок, содержащего частоту pn;

cum f - накопленная к L частота (до данного интервала);

f – частота оценок в интервале, содержащем частоту pn

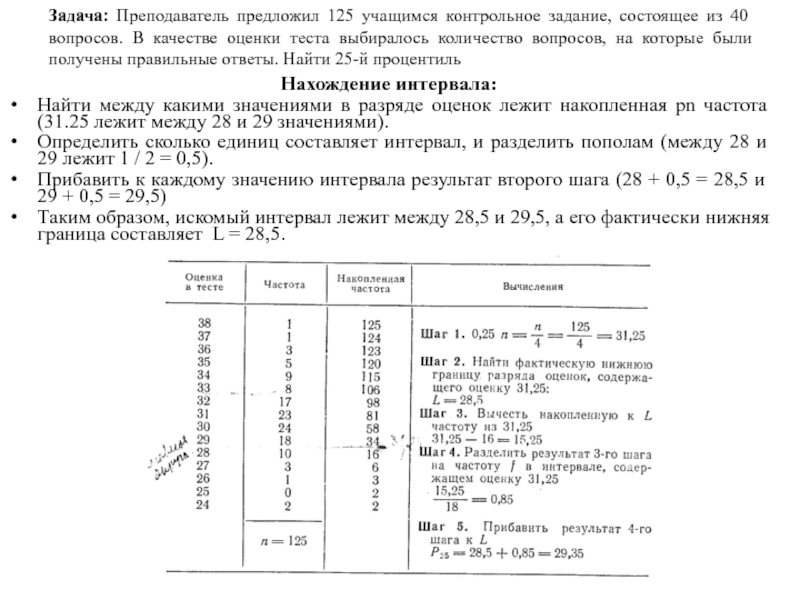

Слайд 20Задача: Преподаватель предложил 125 учащимся контрольное задание, состоящее из 40

вопросов. В качестве оценки теста выбиралось количество вопросов, на которые

были получены правильные ответы. Найти 25-й процентиль

Нахождение интервала:

Найти между какими значениями в разряде оценок лежит накопленная pn частота (31.25 лежит между 28 и 29 значениями).

Определить сколько единиц составляет интервал, и разделить пополам (между 28 и 29 лежит 1 / 2 = 0,5).

Прибавить к каждому значению интервала результат второго шага (28 + 0,5 = 28,5 и 29 + 0,5 = 29,5)

Таким образом, искомый интервал лежит между 28,5 и 29,5, а его фактически нижняя граница составляет L = 28,5.

Слайд 21Ранговый порядок

Ранжирование – это приписывание объектам чисел в зависимости

от степени выраженности измеряемого свойства

Установите для себя и запомните

порядок ранжирования. Вы можете ранжировать испытуемых по их «месту в группе»: ранг 1 присваивается тому, у которого наименьшая выраженность признака, и далее — увеличение ранга по мере увеличения уровня признака. Или можно ранг 1 присваивать тому, у которого 1-е место по выраженности данного признака (например, «самый быстрый»). Строгих правил выбора здесь нет, но важно помнить, в каком направлении производилось ранжирование.

Соблюдайте правило ранжирования для связанных рангов, когда двое или более испытуемых имеют одинаковую выраженность измеряемого свойства. В этом случае таким испытуемым присваивается один и тот же, средний ранг. Например, если вы ранжируете испытуемых по «месту в группе» и двое имеют одинаковые самые высокие исходные оценки, то обоим присваивается средний ранг 1,5: (1+2)/2 = 1,5. Следующему за этой парой испытуемому присваивается ранг 3, и т. д.

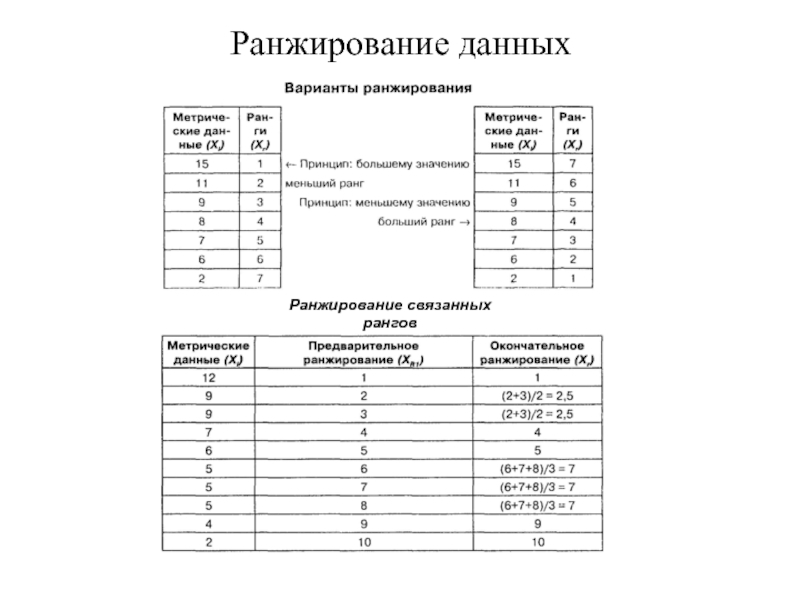

Слайд 22Ранжирование данных

Ранжирование связанных рангов

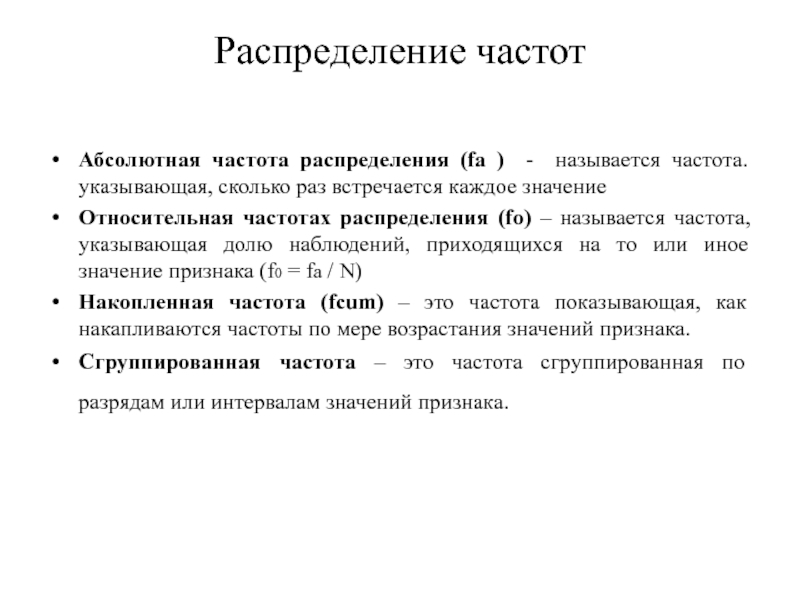

Слайд 23Распределение частот

Абсолютная частота распределения (fa ) - называется частота. указывающая,

сколько раз встречается каждое значение

Относительная частотах распределения (fо) – называется

частота, указывающая долю наблюдений, приходящихся на то или иное значение признака (f0 = fa / N)

Накопленная частота (fсum) – это частота показывающая, как накапливаются частоты по мере возрастания значений признака.

Сгруппированная частота – это частота сгруппированная по разрядам или интервалам значений признака.

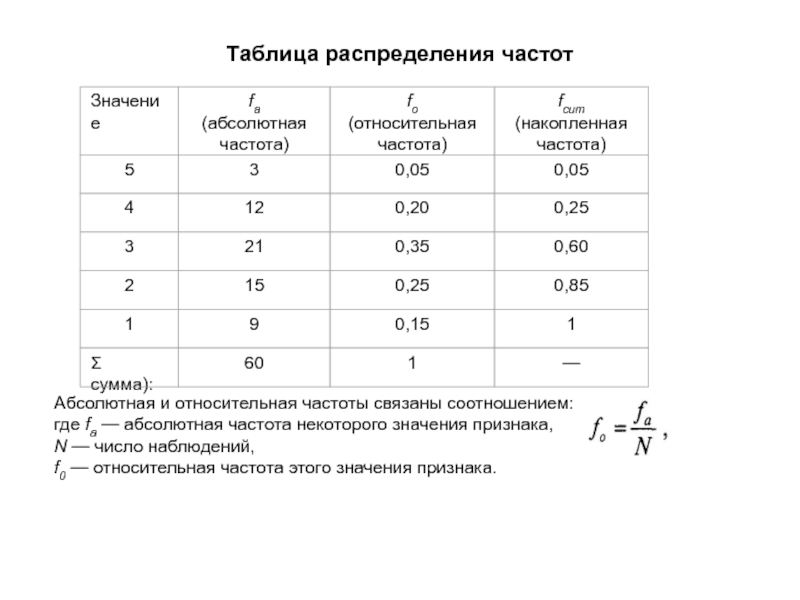

Слайд 24Таблица распределения частот

Абсолютная и относительная частоты связаны соотношением:

где fa —

абсолютная частота некоторого значения признака,

N — число наблюдений,

f0

— относительная частота этого значения признака.

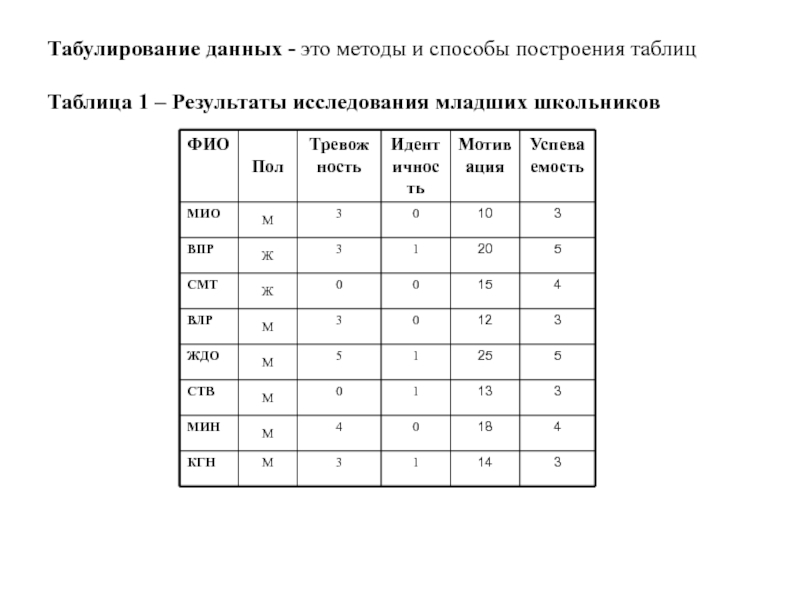

Слайд 25Табулирование данных - это методы и способы построения таблиц

Таблица 1

– Результаты исследования младших школьников

Слайд 26Этапы построения распределения сгруппированных частот

Уточнение лимитов (крайних значений интервала) –

производится округление лимитов - min и max значений: реальные лимиты

max = 67и min = 32, уточненные лимиты max = 70 и min = 30.

Определение размаха: мах – мин = 70-30 = 40

Выбор желаемой ширины интервала разрядов l - наиболее удобной шириной интервала разрядов в является l = 5.

Определение числа разрядов. Размах делится на интервал разряда: 40/5 = 8, получаем число разрядов — 8.

Расчет границ интервалов, посредством прибавления к нижней границе ширину интервала.

Подсчет абсолютной, относительной и накопленной частот

Слайд 27Графическое представление

Гистограмма – это последовательность столбцов, каждый из которых

опирается на один раздельный интервал, а высота столбца отражает количество

случаев.

Вариационная кривая – линия соединяющая точки, соответствующие середине каждого разрядного интервала и частоте.

Полигон распределения – вариационная кривая с перпендикуляром линий до горизонтальной оси в середине каждого интервала.

Полигон накопленных частот (кумулята) – на оси ординат откладывают значения суммы всех случаев лежащих в данном интервале, так и всех предыдущих интервалов. Сглаженная линия описывает все эти значения.

Огива (процентильная кривая) – сглаженная линия, у которой по оси абсцисс (х) откладывают значения процентов (процентилей), а на оси ординат (у) – значения показателей.

Диаграмма – отражение в долевом отношении частот на круге.

Слайд 29Тема 4. Меры центральной тенденции

Определение меры центральной тенденции;

Мода;

Медиана;

Среднее;

Выбор и особенности

мер центральной тенденции.

Графическое соотношение среднего, моды, медианы

Слайд 30Меры центральной тенденции - предназначены для замены множества значений признака,

измеренного на выборке, одним числом и показывающие концентрацию группы значений

на числовой шкале

Слайд 31Мода (Mode) — это такое значение из множества измерений, которое

встречается наиболее часто.

Если все значения в группе встречаются одинаково

часто, то считают, что у данной выборки моды нет (3, 7, 4, 5, 2, 8, 1, 6 - Мо = 0).

Если график распределения частот имеет одну вершину, то такое распределение называется унимодальным (3, 7, 4, 5, 7, 8, 7, 6 - Мо = 7).

Когда два соседних значения встречаются одинаково часто и чаще, чем любое другое значение, мода есть среднее этих двух значений (3, 7, 4, 6, 7, 6, 8, 7, 6 - Мо = 6,5).

Если два несмежных значения имеют равную и наибольшую в данной группе частоту, то у такой группы есть две моды, и распределение называют бимодальным (3, 7, 3, 5, 7, 3, 7, 6, 7 - Мо = 7; Мо = 3).

Если в группе несколько значений, встречаются наиболее часто, при этом их частота может различаться, тогда выделяют наибольшую моду и локальные моды и такое распределение называют полимодальным (3, 7, 3, 5, 7, 3, 7, 6, 7, 10, 10. Наибольшая: Мо = 7; локальные: Мо = 3, Мо = 10).

Слайд 32Медиана (Median) — это такое значение признака, которое делит упорядоченное

множество данных пополам так, что одна половина всех значений оказывается

меньше медианы, а другая — больше.

Первым шагом при определении медианы является упорядочивание (ранжирование) всех значений по возрастанию или убыванию.

Если данные содержат нечетное число значений (8, 9, 10, 13, 15), то медиана есть центральное значение, т. е. Md= 10.

Если данные содержат четное число значений (5, 8, 9, 11), то медиана есть точка, лежащая посередине между двумя центральными значениями, т. е. М/=(8+9)/2 = 8,5.

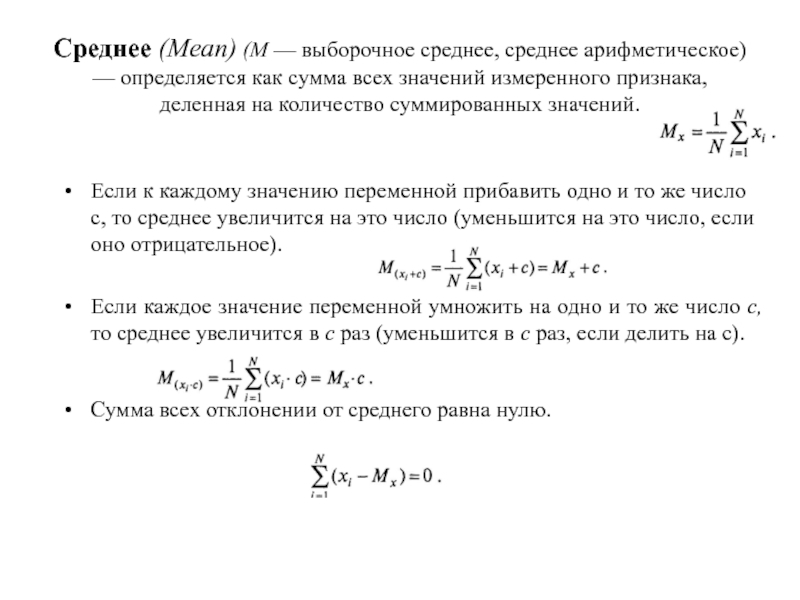

Слайд 33Среднее (Mean) (М — выборочное среднее, среднее арифметическое) — определяется

как сумма всех значений измеренного признака, деленная на количество суммированных

значений.

Если к каждому значению переменной прибавить одно и то же число с, то среднее увеличится на это число (уменьшится на это число, если оно отрицательное).

Если каждое значение переменной умножить на одно и то же число с, то среднее увеличится в с раз (уменьшится в с раз, если делить на с).

Сумма всех отклонений от среднего равна нулю.

Слайд 34Выбор и особенности мер центральной тенденции

Для номинативных данных единственной подходящей

мерой центральной тенденции является мода.

В малых группах мода нестабильна.

Для

метрических и порядковых данных наиболее подходящей мерой являются медиана и средняя арифметическая.

На медиану не влияет величины очень больших и очень малых значений

На величину среднего влияет каждое значение, оно чувствительно к «выбросам» — экстремально малым или большим значениям переменной.

Наиболее устойчива к выбросам средняя гармоническая , при расчете которой используются обратные величины.

Если распределение симметричное и унимодальное, то мода, средняя и медиана совпадают.

Слайд 35Графическое соотношение среднего, моды, медианы

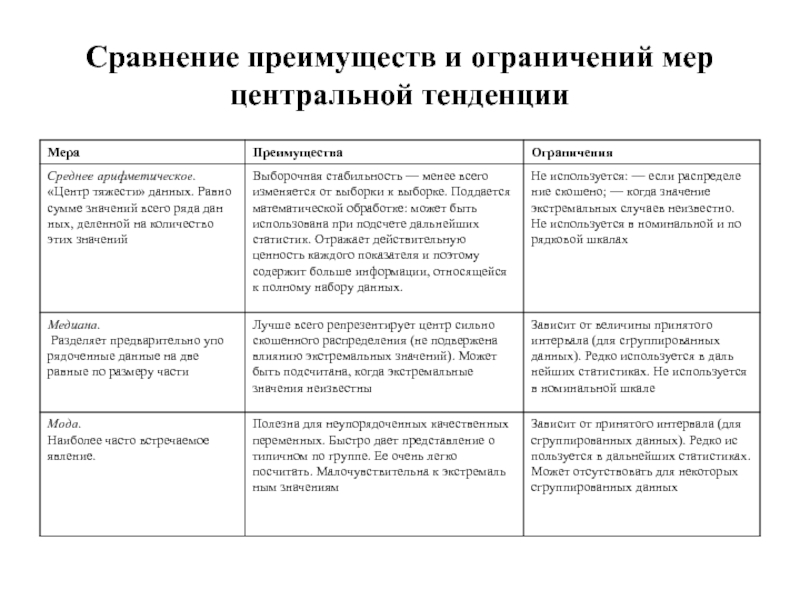

Слайд 36Сравнение преимуществ и ограничений мер центральной тенденции

Слайд 37Тема 5. Меры изменчивости

Понятие меры изменчивости

Лимиты. Размах вариации и его

разновидности.

Дисперсия и ее свойства.

Стандартное отклонение.

Асимметрия и эксцесс.

Слайд 39Меры рассеяния

независящие от распределения

Лимиты – это характеристики, определяющие верхнюю (max)

и нижнюю (min) границы значений показателя.

Размах (Range) — это разность

максимального и минимального значений: R = max – min.

Исключающий размах - это разность максимального и минимального значений в группе.

Включающий размах - это разность между естественной верхней границей интервала, содержащего максимальное значение, и естественной нижней границей интервала, включающей минимальное значение.

Размах это очень неустойчивая мера изменчивости, на которую влияют любые возможные «выбросы». Более устойчивыми являются разновидности размаха: размах от 10 до 90-го процентиля R = Р90 – Р10 или полумежквартильный размах:

Слайд 40Меры рассеяния

характеризующие нормальное распределение

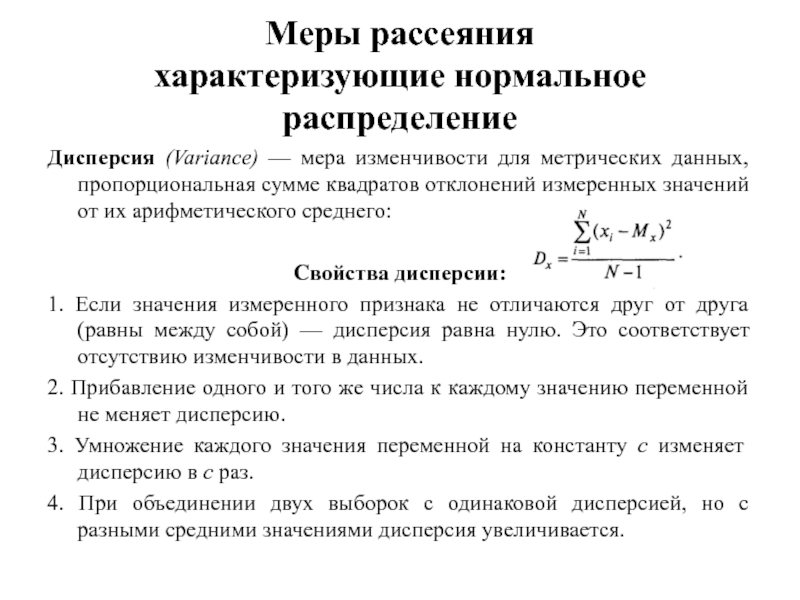

Дисперсия (Variance) — мера изменчивости для метрических

данных, пропорциональная сумме квадратов отклонений измеренных значений от их арифметического

среднего:

Свойства дисперсии:

1. Если значения измеренного признака не отличаются друг от друга (равны между собой) — дисперсия равна нулю. Это соответствует отсутствию изменчивости в данных.

2. Прибавление одного и того же числа к каждому значению переменной не меняет дисперсию.

3. Умножение каждого значения переменной на константу с изменяет дисперсию в с раз.

4. При объединении двух выборок с одинаковой дисперсией, но с разными средними значениями дисперсия увеличивается.

Слайд 42Меры рассеяния

характеризующие нормальное распределение

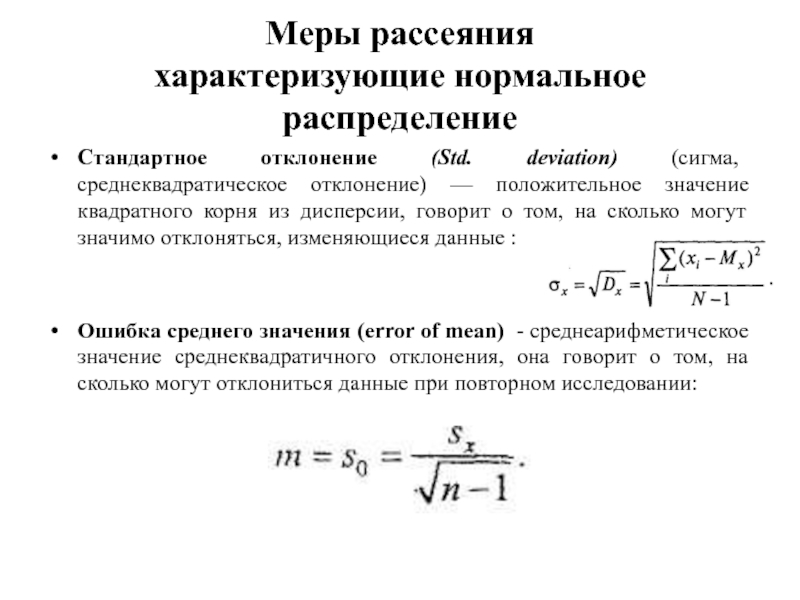

Стандартное отклонение (Std. deviation) (сигма, среднеквадратическое отклонение)

— положительное значение квадратного корня из дисперсии, говорит о том,

на сколько могут значимо отклоняться, изменяющиеся данные :

Ошибка среднего значения (error of mean) - среднеарифметическое значение среднеквадратичного отклонения, она говорит о том, на сколько могут отклониться данные при повторном исследовании:

Слайд 43Меры формы

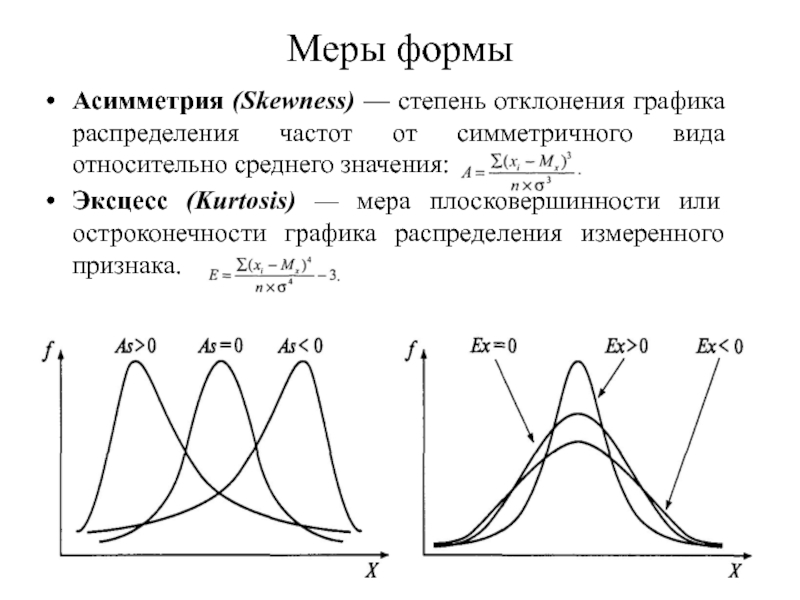

Асимметрия (Skewness) — степень отклонения графика распределения частот от

симметричного вида относительно среднего значения:

Эксцесс (Kurtosis) — мера плосковершинности

или остроконечности графика распределения измеренного признака.

Слайд 44Тема 6. Стандартизация данных

Понятие стандартизации данных.

Основные формы стандартизации.

z-преобразование данных.

Слайд 45Стандартизация (англ. standard нормальный) — унификация, приведение к единым нормативам

процедуры и оценок теста.

Различают две формы стандартизации

В первом

случае под С. понимаются обработка и регламентация процедуры проведения, унификация инструкции, бланков обследования, способов регистрации результатов, условий проведения обследования, характеристика контингентов испытуемых.

Во втором случае под С. понимается преобразование нормальной (или искусственно нормализованной) шкалы оценок в новую шкалу, основанную уже не на количественных эмпирических значениях изучаемого показателя, а на его относительном месте в распределении результатов в выборке испытуемых.

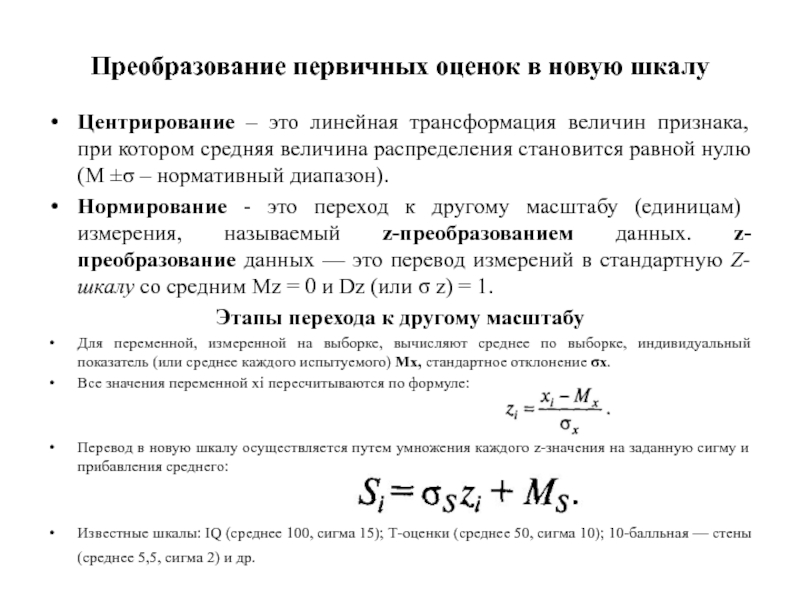

Слайд 46Преобразование первичных оценок в новую шкалу

Центрирование – это линейная трансформация

величин признака, при котором средняя величина распределения становится равной нулю

(М ±σ – нормативный диапазон).

Нормирование - это переход к другому масштабу (единицам) измерения, называемый z-преобразованием данных. z-преобразование данных — это перевод измерений в стандартную Z-шкалу со средним Mz = 0 и Dz (или σ z) = 1.

Этапы перехода к другому масштабу

Для переменной, измеренной на выборке, вычисляют среднее по выборке, индивидуальный показатель (или среднее каждого испытуемого) Мх, стандартное отклонение σх.

Все значения переменной хi пересчитываются по формуле:

Перевод в новую шкалу осуществляется путем умножения каждого z-значения на заданную сигму и прибавления среднего:

Известные шкалы: IQ (среднее 100, сигма 15); Т-оценки (среднее 50, сигма 10); 10-балльная — стены (среднее 5,5, сигма 2) и др.

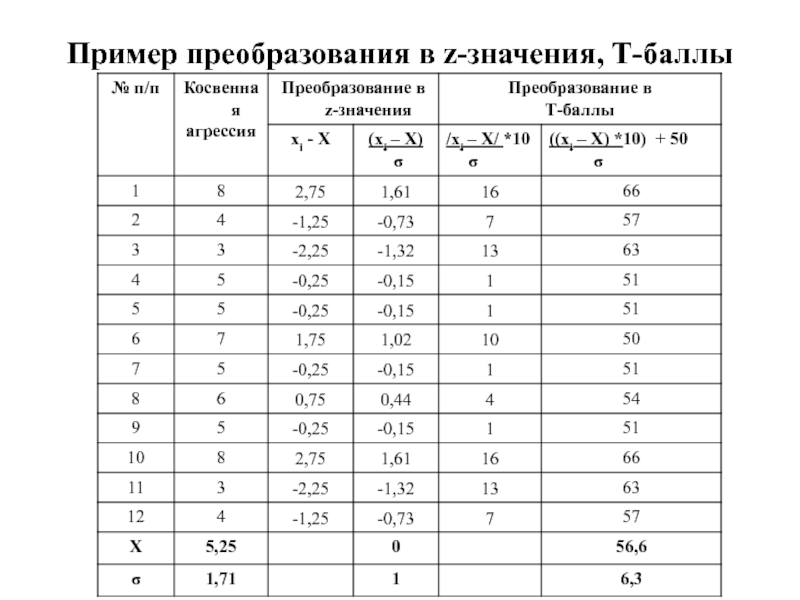

Слайд 47Пример преобразования в z-значения, Т-баллы

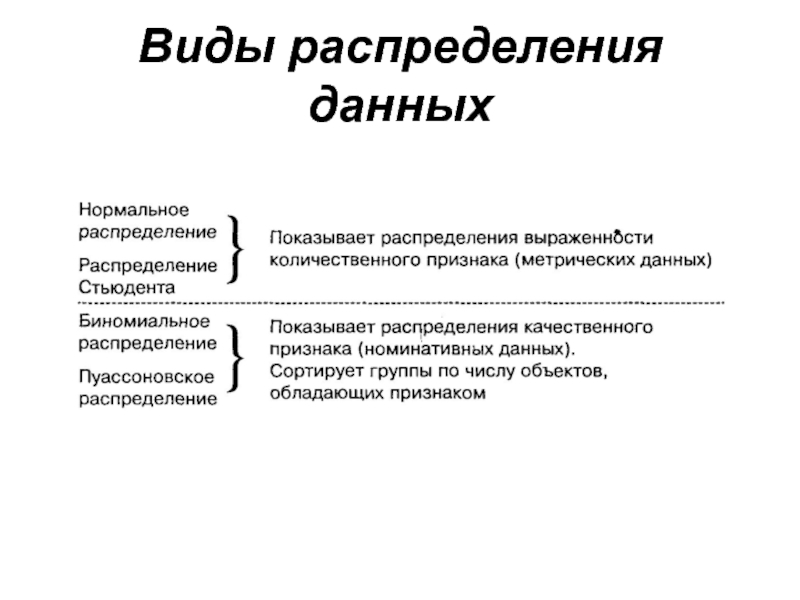

Слайд 48Тема 7. Теоретические распределения, используемые при статистических выводах

Нормальное распределение

Единичное

нормальное распределение и его свойства

Соответствия между диапазонами значений и площадью

под кривой

Проверка нормальности распределения

Слайд 50Нормальное распределение. Нормальный закон распределения состоит в том, что чаще

всего встречаются средние значения соответствующих показателей, и чем больше отклонение

от этой средней величины в меньшую или большую сторону встречаются одинаково реже чем среднее значение.

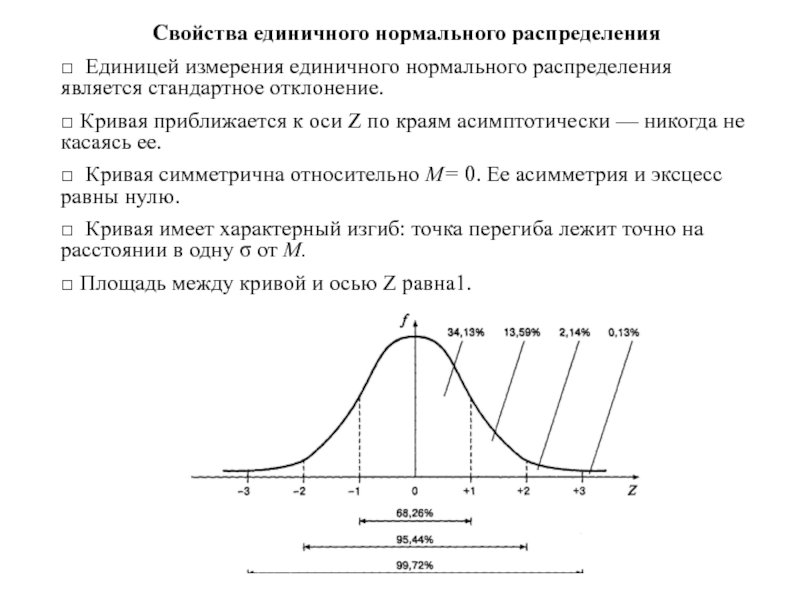

Слайд 51Единичное нормальное распределение и его свойства

Если применить z-преобразование ко

всем возможным измерениям свойств, все многообразие нормальных распределений может быть

сведено к одной кривой. Тогда каждое свойство будет иметь среднее 0 и стандартное отклонение 1. Это и есть единичное нормальное распределение, которое используется как стандарт — эталон.

Слайд 52Свойства единичного нормального распределения

□ Единицей измерения единичного нормального распределения является

стандартное отклонение.

□ Кривая приближается к оси Z пo краям асимптотически

— никогда не касаясь ее.

□ Кривая симметрична относительно М= 0. Ее асимметрия и эксцесс равны нулю.

□ Кривая имеет характерный изгиб: точка перегиба лежит точно на расстоянии в одну σ от М.

□ Площадь между кривой и осью Z paвна1.

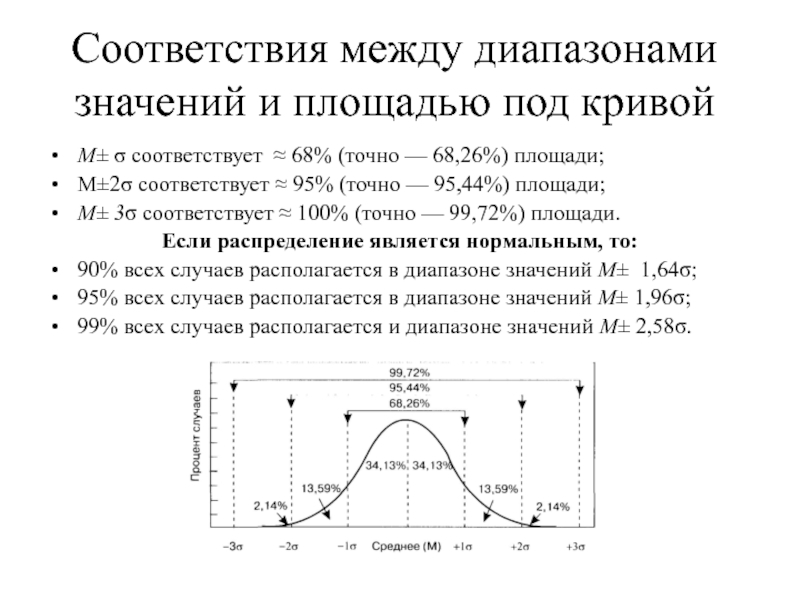

Слайд 53Соответствия между диапазонами значений и площадью под кривой

М± σ соответствует

≈ 68% (точно — 68,26%) площади;

М±2σ соответствует ≈ 95% (точно

— 95,44%) площади;

М± 3σ соответствует ≈ 100% (точно — 99,72%) площади.

Если распределение является нормальным, то:

90% всех случаев располагается в диапазоне значений М± 1,64σ;

95% всех случаев располагается в диапазоне значений М± 1,96σ;

99% всех случаев располагается и диапазоне значений М± 2,58σ.

Слайд 54Проверка нормальности распределения

1. Нормальность распределения результативного признака можно проверить путем

расчета показателей асимметрии и эксцесса по Н.А. Плохинскому, которые определяется

по формулам:

где |A| - абсолютная величина асимметрии;

mA – стандартная ошибка асимметрии.

где |Е| - абсолютная величина эксцесса;

mЕ – стандартная ошибка

Показатели асимметрии и эксцесса свидетельствуют о достоверном отличии эмпирических распределений от нормального в том случае, если они превышают по абсолютной величине свою ошибку репрезентативности в 3 и более раз. Все значения tA и tE не превышают свою ошибку репрезентативности в три раза, из чего можно заключить, что распределение признака не отличается от нормального.

,

,

Слайд 552. Еще одним из критериев проверки на нормальность - является

критерий Колмагорова-Смирнова.

Он позволяет оценить вероятность того, что данная выборка

принадлежит генеральной совокупности с нормальным распределением.

Вероятность р ≤ 0,05, распределение отличается от нормального.

Вероятность р > 0,05, распределение соответствует нормальному.

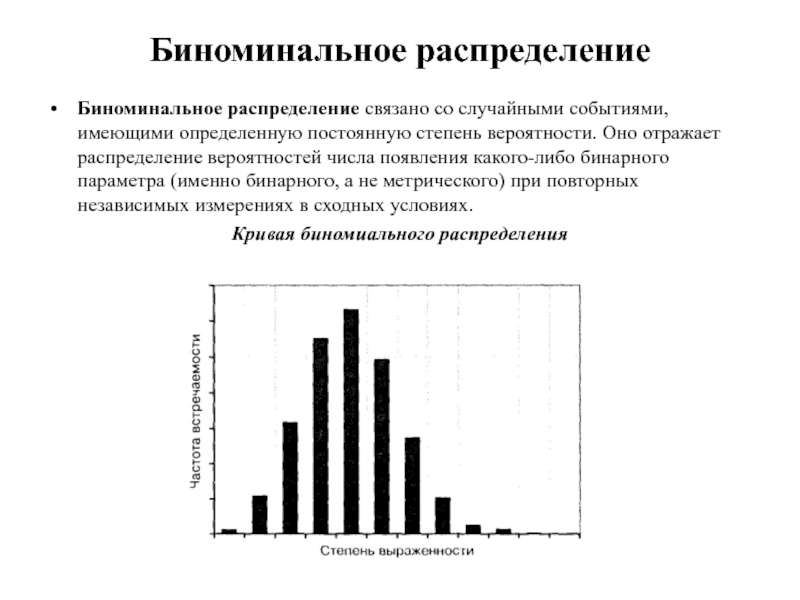

Слайд 56Биноминальное распределение

Биноминальное распределение связано со случайными событиями, имеющими определенную постоянную

степень вероятности. Оно отражает распределение вероятностей числа появления какого-либо бинарного

параметра (именно бинарного, а не метрического) при повторных независимых измерениях в сходных условиях.

Кривая биномиального распределения

Слайд 57Распределение Пуассона

Распределение Пуассона описывает случайные (редкие) события, вероятность появления которых

в отдельных случаях мала, но число этих случаев достаточно велико.

Кривая распределения Стьюдента

Для выборок с числом наблюдений 30 или более, распределение Стьюдента равно нормальному распределению. При меньшем количестве наблюдений оно отличается от нормального, становится более плоским.

Кривая распределения Фишера

Распределение Фишера описывает значения F при случайном выборе из одной генеральной совокупности т групп по n объектов.

Связь с распределением Стьюдента обусловлена простым соотношением: t2 = F.

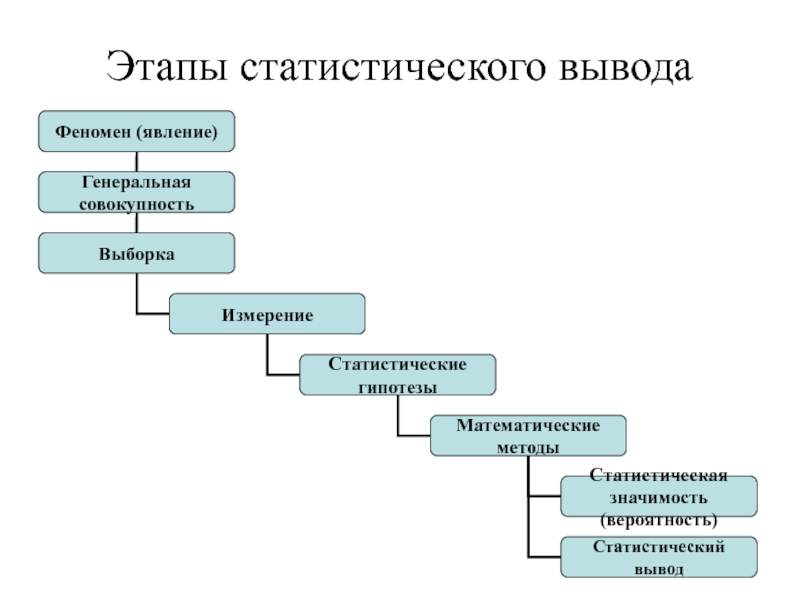

Слайд 58Тема 8. Статистическое оценивание и проверка гипотез

Понятие генеральной совокупности

и выборки

Виды вероятностной выборки

Зависимые и независимые выборки

Определение объема выборки при

нормальном распределении

Статистические гипотезы.

Статистический критерий.

Степень свободы.

Уровень значимости.

Статистический вывод.

Ошибки 1 и 2 рода.

Слайд 60Понятие генеральной совокупности и выборки

Генеральной совокупностью – называется всякая большая

(конечная или бесконечная) коллекция или совокупность предметов, которые мы хотим

исследовать.

Выборка — это часть или подмножество совокупности. Выборка называется репрезентативной если она адекватно отражает свойства генеральной совокупности.

Репрезентативность достигается методом рандомизации, т. е. случайным отбором объектов из генеральной совокупности.

Слайд 61Виды вероятностной выборки

Случайная выборка – сформированная на основе случайного отбора.

Минус

случайной выборки: отобранная часть популяции может существенно отличаться от популяции

в целом.

Стратифицированная выборка – отражающая особенности популяции.

Групповая выборка (кластерная) – это группа людей, имеющих определенную особенность, не важную с точки зрения исследуемых переменных.

Простая выборка – это выборки с наиболее часто встречаемыми признаками в популяции.

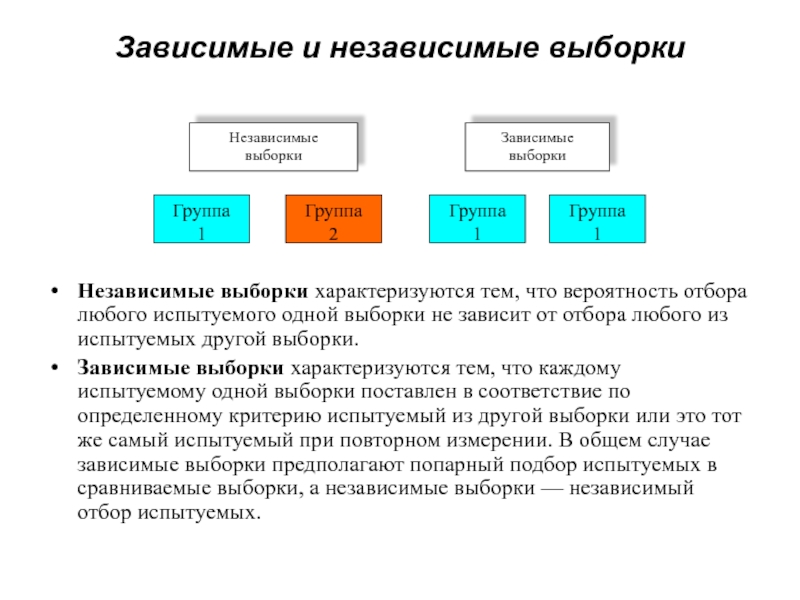

Слайд 62Зависимые и независимые выборки

Независимые выборки характеризуются тем, что вероятность отбора

любого испытуемого одной выборки не зависит от отбора любого из

испытуемых другой выборки.

Зависимые выборки характеризуются тем, что каждому испытуемому одной выборки поставлен в соответствие по определенному критерию испытуемый из другой выборки или это тот же самый испытуемый при повторном измерении. В общем случае зависимые выборки предполагают попарный подбор испытуемых в сравниваемые выборки, а независимые выборки — независимый отбор испытуемых.

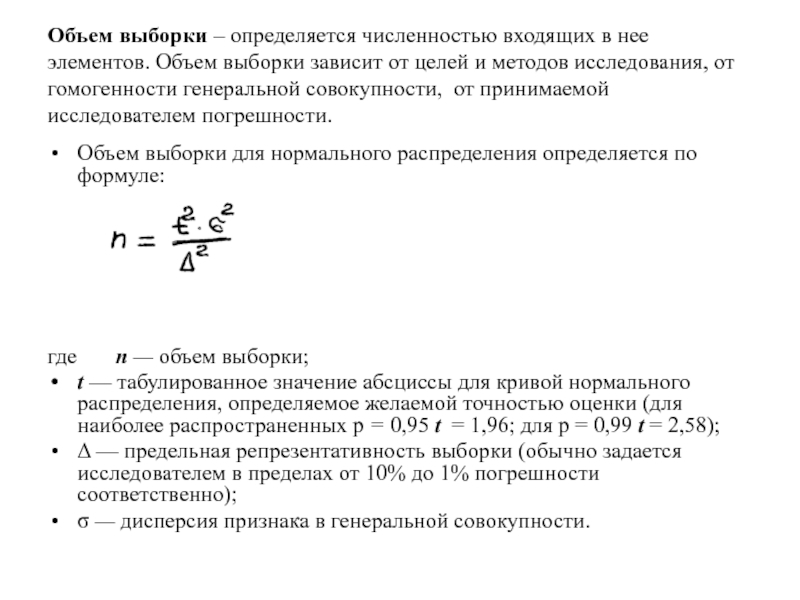

Слайд 63Объем выборки – определяется численностью входящих в нее элементов. Объем

выборки зависит от целей и методов исследования, от гомогенности генеральной

совокупности, от принимаемой исследователем погрешности.

Объем выборки для нормального распределения определяется по формуле:

где n — объем выборки;

t — табулированное значение абсциссы для кривой нормального распределения, определяемое желаемой точностью оценки (для наиболее распространенных p = 0,95 t = 1,96; для p = 0,99 t = 2,58);

Δ — предельная репрезентативность выборки (обычно задается исследователем в пределах от 10% до 1% погрешности соответственно);

σ — дисперсия признака в генеральной совокупности.

Слайд 64Гипотеза – это утверждение, истинность или ложность которого неизвестны, но

могут быть проверены опытным путем

Статистическая гипотеза — это утверждение относительно

неизвестного параметра генеральной совокупности, которое формулируется для проверки надежности связи и которое можно проверить по известным выборочным статистикам (критерий).

Варианты гипотез

1.О (различии) значении генеральных параметров;

2.О (взаимосвязи) отличии параметров от нуля;

3.О (нормальности распределения) законе распределения.

Слайд 65Нулевая гипотеза - это гипотеза об отсутствии различий. Она обозначается

как H0 и называется нулевой потому, что содержит число 0:

X1—Х2=0, где X1, X2 - сопоставляемые значения признаков. Нулевая гипотеза - это то, что мы хотим опровергнуть, если перед нами стоит задача доказать значимость различий.

Альтернативная гипотеза - это гипотеза о значимости различий. Она обозначается как Н1. Альтернативная гипотеза - это то, что мы хотим доказать, поэтому иногда ее называют экспериментальной гипотезой.

Слайд 66Статистический критерий

Статистический критерий – это решающее правило, обеспечивающее надежное

поведение, т.е. принятие истинной и отклонение ложной гипотезы с высокой

вероятностью.

Статистический критерий обозначает также метод расчета определенного числа и само это число

Мощность критерия – это его способность выявлять различия, если они есть (т.е. это его способность не допустить ошибку).

Критерий включает в себя:

формулу расчета эмпирического значения критерия по выборочным статистикам;

правило (формулу) определения числа степеней свободы;

теоретическое распределение для данного числа степеней свободы;

правило соотнесения эмпирического значения критерия с теоретическим распределением для определения вероятности того, что Но верна.

Слайд 68Основание выбора критерия

а) в какой шкале представлены признаки;

б) мощность критерия

в)

применимость по отношению к неравным по объему выборкам;

г) выполнение ограничения.

Слайд 69Степень свободы

Число степеней свободы – это количество возможных направлений

изменчивости признака.

Это характеристика распределения, используемая при проверке статистических гипотез,

отражающая степень произвольности вариантов заполнения определенных групп, на которые квантифицируется распределение (обозначается как df или n-1).

Вариант заполнения интервалов оценок в выборке из 100 обследованных степень свободы равна трем (df = k-1= 4-1=3).

Слайд 70Показатели степеней свободы для зависимых и независимых выборок

Если имеются две

независимые выборки, то число степеней свободы для первой из них

составляет п1 – 1, а для второй п – 1. таким образом, число степеней свободы для этих независимых выборок будет составлять (п1 + п2) – 2.

В случае зависимых выборок число степеней свободы равно п – 1.

Показатель степени свободы наиболее широко используется при расчете статистических гипотез с использованием критериев Стьюдента, Фишера, z-критерия, критерия χ2. При применении каждого критерия и в каждом конкретном случае его использования существуют свои правила определения количества степеней свободы.

Слайд 71Статистическая значимость (Significant level, сокращенно Sig.), или р-уровень значимости (p-level),

— основной результат проверки статистической гипотезы, это вероятность получения различий

в выборке исследования при условии, что на самом деле для генеральной совокупности верна нулевая статистическая гипотеза — то есть различий нет.

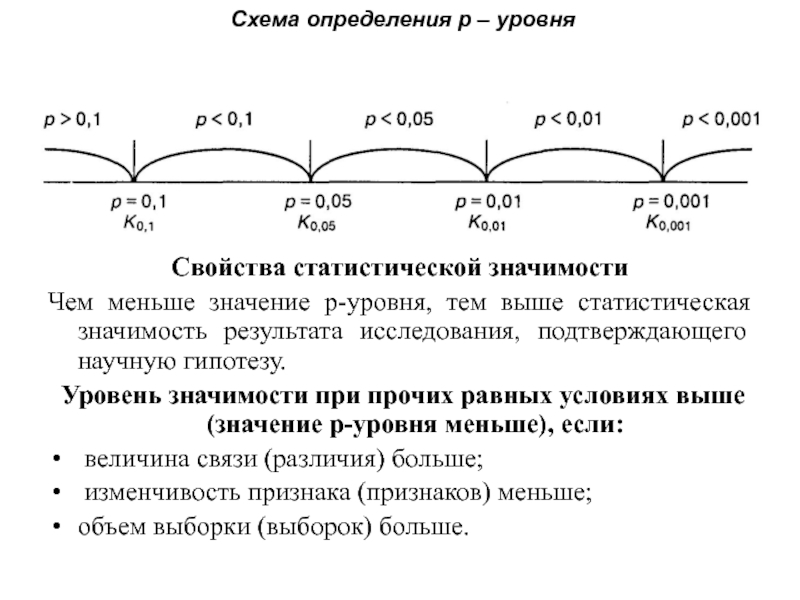

Слайд 72Схема определения р – уровня

Свойства статистической значимости

Чем меньше значение р-уровня,

тем выше статистическая значимость результата исследования, подтверждающего научную гипотезу.

Уровень

значимости при прочих равных условиях выше (значение р-уровня меньше), если:

величина связи (различия) больше;

изменчивость признака (признаков) меньше;

объем выборки (выборок) больше.

Слайд 73Статистический вывод — это формулирование вывода на основе статистической значимости.

Статистический вывод — это рассуждение от частного к общему, от

явного к неявному. Рассуждения статистического вывода помогают ответить на такой вопрос, как: «Что мне известно, если даны определенные показатели и произведен математико-статистический расчет и известен уровень значимости».

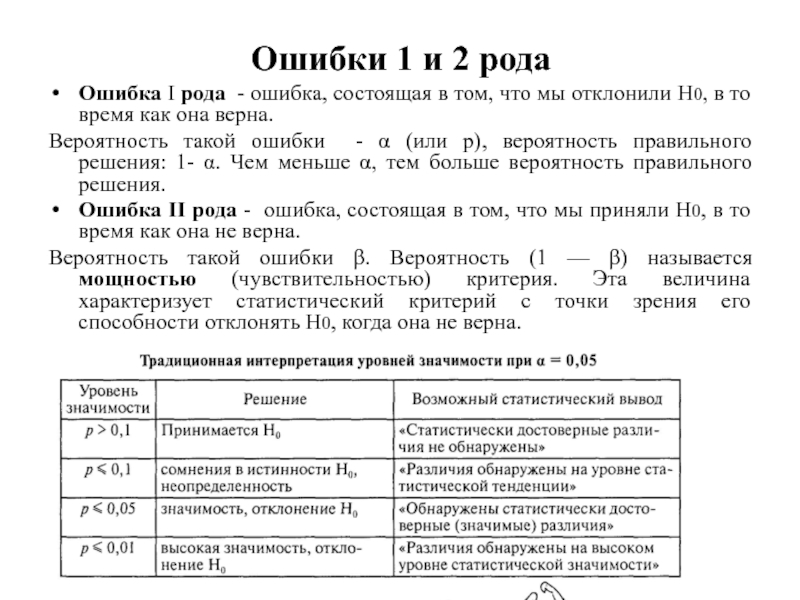

Слайд 74Ошибки 1 и 2 рода

Ошибка I рода - ошибка,

состоящая в том, что мы отклонили Н0, в то время

как она верна.

Вероятность такой ошибки - α (или р), вероятность правильного решения: 1- α. Чем меньше α, тем больше вероятность правильного решения.

Ошибка II рода - ошибка, состоящая в том, что мы приняли Н0, в то время как она не верна.

Вероятность такой ошибки β. Вероятность (1 — β) называется мощностью (чувствительностью) критерия. Эта величина характеризует статистический критерий с точки зрения его способности отклонять Н0, когда она не верна.

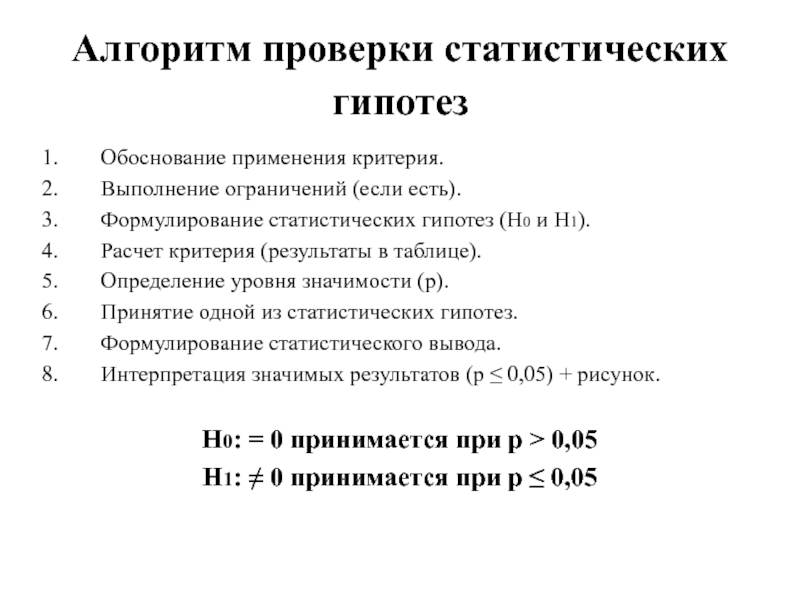

Слайд 75Алгоритм проверки статистических гипотез

Обоснование применения критерия.

Выполнение ограничений (если есть).

Формулирование

статистических гипотез (Н0 и Н1).

Расчет критерия (результаты в таблице).

Определение уровня

значимости (р).

Принятие одной из статистических гипотез.

Формулирование статистического вывода.

Интерпретация значимых результатов (р ≤ 0,05) + рисунок.

Н0: = 0 принимается при р > 0,05

Н1: ≠ 0 принимается при р ≤ 0,05

Слайд 76Тема 9. Меры связи

Понятие корреляции.

Диаграмма рассеяния.

Классификация коэффициентов корреляции.

Корреляционные

матрицы.

Интерпретация коэффициентов корреляции.

Графическое представление полученных взаимосвязей. Корреляционные плеяды.

Слайд 77Понятие корреляции и ее основные параметры

Корреляционная связь – это согласованное

изменение двух или более признаков.

Коэффициент корреляции — это количественная

мера силы и направления вероятностной взаимосвязи двух переменных; принимает значения в диапазоне от -1 до +1.

Слайд 78

Сила связи достигает максимума при условии взаимно однозначного соответствия: когда

каждому значению одной переменной соответствует только одно значение другой переменной

(и наоборот). Показателем силы связи является абсолютная (без учета знака) величина коэффициента корреляции.

Направление связи определяется прямым или обратным соотношением значений двух переменных: если возрастанию значений одной переменной соответствует возрастание значений другой переменной, то взаимосвязь называется прямой (положительной); если возрастанию значений одной переменной соответствует убывание значений другой переменной, то взаимосвязь является обратной (отрицательной). Показателем направления связи является знак коэффициента корреляции.

Слайд 79Формулировка статистических гипотез

Н0: Корреляция между переменными не отличается

от нуля.

Н1: Корреляция между переменными отличается от нуля.

Слайд 80Виды связей

Взаимосвязи на языке математики обычно описываются при помощи функций,

которые графически изображаются в виде линий.

Если изменение одной переменной

на одну единицу всегда приводит к изменению другой переменной на одну и ту же величину, функция является линейной (график ее представляет прямую линию); любая другая связь — нелинейная.

Если увеличение одной переменной связано с увеличением другой, то связь — положительная (прямая); если увеличение одной переменной связано с уменьшением другой, то связь — отрицательная (обратная).

Если направление изменения одной переменной не меняется с возрастанием (убыванием) другой переменной, то такая функция — монотонная; в противном случае функцию называют немонотонной.

Слайд 81Примеры графиков часто встречающихся функций

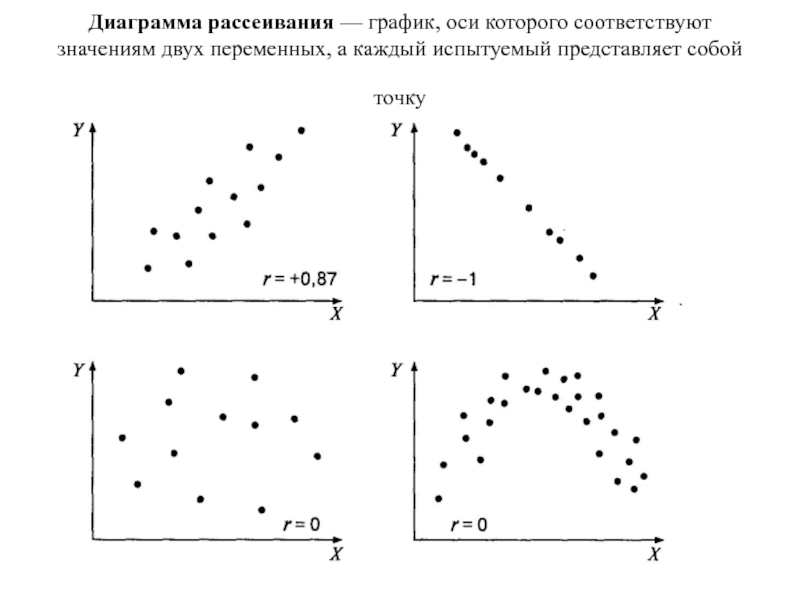

Слайд 82Диаграмма рассеивания — график, оси которого соответствуют значениям двух переменных,

а каждый испытуемый представляет собой точку

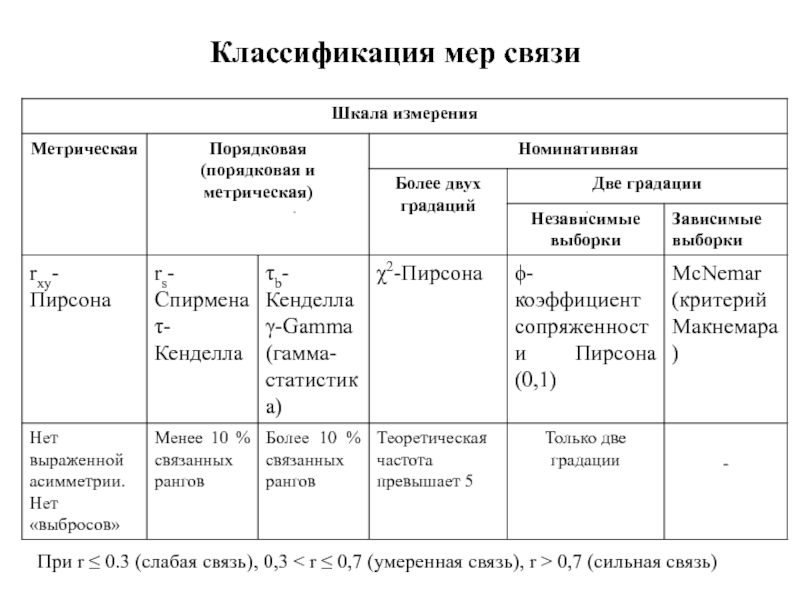

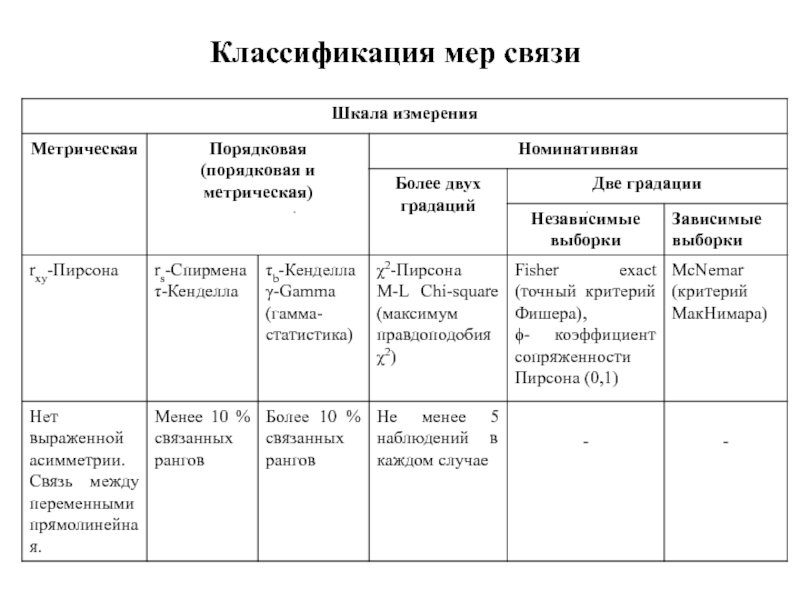

Слайд 83Классификация мер связи

При r ≤ 0.3 (слабая связь), 0,3

r ≤ 0,7 (умеренная связь), r > 0,7 (сильная связь)

Слайд 84Алгоритм выбора коэффициента корреляции

Слайд 86Представление данных корреляционного анализа

Построение корреляционных матриц и их анализ

1 вид - Квадратная матрица

2 вид - Прямоугольная матрица

3 вид

– Детализированная таблица

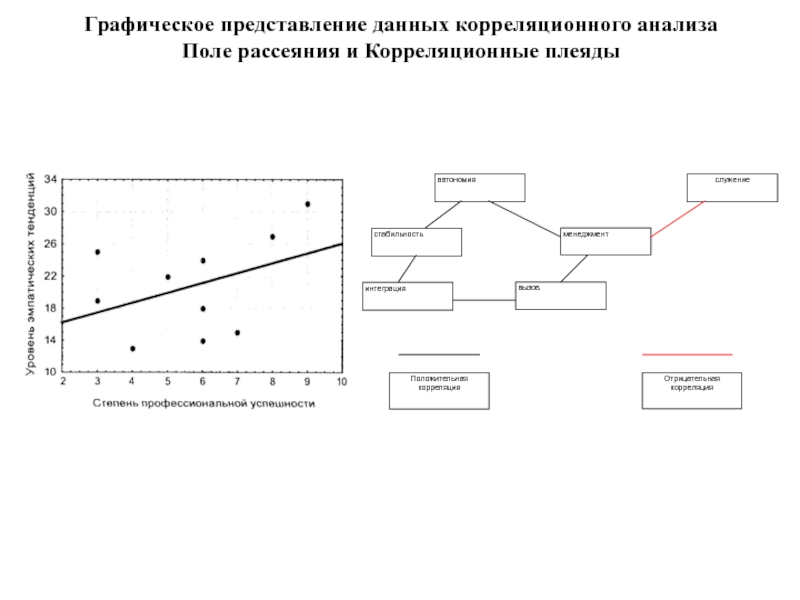

Слайд 87Графическое представление данных корреляционного анализа

Поле рассеяния и Корреляционные плеяды

Слайд 89Коэффициент корреляции rxy- Пирсона

Коэффициент был создан Карлом (Чарлзом) Пирсоном (англ.

Karl (Charles) Pearson), выдающимся английским математиком, статистиком, биологом и философом.

Родился 27 марта 1857, Лондон

Умер 27 апреля 1936, там же) —К. Пирсон считается основателем математической статистики; основные его труды по математической статистике: разработал теорию корреляции; тесты математической статистики и критерии согласия; распределение Пирсона и др.

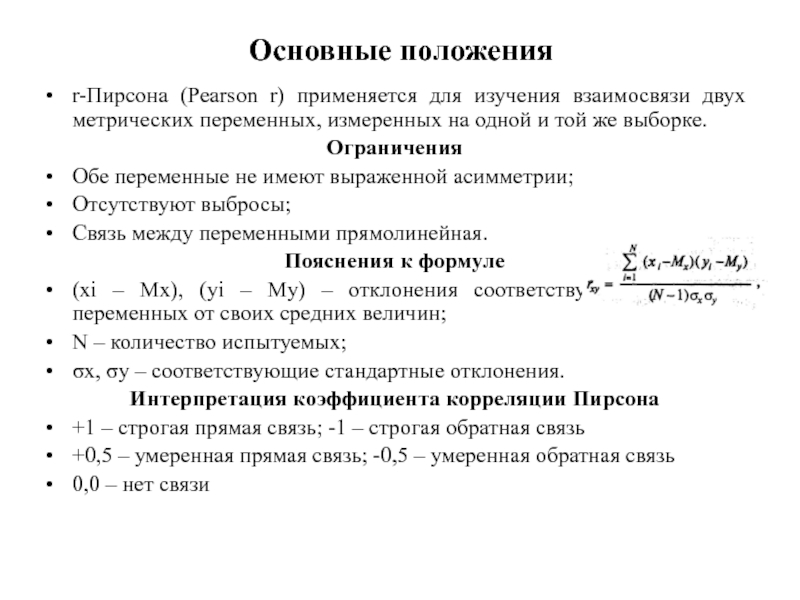

Слайд 90Основные положения

r-Пирсона (Pearson r) применяется для изучения взаимосвязи двух

метрических переменных, измеренных на одной и той же выборке.

Ограничения

Обе

переменные не имеют выраженной асимметрии;

Отсутствуют выбросы;

Связь между переменными прямолинейная.

Пояснения к формуле

(xi – Mx), (yi – My) – отклонения соответствующих значений переменных от своих средних величин;

N – количество испытуемых;

σх, σу – соответствующие стандартные отклонения.

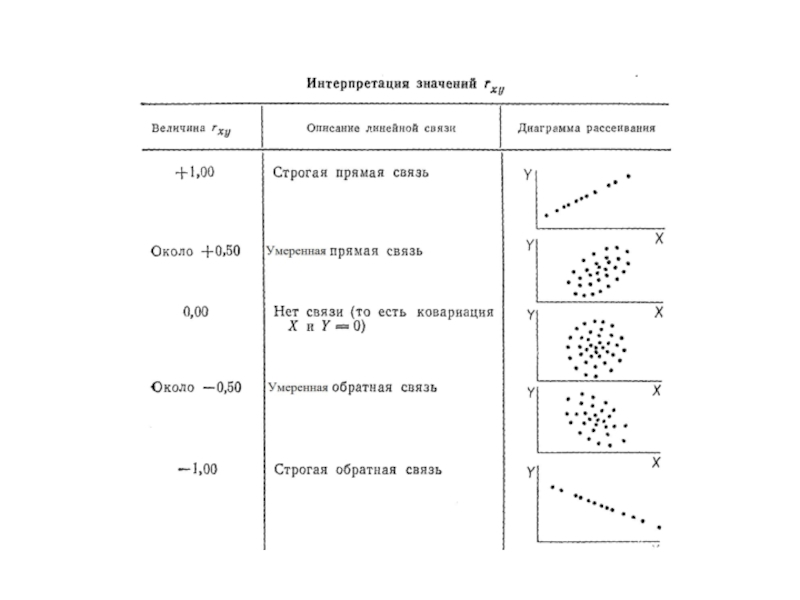

Интерпретация коэффициента корреляции Пирсона

+1 – строгая прямая связь; -1 – строгая обратная связь

+0,5 – умеренная прямая связь; -0,5 – умеренная обратная связь

0,0 – нет связи

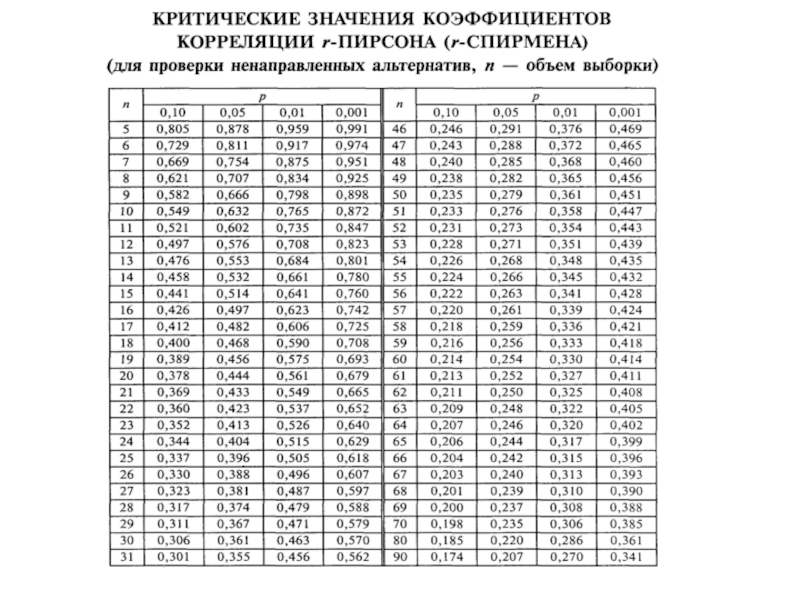

Слайд 91Нахождение коэффициента корреляции rxy-Пирсона

rxy = 25,6

= 0,57 р

≤ 0,01

1,735 * 1,501 * 19

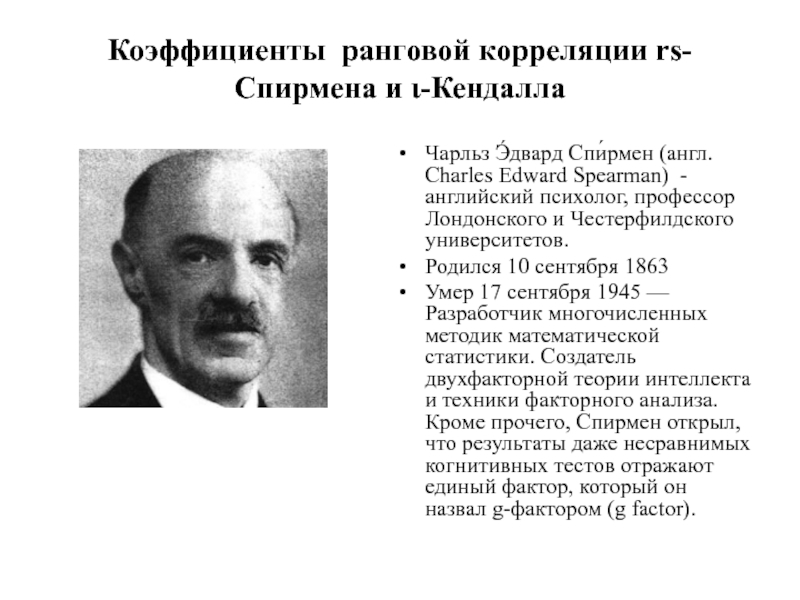

Слайд 94Коэффициенты ранговой корреляции rs-Спирмена и ι-Кендалла

Чарльз Э́двард Спи́рмен (англ. Charles

Edward Spearman) - английский психолог, профессор Лондонского и Честерфилдского университетов.

Родился 10 сентября 1863

Умер 17 сентября 1945 —Разработчик многочисленных методик математической статистики. Создатель двухфакторной теории интеллекта и техники факторного анализа. Кроме прочего, Спирмен открыл, что результаты даже несравнимых когнитивных тестов отражают единый фактор, который он назвал g-фактором (g factor).

Слайд 95

Основные положения

Коэффициентов корреляции rs-Спирмена и ι-Кендалла

Коэффициенты ранговой корреляции: r-Спирмена

или ι-Кенделла применяются если обе переменные представлены в порядковой шкале,

или одна из них — в порядковой, а другая — в метрической.

Ограничения

Обе переменные представлены в количественной шкале (метрической или ранговой);

Связь между переменными является монотонной (не меняет свой знак с изменением величины одной из переменных.

Отсутствие повторяющихся рангов (менее 10 % связанных рангов).

Формула rs-Спирмена и пояснения к формуле

d – разность между рангами по двум переменным для каждого испытуемого;

N – количество ранжируемых значений, в данном случае количество испытуемых

Интерпретация коэффициентов корреляции

+0,7 и выше – тесная положительная связь; -0,7 и выше – тесная отрицательная связь;

+0,4 и выше – умеренная положительная связь; -0,4 и выше – умеренная отрицательная связь;

+0,2 и – выше слабая положительная связь;-0,2 и – выше слабая отрицательная связь;

0,0 и выше – нет связи

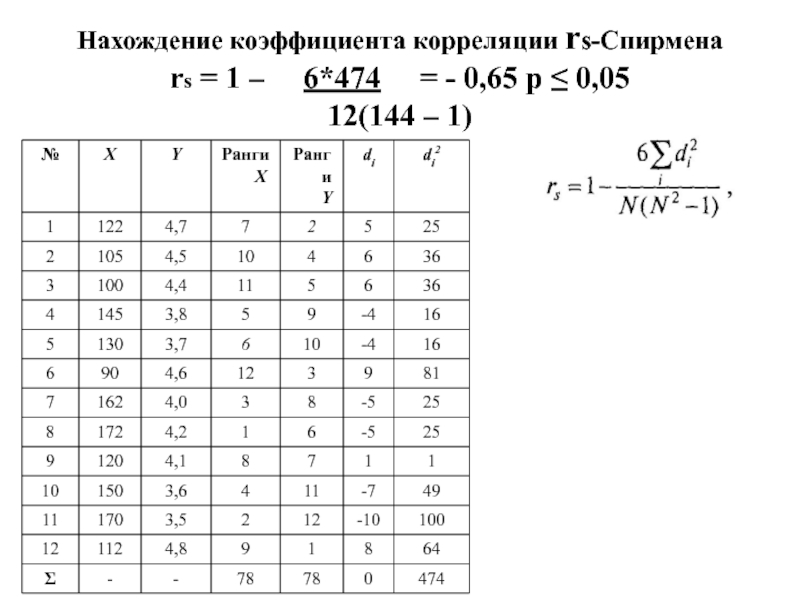

Слайд 96Нахождение коэффициента корреляции rs-Спирмена

rs = 1 –

6*474 = - 0,65 р ≤ 0,05

12(144 – 1)

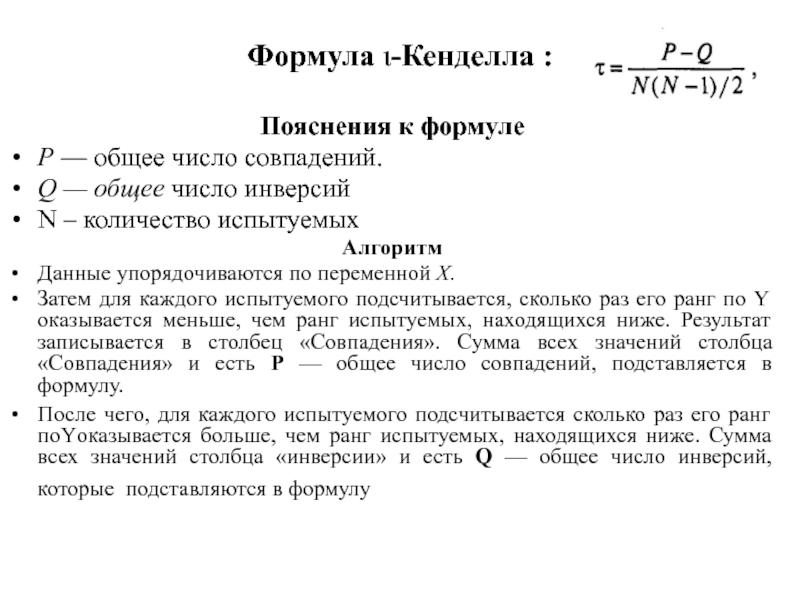

Слайд 97Формула ι-Кенделла :

Пояснения к формуле

Р — общее число совпадений.

Q

— общее число инверсий

N – количество испытуемых

Алгоритм

Данные упорядочиваются

по переменной X.

Затем для каждого испытуемого подсчитывается, сколько раз его ранг по Y оказывается меньше, чем ранг испытуемых, находящихся ниже. Результат записывается в столбец «Совпадения». Сумма всех значений столбца «Совпадения» и есть Р — общее число совпадений, подставляется в формулу.

После чего, для каждого испытуемого подсчитывается сколько раз его ранг поYоказывается больше, чем ранг испытуемых, находящихся ниже. Сумма всех значений столбца «инверсии» и есть Q — общее число инверсий, которые подставляются в формулу

Слайд 98Нахождение коэффициента корреляции ι-Кенделла

ι = 21-7 = 0,5 р

= 0,08

8(8-1)/2

Статистический вывод: взаимосвязь между мотивацией и эмоциональными

выборами не обнаружена.

Слайд 99Тема 10. Анализ качественных признаков (номинативных данных)

Корреляция номинативных данных

критерий χ2-Пирсона

Корреляция

бинарных данных

фи-коэффициент сопряженности Пирсона

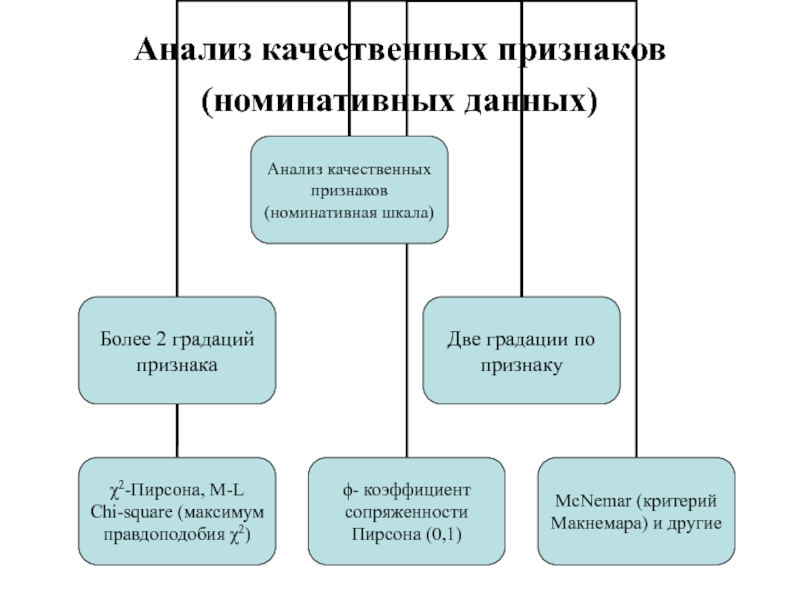

Слайд 100Анализ качественных признаков (номинативных данных)

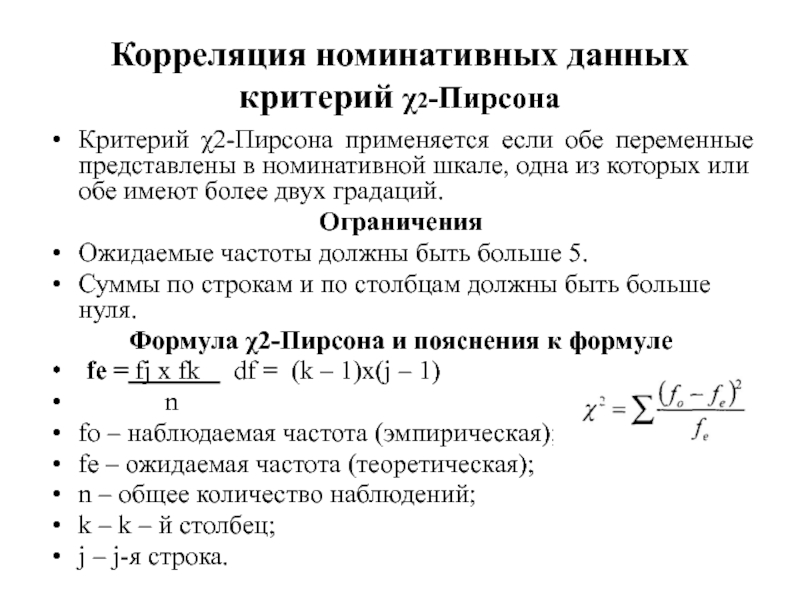

Слайд 101Корреляция номинативных данных

критерий χ2-Пирсона

Критерий χ2-Пирсона применяется если обе переменные представлены

в номинативной шкале, одна из которых или обе имеют более

двух градаций.

Ограничения

Ожидаемые частоты должны быть больше 5.

Суммы по строкам и по столбцам должны быть больше нуля.

Формула χ2-Пирсона и пояснения к формуле

fe = fj x fk df = (k – 1)x(j – 1)

n

fo – наблюдаемая частота (эмпирическая);

fe – ожидаемая частота (теоретическая);

n – общее количество наблюдений;

k – k – й столбец;

j – j-я строка.

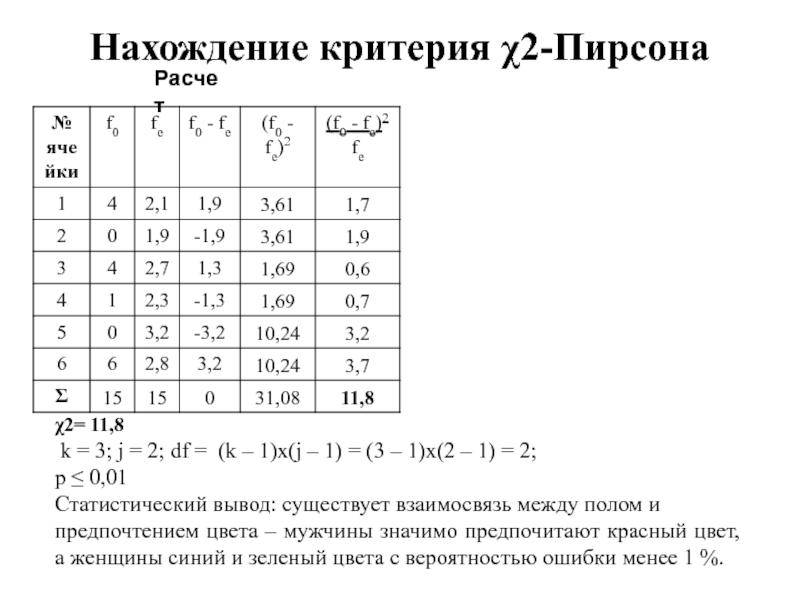

Слайд 102Нахождение критерия χ2-Пирсона

Теоретические частоты fe женский и синий =

4 x 8 = 2,1

15

Эмпирические частоты

Слайд 103Нахождение критерия χ2-Пирсона

Расчет

χ2= 11,8

k = 3; j = 2;

df = (k – 1)x(j – 1) = (3 –

1)х(2 – 1) = 2;

р ≤ 0,01

Статистический вывод: существует взаимосвязь между полом и

предпочтением цвета – мужчины значимо предпочитают красный цвет, а женщины синий и зеленый цвета с вероятностью ошибки менее 1 %.

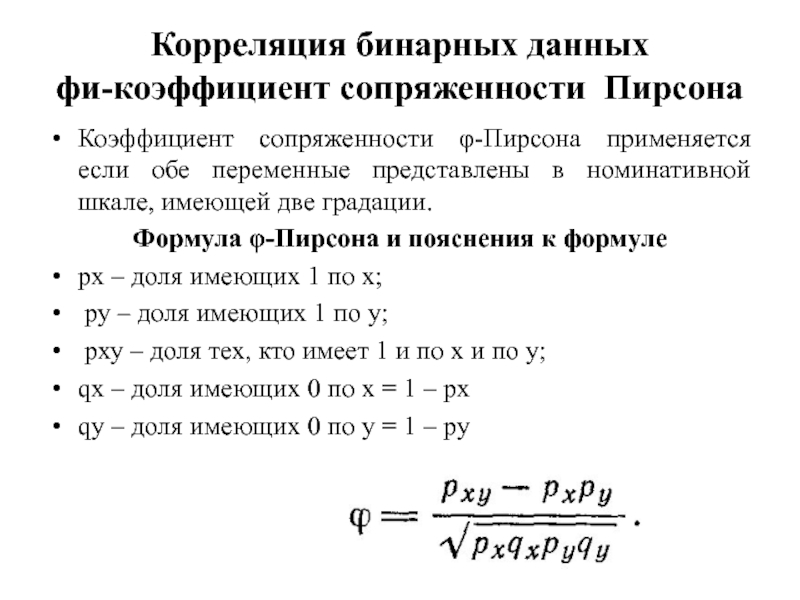

Слайд 104Корреляция бинарных данных

фи-коэффициент сопряженности Пирсона

Коэффициент сопряженности φ-Пирсона применяется если обе

переменные представлены в номинативной шкале, имеющей две градации.

Формула φ-Пирсона и

пояснения к формуле

рх – доля имеющих 1 по х;

ру – доля имеющих 1 по y;

рху – доля тех, кто имеет 1 и по х и по у;

qx – доля имеющих 0 по х = 1 – рx

qy – доля имеющих 0 по у = 1 – рy

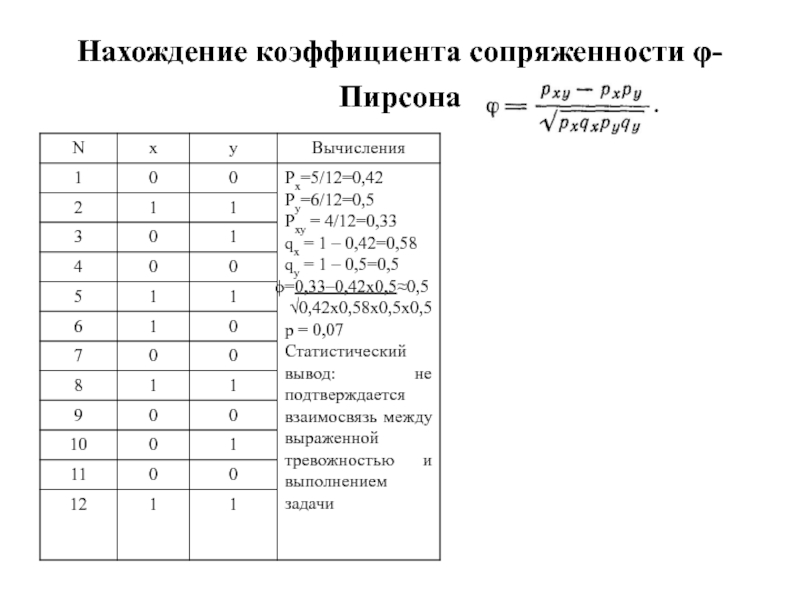

Слайд 105Нахождение коэффициента сопряженности φ-Пирсона

Слайд 106Тема 11. Анализ различий между 2 группами независимых выборок

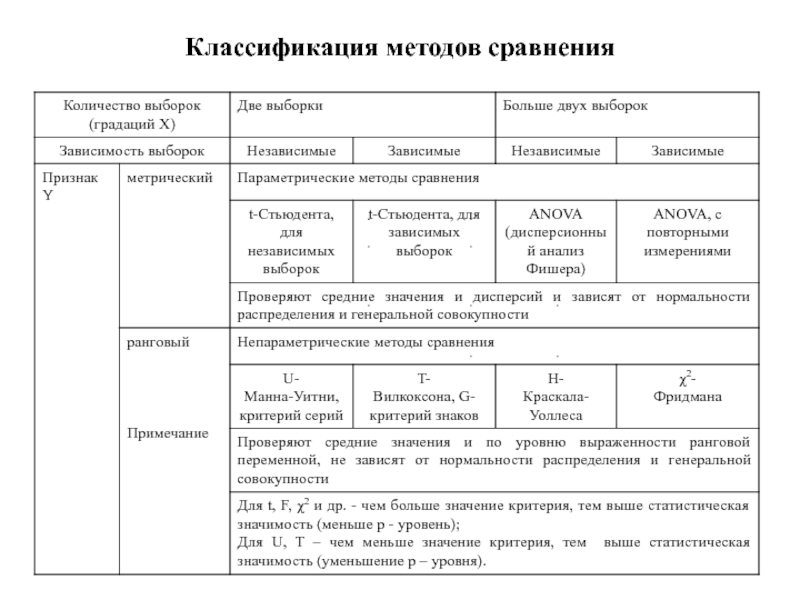

Классификация методов

сравнения

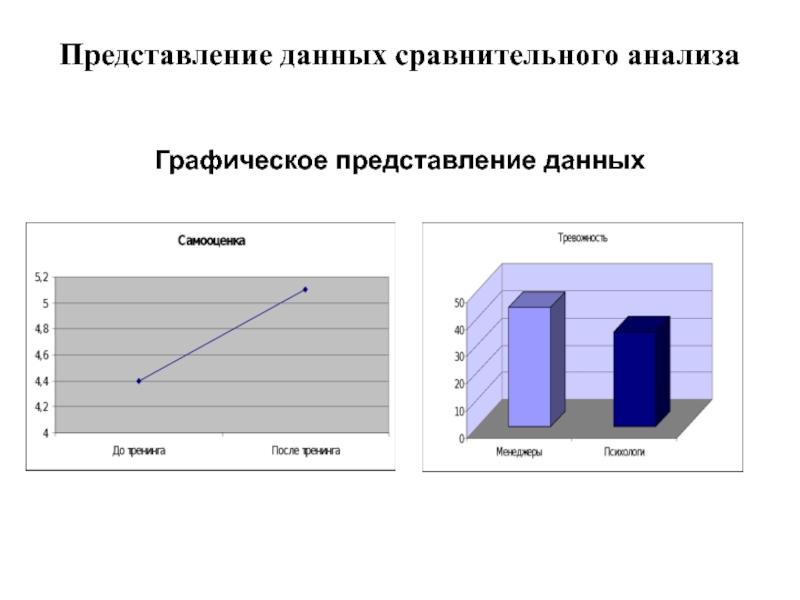

Представление данных сравнительного анализа

Параметрический критерий t-Стьюдента для двух независимых

выборок

Непараметрический критерий U-Манна-Уитни для двух независимых выборок

Слайд 107Методы сравнения

В зависимости от решаемых задач методы внутри этой группы

классифицируются по трем основаниям:

Количество градаций X:

а) сравниваются 2 выборки;

б) сравниваются

больше 2 выборок.

Зависимость выборок:

а) сравниваемые выборки независимы;

б)сравниваемые выборки зависимы.

Шкала У:

а) Y— ранговая переменная;

б) У— метрическая переменная.

По последнему основанию методы делятся на две большие группы: параметрические методы (критерии) — для метрических переменных и непараметрические методы (критерии) — для порядковых (ранговых) переменных. Параметрические методы проверяют гипотезы относительно параметров распределения (средних значений и дисперсий) и основаны на предположении о нормальном распределении в генеральной совокупности. Непараметрические методы не зависят от предположений о характере распределения и не касаются параметров этого распределения.

Независимые выборки характеризуются тем, что вероятность отбора любого испытуемого одной выборки не зависит от отбора любого из испытуемых другой выборки. Напротив, зависимые выборки характеризуются тем, что каждому испытуемому одной выборки поставлен в соответствие по определенному критерию испытуемый из другой выборки.В общем случае зависимые выборки предполагают попарный подбор испытуемых в сравниваемые выборки, а независимые выборки — независимый отбор испытуемых.

Формулировка статистических гипотез

Н0: Различий между выборками в уровне изучаемого признака не имеется.

Н1: Различия между выборками в уровне изучаемого признака имеются.

Слайд 108Представление данных сравнительного анализа

Графическое представление данных

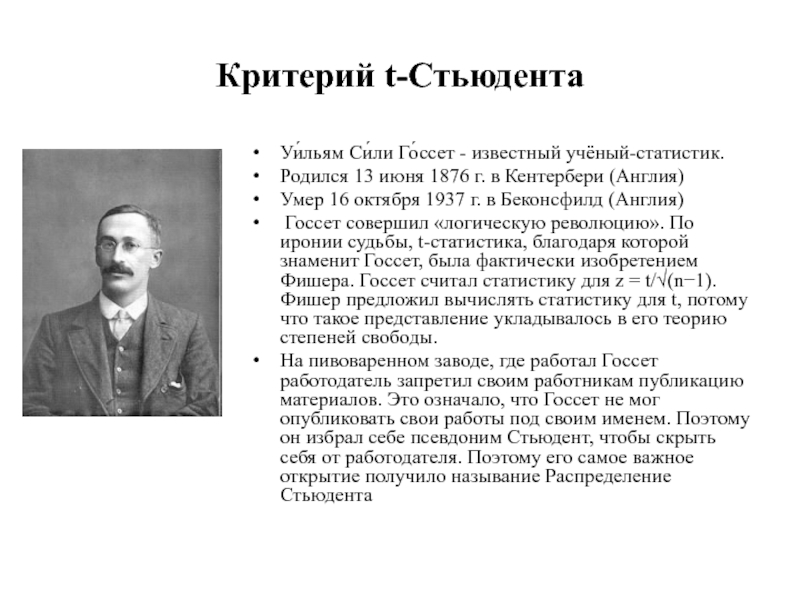

Слайд 111Критерий t-Стьюдента

Уи́льям Си́ли Го́ссет - известный учёный-статистик.

Родился 13 июня

1876 г. в Кентербери (Англия)

Умер 16 октября 1937 г. в

Беконсфилд (Англия)

Госсет совершил «логическую революцию». По иронии судьбы, t-статистика, благодаря которой знаменит Госсет, была фактически изобретением Фишера. Госсет считал статистику для z = t/√(n−1). Фишер предложил вычислять статистику для t, потому что такое представление укладывалось в его теорию степеней свободы.

На пивоваренном заводе, где работал Госсет работодатель запретил своим работникам публикацию материалов. Это означало, что Госсет не мог опубликовать свои работы под своим именем. Поэтому он избрал себе псевдоним Стьюдент, чтобы скрыть себя от работодателя. Поэтому его самое важное открытие получило называние Распределение Стьюдента

Слайд 112Параметрический критерий t-Стьюдента для двух независимых выборок

Метод позволяет проверить

гипотезу о том, что средние значения двух генеральных совокупностей, из

которых извлечены две сравниваемые независимые выборки, отличаются друг от друга.

Ограничения:

Распределения признака и в той, и в другой выборке существенно не отличаются от нормального.

Дисперсии выборок равны.

Признак измерен в метрической шкале.

Формула t-Стьюдента и пояснения к формуле

df = N1 + N2 – 2

М1 и М2 – средние значения в соответствующих выборках;

σ1 и σ2 – ст. отклонение в соответствующих выборках;

N1 и N2 – количество испытуемых в соответствующих выборках;

df - число степеней свободы.

Гипотезы:

Н0: признак в выборке 1 равен исследуемому признаку в выборке 2.

Н1: признак в выборке 1 не равен исследуемому признаку в выборке 2.

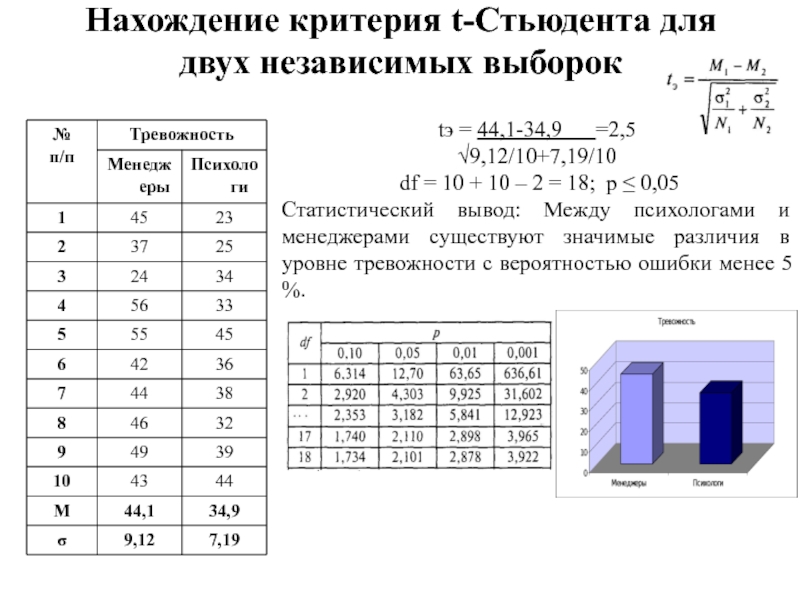

Слайд 113Нахождение критерия t-Стьюдента для двух независимых выборок

tэ = 44,1-34,9

=2,5

√9,12/10+7,19/10

df = 10 + 10 –

2 = 18; р ≤ 0,05

Статистический вывод: Между психологами и менеджерами существуют значимые различия в уровне тревожности с вероятностью ошибки менее 5 %.

Слайд 114Критерий U-Манна-Уитни

Настоящий статистический метод был предложен Фрэнком Вилкоксоном в 1945

году. Однако в 1947 году метод был улучшен и расширен

Х. Б. Манном и Д. Р. Уитни, посему U-критерий чаще называют их именами.

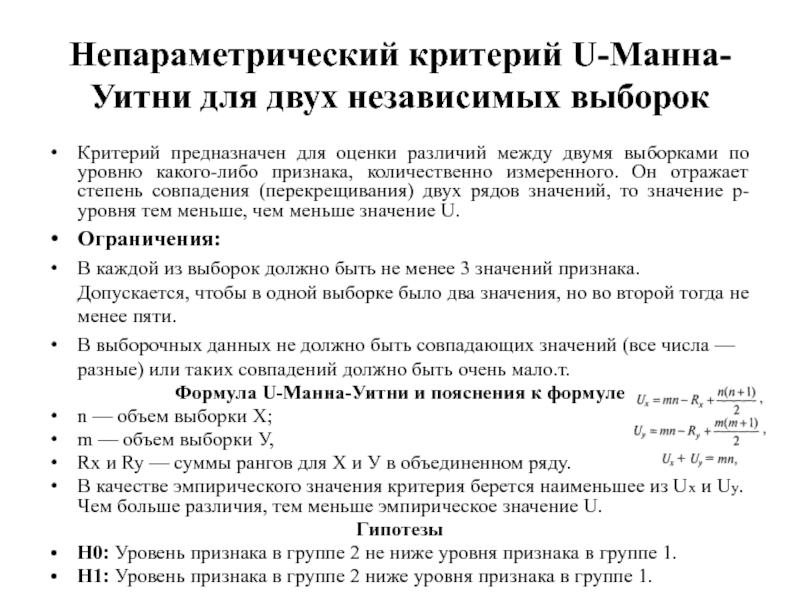

Слайд 115Непараметрический критерий U-Манна-Уитни для двух независимых выборок

Критерий предназначен для оценки

различий между двумя выборками по уровню какого-либо признака, количественно измеренного.

Он отражает степень совпадения (перекрещивания) двух рядов значений, то значение р-уровня тем меньше, чем меньше значение U.

Ограничения:

В каждой из выборок должно быть не менее 3 значений признака. Допускается, чтобы в одной выборке было два значения, но во второй тогда не менее пяти.

В выборочных данных не должно быть совпадающих значений (все числа — разные) или таких совпадений должно быть очень мало.т.

Формула U-Манна-Уитни и пояснения к формуле

n — объем выборки Х;

m — объем выборки У,

Rx и Ry — суммы рангов для X и У в объединенном ряду.

В качестве эмпирического значения критерия берется наименьшее из Ux и Uy. Чем больше различия, тем меньше эмпирическое значение U.

Гипотезы

H0: Уровень признака в группе 2 не ниже уровня признака в группе 1.

H1: Уровень признака в группе 2 ниже уровня признака в группе 1.

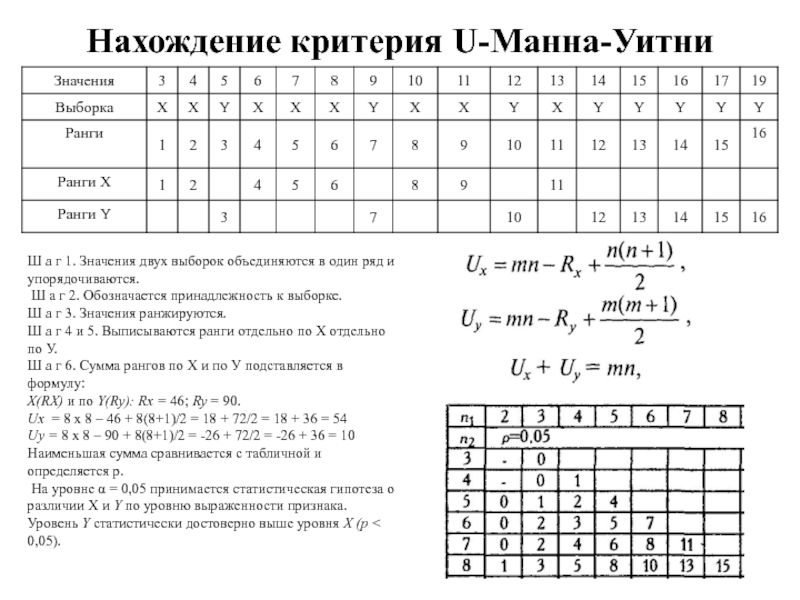

Слайд 116Нахождение критерия U-Манна-Уитни

Ш а г 1. Значения двух выборок объединяются

в один ряд и упорядочиваются.

Ш а г 2. Обозначается

принадлежность к выборке.

Ш а г 3. Значения ранжируются.

Ш а г 4 и 5. Выписываются ранги отдельно по Х отдельно по У.

Ш а г 6. Сумма рангов по Х и по У подставляется в формулу:

X(RX) и по Y(Ry): Rx = 46; Ry = 90.

Ux = 8 х 8 – 46 + 8(8+1)/2 = 18 + 72/2 = 18 + 36 = 54

Uy = 8 х 8 – 90 + 8(8+1)/2 = -26 + 72/2 = -26 + 36 = 10

Наименьшая сумма сравнивается с табличной и определяется р.

На уровне α = 0,05 принимается статистическая гипотеза о различии Х и Y по уровню выраженности признака. Уровень Y статистически достоверно выше уровня Х (р < 0,05).

Слайд 117Тема 12. Анализ различий между 2 группами зависимых выборок

Параметрический критерий

t-Стьюдента для двух зависимых выборок

Непараметрический критерий Т-Уилкоксона для сравнения двух

зависимых групп

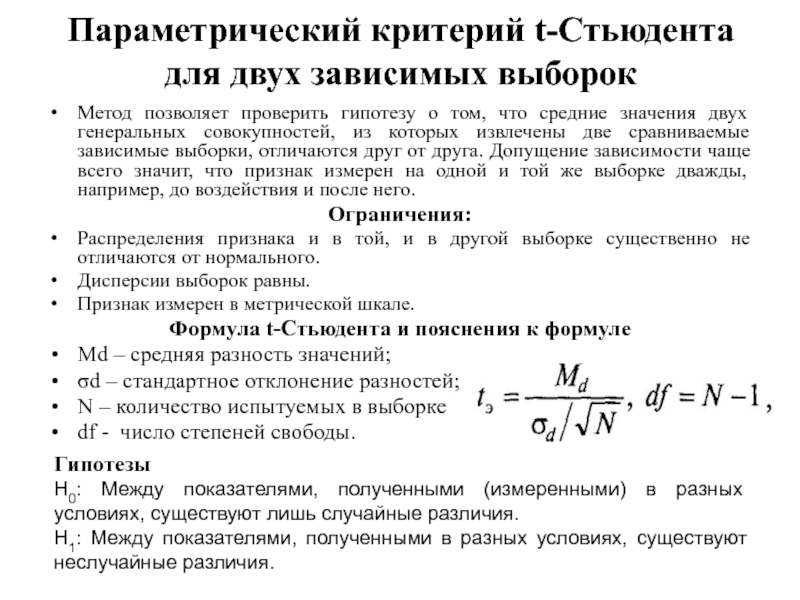

Слайд 118Параметрический критерий t-Стьюдента для двух зависимых выборок

Метод позволяет проверить гипотезу

о том, что средние значения двух генеральных совокупностей, из которых

извлечены две сравниваемые зависимые выборки, отличаются друг от друга. Допущение зависимости чаще всего значит, что признак измерен на одной и той же выборке дважды, например, до воздействия и после него.

Ограничения:

Распределения признака и в той, и в другой выборке существенно не отличаются от нормального.

Дисперсии выборок равны.

Признак измерен в метрической шкале.

Формула t-Стьюдента и пояснения к формуле

Md – средняя разность значений;

σd – стандартное отклонение разностей;

N – количество испытуемых в выборке

df - число степеней свободы.

Гипотезы

Н0: Между показателями, полученными (измеренными) в разных условиях, существуют лишь случайные различия.

H1: Между показателями, полученными в разных условиях, существуют неслучайные различия.

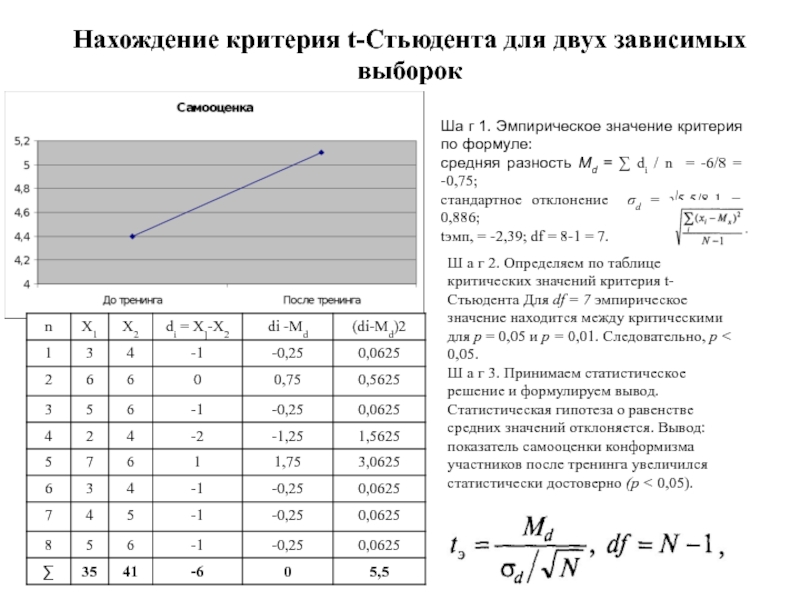

Слайд 119Нахождение критерия t-Стьюдента для двух зависимых выборок

Ша г 1. Эмпирическое

значение критерия по формуле:

средняя разность Md = ∑ di

/ n = -6/8 = -0,75;

стандартное отклонение σd = √5.5/8-1 = 0,886;

tэмп, = -2,39; df = 8-1 = 7.

Ш а г 2. Определяем по таблице критических значений критерия t-Стьюдента Для df = 7 эмпирическое значение находится между критическими для р = 0,05 и р = 0,01. Следовательно, р < 0,05.

Ш а г 3. Принимаем статистическое решение и формулируем вывод. Статистическая гипотеза о равенстве средних значений отклоняется. Вывод: показатель самооценки конформизма участников после тренинга увеличился статистически достоверно (р < 0,05).

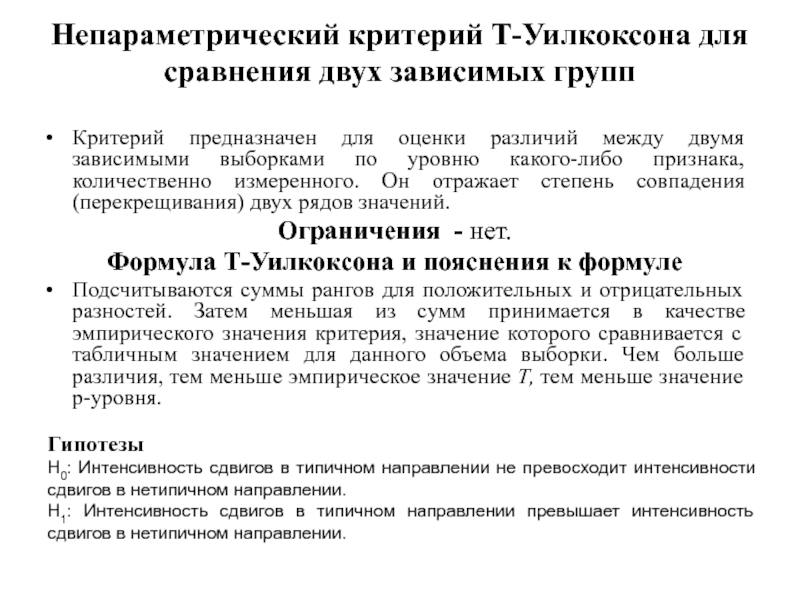

Слайд 120Непараметрический критерий Т-Уилкоксона для сравнения двух зависимых групп

Критерий предназначен для

оценки различий между двумя зависимыми выборками по уровню какого-либо признака,

количественно измеренного. Он отражает степень совпадения (перекрещивания) двух рядов значений.

Ограничения - нет.

Формула Т-Уилкоксона и пояснения к формуле

Подсчитываются суммы рангов для положительных и отрицательных разностей. Затем меньшая из сумм принимается в качестве эмпирического значения критерия, значение которого сравнивается с табличным значением для данного объема выборки. Чем больше различия, тем меньше эмпирическое значение Т, тем меньше значение р-уровня.

Гипотезы

Н0: Интенсивность сдвигов в типичном направлении не превосходит интенсивности сдвигов в нетипичном направлении.

Н1: Интенсивность сдвигов в типичном направлении превышает интенсивность сдвигов в нетипичном направлении.

Слайд 121Нахождение непараметрического критерия Т-Уилкоксона

Ш а г 1. Подсчитать разности значений

для каждого объекта выборки (строка 4).

Ш а г 2.

Ранжировать абсолютные значения разностей (строка 5).

Ш а г 3. Выписать ранги положительных и отрицательных значений разностей (строки 6 и 7).

Ш а г 4. Подсчитать суммы рангов отдельно для положительных и отрицательных разностей: T1 = 13; Т2 = 65. За эмпирическое значение критерия Тэмп принимается меньшая сумма: Тэмп = 13.

Наименьшая сумма сравнивается с табличной и определяется р.

Уровень выраженности признака для условия 2 статистически значимо выше, чем для условия 1 (р = 0,05).

Слайд 122Тема 13. Анализ различий между 3 и более группами независимых

выборок

Непараметрический критерий Н-Краскала-Уоллеса для сравнения 3 и более групп

Критерий χ2-Фридмана

для сравнения 3-х и более зависимых выборок

Слайд 123Непараметрический критерий Н-Краскала-Уоллеса для сравнения 3 и более групп

Критерий Краскала

— Уоллиса предназначен для проверки равенства медиан нескольких выборок. Данный

критерий является многомерным обобщением критерия Уилкоксона — Манна — Уитни. Критерий Краскала — Уоллиса является ранговым, поэтому он инвариантен по отношению к любому монотонному преобразованию шкалы измерения.

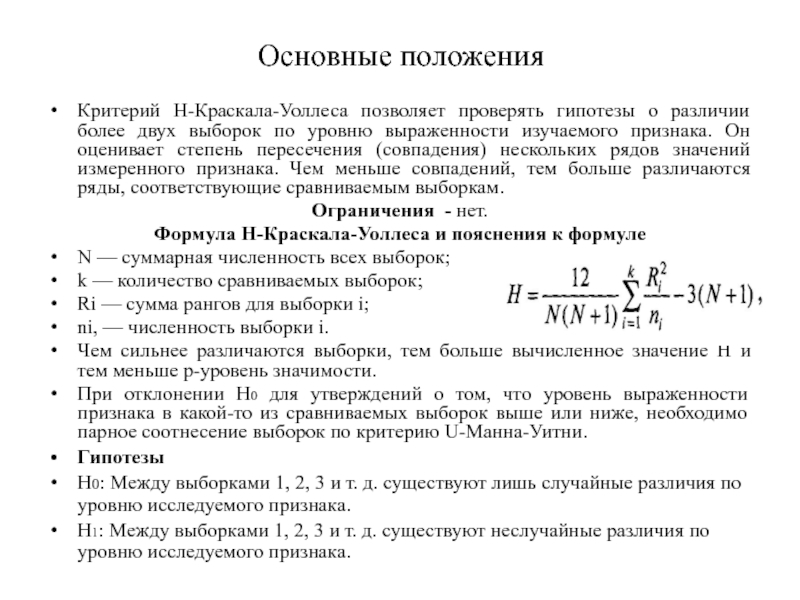

Слайд 124Основные положения

Критерий Н-Краскала-Уоллеса позволяет проверять гипотезы о различии более двух

выборок по уровню выраженности изучаемого признака. Он оценивает степень пересечения

(совпадения) нескольких рядов значений измеренного признака. Чем меньше совпадений, тем больше различаются ряды, соответствующие сравниваемым выборкам.

Ограничения - нет.

Формула Н-Краскала-Уоллеса и пояснения к формуле

N — суммарная численность всех выборок;

k — количество сравниваемых выборок;

Ri — сумма рангов для выборки i;

ni, — численность выборки i.

Чем сильнее различаются выборки, тем больше вычисленное значение Н и тем меньше p-уровень значимости.

При отклонении Н0 для утверждений о том, что уровень выраженности признака в какой-то из сравниваемых выборок выше или ниже, необходимо парное соотнесение выборок по критерию U-Манна-Уитни.

Гипотезы

H0: Между выборками 1, 2, 3 и т. д. существуют лишь случайные различия по уровню исследуемого признака.

H1: Между выборками 1, 2, 3 и т. д. существуют неслучайные различия по уровню исследуемого признака.

Слайд 125Нахождение Н-Краскала-Уоллеса

Шаг 1. Значения объединяются в один упорядоченный ряд. Обозначается

принадлежность каждого значения к выборке (строки 1 и 2).

Ш а

г 2. Значения выборок ранжируются и выписываются отдельно ранги для каждой выборки (строки 3-6).

Ш а г 3. Вычисляются суммы рангов для каждой выборки Rx = 46; R2 = 49; R3 = 41.

Ш а г 4. Н = 12/ 16(16 + 1) х (462/8 + 492/5 + 412/3) – 3(16 + 1) = 7,725

Шаг 5. Определяется р-уровень значимости. Хотя сравниваются 3 выборки, но объем одной из них больше 5, поэтому вычисленное Н сравнивается с табличным значением χ2 (приложение 4) для числа степеней свободы df = 3—1=2. Эмпирическое значение Н находится между критическими для р = 0,05 и р = 0,01. Следовательно, р < 0,05.

Ш а г 6. На уровне р = 0,05 гипотеза Но отклоняется. Содержательный вывод: сравниваемые выборки различаются статистически достоверно по уровню выраженности признака (р < 0,05).

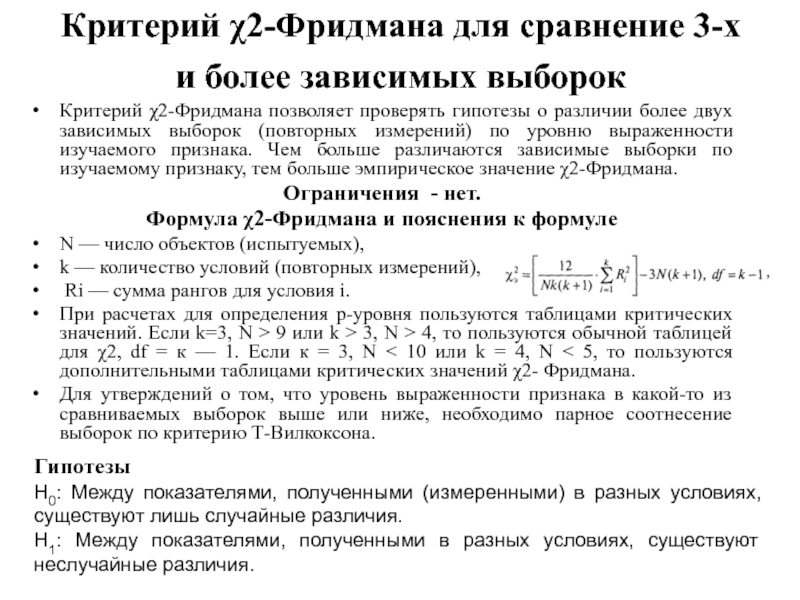

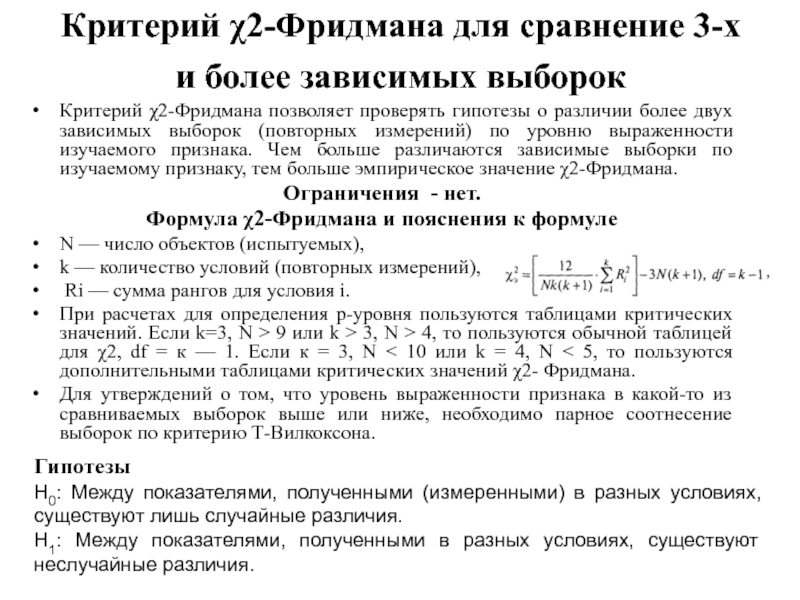

Слайд 126Критерий χ2-Фридмана для сравнение 3-х и более зависимых выборок

Критерий

χ2-Фридмана позволяет проверять гипотезы о различии более двух зависимых выборок

(повторных измерений) по уровню выраженности изучаемого признака. Чем больше различаются зависимые выборки по изучаемому признаку, тем больше эмпирическое значение χ2-Фридмана.

Ограничения - нет.

Формула χ2-Фридмана и пояснения к формуле

N — число объектов (испытуемых),

k — количество условий (повторных измерений),

Ri — сумма рангов для условия i.

При расчетах для определения p-уровня пользуются таблицами критических значений. Если k=3, N > 9 или k > 3, N > 4, то пользуются обычной таблицей для χ2, df = к — 1. Если к = 3, N < 10 или k = 4, N < 5, то пользуются дополнительными таблицами критических значений χ2- Фридмана.

Для утверждений о том, что уровень выраженности признака в какой-то из сравниваемых выборок выше или ниже, необходимо парное соотнесение выборок по критерию Т-Вилкоксона.

Гипотезы

Н0: Между показателями, полученными (измеренными) в разных условиях, существуют лишь случайные различия.

H1: Между показателями, полученными в разных условиях, существуют неслучайные различия.

Слайд 127Нахождение критерия χ2-Фридмана

Шаг 1. Для каждого объекта условия ранжируются

(по строке).

Ш а г 2. Вычисляется сумма рангов для каждого

условия: R1 = 14, R2 = 15, R3 = 9, R4=22.

Ш а г 3. Вычисляется значение χ2-Фридмана по формуле :

χ2 = [ 12/ 6 x 4(4 + 1) x (142+152+92+222)] –3 x 6(4 + 1) = 8,6;

df =3

Ш а г 4. Определяется р-уровень значимости. Так как к > 3, N > 4, то пользуются обычной таблицей для χ2 (приложение 4). Эмпирическое значение χ2 находится между критическими для р = 0,05 и р = 0,01. Следовательно, р< 0,05.

Ш а г 5. Принимается статистическое решение и формулируется содержательный вывод. На уровне а = 0,05 гипотеза Но отклоняется. Содержательный вывод: сравниваемые условия статистически достоверно различаются по уровню выраженности признака (р < 0,05).

Слайд 128Тема 14. Дисперсионный анализ (ANOVA)

Однофакторный дисперсионный анализ ANOVA

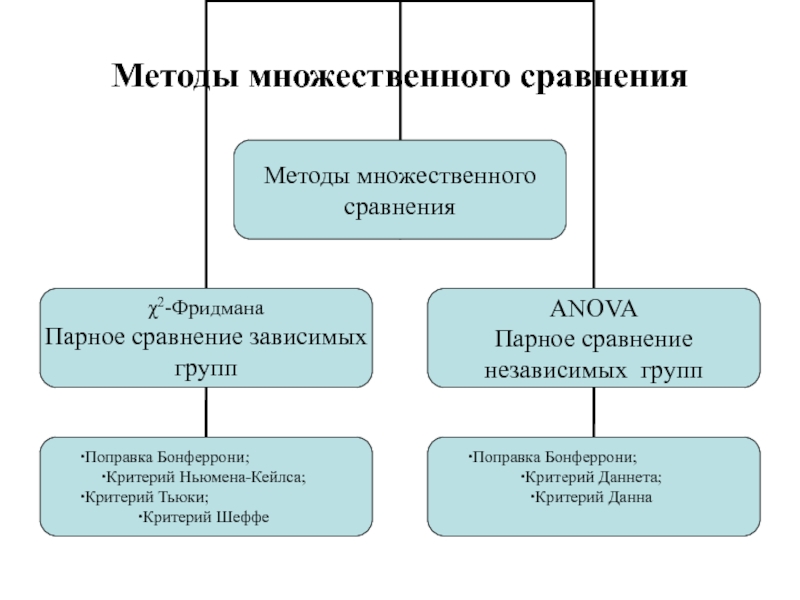

Методы множественного

сравнения

Слайд 129Дисперсионный анализ ANOVA

(от англоязычного ANalysis Of VАriance)

Анализ предназначен

для изучения различий у трех и более выборок в уровне

выраженности признака. Типичная схема эксперимента сводится к изучению влияния независимой переменной (одной или нескольких) на зависимую переменную.

Выделяются два вида переменных – независимая и зависимая. Независимая переменная (Independent Variable) представляет собой качественно определенный (номинативный) признак, имеющий две или более градации. Каждой градации независимой переменной соответствует выборка объектов (испытуемых), для которых определены значения зависимой переменной. Зависимая переменная (Dependent Variable) (должна быть представлена в метрической шкале) в экспериментальном исследовании рассматривается как изменяющаяся под влиянием независимых переменных.

Ограничения

дисперсии выборок, соответствующих разным градациям фактора, равны между собой

Статистические гипотезы

Н0: средние значения признака в выборках 1, 2, 3, … соответствующих разным уровням фактора не отличаются.

Н1: средние значения признака в выборках 1, 2, 3, … соответствующих разным уровням фактора отличаются.

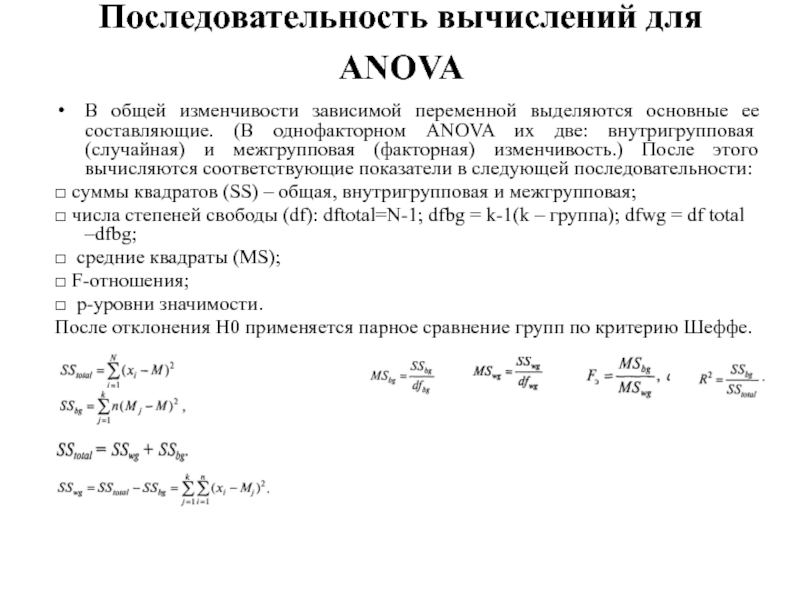

Слайд 130Последовательность вычислений для ANOVA

В общей изменчивости зависимой переменной выделяются

основные ее составляющие. (В однофакторном ANOVA их две: внутригрупповая (случайная)

и межгрупповая (факторная) изменчивость.) После этого вычисляются соответствующие показатели в следующей последовательности:

□ суммы квадратов (SS) – общая, внутригрупповая и межгрупповая;

□ числа степеней свободы (df): dftotal=N-1; dfbg = k-1(k – группа); dfwg = df total –dfbg;

□ средние квадраты (MS);

□ F-отношения;

□ р-уровни значимости.

После отклонения Н0 применяется парное сравнение групп по критерию Шеффе.

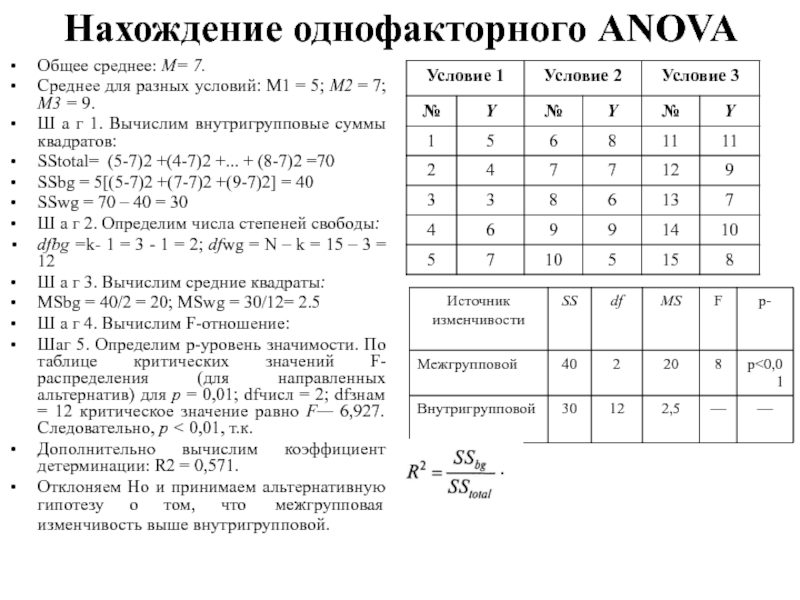

Слайд 132Нахождение однофакторного ANOVA

Общее среднее: М= 7.

Среднее для разных условий: М1

= 5; М2 = 7; М3 = 9.

Ш а г

1. Вычислим внутригрупповые суммы квадратов:

SStotal= (5-7)2 +(4-7)2 +... + (8-7)2 =70

SSbg = 5[(5-7)2 +(7-7)2 +(9-7)2] = 40

SSwg = 70 – 40 = 30

Ш а г 2. Определим числа степеней свободы:

dfbg =k- 1 = 3 - 1 = 2; dfwg = N – k = 15 – 3 = 12

Ш а г 3. Вычислим средние квадраты:

MSbg = 40/2 = 20; MSwg = 30/12= 2.5

Ш а г 4. Вычислим F-отношение:

Шаг 5. Определим p-уровень значимости. По таблице критических значений F-распределения (для направленных альтернатив) для р = 0,01; dfчисл = 2; dfзнам = 12 критическое значение равно F— 6,927. Следовательно, р < 0,01, т.к.

Дополнительно вычислим коэффициент детерминации: R2 = 0,571.

Отклоняем Но и принимаем альтернативную гипотезу о том, что межгрупповая изменчивость выше внутригрупповой.

Слайд 134Тема 15. Многомерные методы

Определение и классификация многомерных методов

Регрессионный анализ (частный

случай множественного регрессионного анализа)

Множественный регрессионный анализ

Дискриминантный анализ

Факторный анализ

Кластерный анализ

Многомерное

шкалирование

Слайд 135Многомерные методы - это математические модели в отношении многостороннего (многомерного)

описания изучаемых явлений. ММ воспроизводят мыслительные операции человека, но в

отношении таких данных, непосредственное осмысление которых невозможно в силу нашей природной ограниченности. Многомерные методы выполняют такие интеллектуальные функции, как структурирование эмпирической информации (факторный анализ), классификация (кластерный анализ), экстраполяция (множественный регрессионный анализ), распознавание образов (дискриминантный анализ) и т. д.

Слайд 137Регрессионный анализ (частный случай множественного регрессионного анализа)

Регрессионный анализ — основан

на коэффициенте детерминации. Регрессионный анализ применяется, для предсказания значения одной

переменной, если известны значения другой, т.е. для исследования взаимосвязи зависимой одной у и одной независимой х переменных.

Линия регрессии, обобщает все точки рассеяния наилучшим способом из возможных. Иными словами, абсолютные значения расстояний по вертикали между каждой точкой графика и линией регрессии минимальны.

Переменная, по которой предсказывают, называется предикторной. Обычно ее значения откладываются по оси X.

Переменная, которую предсказывают, называется критериальной. Ее значения откладываются по оси Y.

Слайд 138Уравнение линейной регрессии

Если переменные пропорциональны друг другу, то графически

связь между ними можно представить в виде прямой линии с

положительным (прямая пропорция) или отрицательным (обратная пропорция) наклоном. Кроме того, если известна пропорция между переменными, заданная уравнением графика прямой линии, то по известным значениям переменной Х можно точно предсказать значения переменной Y.

На практике связь между двумя переменными, если она есть, является вероятностной и графически выглядит как облако рассеивания эллипсоидной формы. Этот эллипсоид, однако, можно представить (аппроксимировать) в виде прямой линии, или линии регрессии.

Линия регрессии (Regression Line) — это прямая, построенная методом наименьших квадратов: сумма квадратов расстояний (вычисленных по оси Y) от каждой точки графика рассеивания до прямой является минимальной:

где уi, — истинное i-значение У,

уi, — оценка i-значения Упри помощи линии (уравнения) регрессии,

еi,-= уi-yi,— ошибка оценки.

Уравнение регрессии имеет вид:

где b — коэффициент регрессии (Regression Coefficient), задающий угол наклона прямой;

а — свободный член, определяющий точку пересечения прямой оси Y.

Угловой коэффициент регрессии (b) показывает, насколько в среднем величина признака у изменяется при соответствующем изменении на единицу признака х. Таким образом, если на некоторой выборке измерены две переменные, которые коррелируют друг с другом, то, вычислив коэффициенты регрессии, мы получаем принципиальную возможность предсказания неизвестных значений одной переменной (Y- зависимая переменная) по известным значениям другой переменной (Х – независимая переменная).

Слайд 139Расчеты уравнения регрессии

Пример: Школьникам была дана тестовая задача, которую им

необходимо было решить, при этом регистрировалось скорость выполнения задания и

количество ошибок. Необходимо установить возможность предсказания количества ошибок в зависимости от скорости выполнения заданий теста и определить параметры уравнения линейной регрессии в зависимости от ошибок и скорости выполнения заданий теста.

Слайд 140Множественный регрессионный анализ

Множественный регрессионный анализ (МРА) предназначен для изучения взаимосвязи

одной переменной (зависимой, результирующей - у) и нескольких других переменных

(независимых, исходных - х). Частный случай регрессионный анализ для исследования взаимосвязи зависимой одной у и одной независимой х переменных.

Ограничения

1. Главное требование к исходным данным — отсутствие линейных взаимосвязей между переменными, когда одна переменная является линейной производной другой переменной. Следует избегать включения в анализ переменных, корреляция между которыми близка к 1, так как сильно коррелирующая переменная не несет для анализа новой информации, добавляя излишний «шум».

2. Следующее требование — переменные должны быть измерены в метрической шкале (интервалов или отношений) и иметь нормальное распределение.

Слайд 141Основными целями МРА являются

Определение того, в какой мере «зависимая» переменная

связана с совокупностью «независимых» переменных, какова статистическая значимость этой взаимосвязи.

Показатель — коэффициент множественной корреляции (КМК - R) и его статистическая значимость по критерию F-Фишера,

Определение существенности вклада каждой «независимой» переменной в оценку «зависимой» переменной, отсев несущественных для предсказания «независимых» переменных. Показатели — регрессионные коэффициенты β, их статистическая значимость по критерию t-Стьюдента.

Анализ точности предсказания и вероятных ошибок оценки «зависимой» переменной. Показатель — квадрат КМК (КМД - R2), интерпретируемый как доля дисперсии «зависимой» переменной, объясняемая совокупностью «независимых» переменных. Вероятные ошибки предсказания анализируются по расхождению (разности) действительных значений «зависимой» переменной и оцененных при помощи модели МРА.

Оценка (предсказание) неизвестных значений «зависимой» переменной по известным значениям «независимых» переменных. Осуществляется по вычисленным параметрам множественной регрессии.

Слайд 142Дискриминантный анализ

Предназначен для изучения взаимосвязи одной переменной (зависимой, результирующей -

у) и нескольких других переменных (независимых, исходных - х).

Ограничения

Зависимая переменная

должна быть представлена в номинативной шкале, а независимые измерены в метрической шкале (интервалов или отношений) и иметь нормальное распределение.

Дискриминантный анализ позволяет решить две группы проблем:

Интерпретировать различия между классами, то есть ответить на вопросы: насколько хорошо можно отличить один класс от другого, используя данный набор переменных; какие из этих переменных наиболее существенны для различения классов.

Классифицировать объекты, то есть отнести каждый объект к одному из классов, исходя только из значений дискриминантных переменных.

Слайд 143Основные результаты дискриминантного анализа

Определение статистической значимости различения классов при

помощи данного набора дискриминантных переменных. Показатели — λ-Вилкса, χ2-тест, р-уровень

значимости.

2. Выяснение вклада каждой переменной в дискриминантный анализ. Определяется по значениям критерия F-Фишера, толерантности и статистики F-удаления.

3. Вычисление расстояний между центроидами классов и определение их статистической значимости по F-критерию.

4. Анализ канонических функций, их интерпретация через дискриминантные переменные (по стандартизированным и структурным коэффициентам канонических функций).

5. Классификация «известных» и «неизвестных» объектов при помощи расстояний или значений априорных вероятностей. Качество классификации определяется совпадением действительной классификации и предсказанной для «известных» объектов. Мерой качества может служить вероятность ошибочной классификации как соотношение количества ошибочного отнесения к общему количеству «известных» объектов.

6. Графическое представление всех объектов и центроидов классов в осях канонических функций.

Слайд 144Факторный анализ

Главная цель факторного анализа — уменьшение размерности исходных

данных.

Результатом факторного анализа является переход от множества исходных переменных

к существенно меньшему числу новых переменных — факторов. Фактор при этом интерпретируется как причина совместной изменчивости нескольких исходных переменных.

Основное назначение факторного анализа — анализ корреляций множества признаков.

Область применения факторного анализа (задачи)

1. Исследование структуры взаимосвязей переменных. В этом случае каждая группировка переменных будет определяться фактором, по которому эти переменные имеют максимальные нагрузки. Нагрузки исследуемых факторов представляют корреляцию с общими факторами.

2. Идентификация факторов как скрытых (латентных) переменных — причин взаимосвязи исходных переменных.

3. Вычисление значений факторов для испытуемых как новых, интегральных переменных. При этом число факторов существенно меньше числа исходных переменных. В этом смысле факторный анализ решает задачу сокращения количества признаков с минимальными потерями исходной информации.

Слайд 145Основные этапы факторного анализа

Выбор исходных данных.

Предварительное решение проблемы числа

факторов: используются критерий отсеивания Р. Кетелла (требует построения графика) и

критерий Г. Кайзера (определяется по числу компонент, собственные значения которых больше 1).

Факторизация матрицы интеркорреляций, вращение факторов (Задается число факторов, производится вращение методом «Варимакс-нормализованное». Результатом данного этапа является матрица факторных нагрузок (факторная структура) .

Интерпретация факторов: По каждому фактору выписывают наименования (обозначения) переменных, имеющих наибольшие нагрузки по этому фактору — выделенных на предыдущем шаге. При этом обязательно учитывается знак факторной нагрузки переменной. Если знак отрицательный, это отмечается как противоположный полюс переменной. После такого просмотра всех факторов каждому из них присваивается наименование, обобщающее по смыслу включенные в него переменные.

Слайд 146Кластерный анализ

Кластерный анализ — это процедура упорядочивания объектов в

сравнительно однородные классы на основе попарного сравнения этих объектов по

предварительно определенным и измеренным критериям.

Кластерный анализ решает задачу построения классификации, то есть разделения исходного множества объектов на группы (классы, кластеры).

Классификация объектов — это группирование их в классы так, чтобы объекты в каждом классе были более похожи друг на друга, чем на объекты из других классов.

Задачи кластерного анализа:

разбиение совокупности испытуемых на группы по измеренным признакам с целью дальнейшей проверки причин межгрупповых различий по внешним критериям, например, проверка гипотез о том, проявляются ли типологические различия между испытуемыми по измеренным признакам;

применение кластерного анализа как значительно более простого и наглядного аналога факторного анализа, когда ставится только задача группировки признаков на основе их корреляции.

Слайд 147Этапы кластерного анализа

1. Отбор объектов для кластеризации. Объектами могут быть,

в зависимости от цели исследования: а) испытуемые; б) объекты, которые

оцениваются испытуемыми; в) признаки, измеренные на выборке испытуемых.

Определение множества переменных, по которым будут различаться объекты кластеризации. Для испытуемых — это набор измеренных признаков, для оцениваемых объектов — субъекты оценки, для признаков — испытуемые.

Выбор и применение метода классификации для создания групп сходных объектов. Это вторая и центральная проблема кластерного анализа. Ее весомость связана с тем, что разные методы кластеризации порождают разные группировки для одних и тех же данных. Наиболее популярные методы: одиночной связи, полной связи и средней связи.

Проверка достоверности разбиения на классы (используются критерии сравнения).

Слайд 148Многомерное шкалирование

Основная цель многомерного шкалирования (МШ) — выявление структуры исследуемого

множества объектов

Главная задача МШ — реконструкция психологического пространства, заданного

небольшим числом измерений-шкал, которые интерпретируются как критерии, лежащие в основе различий стимулов.

Слайд 149Основные этапы многомерного шкалирования

Определение величины стресса (φ-Stress), который является показателем

точности - наиболее приемлемый для него диапазон от 0,05 до

0,2. Вычисление коэффициентов отчуждения (D-star) и напряжения (D-hat). Чем меньше эти величины тем лучше воспроизведена матрица расстояния в наблюдаемой модели.

Построение итоговой конфигурации нагрузки объектов по выделенным шкалам.

Построение графика.

Интерпретация шкал по итоговой конфигурации и графику (интерпретация шкал осуществляется через входящие в них объекты).

Слайд 150Тема 16. Математическое моделирование в психологии

Системные подходы.

Теория функциональных систем.

Становление кибернетики.

Системный анализ.

Теория катастроф.

Методы математического моделирования в

психодиагностике: априорные и апостериорные модели.

Проблема искусственного интеллекта.

Слайд 151Система - множество элементов, находящихся в отношениях и связях друг

с другом, которое образует определенную целостность, единство.

Признаки системы:

система обладает целостностью,

все ее части служат достижению единой цели;

система является большой как с точки зрения разнообразия составляющих ее элементов, так и с точки зрения количества одинаковых частей;

система является сложной, что означает наличие большего количества связей между элементами как по вертикали, так и по горизонтали. Следовательно, изменение в каком - либо одном компоненте влечет за собой изменение в других;

независимо от сложности и размера система обладает чертами «черного ящика», их поведение в любой момент недетерминировано как в силу стохастической природы входных действий, так и внутреннего ее поведения;

большинство систем, и в первую очередь наиболее сложные системы, содержат элементы конкурентной ситуации, т.е. обязательно существуют элементы, которые стремятся уменьшить эффективность системы.

Слайд 152Теория функциональных систем (модель П. К. Анохина)

Центральная нервная система представлена

в виде нервной модели

Слайд 153Кибернетика Н. Винера

Человек, один из самых сложных объектов реального мира,

известных науке в настоящее время. Он не только самоактуализирующийся и

саморегулируемый, но и саморазвивающийся объект. Его свойство как саморазвивающегося объекта состоит в том, что он в состоянии самостоятельно создавать и изменять программу своих действий.

Другое дело технические системы. В отличие от живого организма все можно оценить и исследовать с момента их создания. Можно установить закономерности их функционирования.

Слайд 154Синергетика (Г. Хакена)

По Хакену, синергетика занимается изучением систем, состоящих из

большого (очень большого, «огромного») числа частей, компонент или подсистем, одним

словом, деталей, сложным образом взаимодействующих между собой. Слово «синергетика» и означает «совместное действие», подчеркивая согласованность функционирования частей, отражающуюся в поведении системы как целого.

Синергетический процесс самоорганизации материи это бесконечное чередование этапов «спокойной» адаптации и «революционных» перерождений, выводящих системы на новые ступени совершенства.

Слайд 155Общая теория систем Л. Фон Берталанфи

Общая теория систем Л. Фон

Берталанфи состоит в том, что если замкнутую систему вывести из

состояния равновесия, то в ней начнутся процессы, возвращающие ее к состоянию термодинамического равновесия, в котором ее энтропия достигает максимального значения.

Слайд 156Теория развития И.Р. Пригожина

Теория развития И.Р. Пригожина гласит, что если

отток энтропии (меры необратимого рассеяния энергии) превышает ее внутреннее производство,

то возникают и разрастаются до макроскопического уровня крупномасштабные флуктуации.

Слайд 157Теория катастроф

Катастрофами называются скачкообразные изменения, возникающие в виде внезапного ответа

объекта па плавные изменения внешних условий.

Слайд 158Системный анализ

Системный анализ - научная дисциплина, разрабатывающая общие принципы исследования

сложных объектов с учетом их системного характера.

Этапы системного анализа любого

объекта:

Постановка задачи - определение объекта исследования, постановка целей, задание критериев для изучения объекта и управления им.

Выделение системы, подлежащей изучению, и ее структуризация.

Составление математической модели изучаемой системы: параметризация, установление зависимостей между введенными параметрами, упрощение описания системы путем выделения подсистем и определения их иерархии, окончательная функция целей и критериев.

Слайд 159Моделирование сложных систем

Этапы моделирования сложных процессов и явлений:

Формулировка цели моделирования.

Анализ

объекта исследования, включающий статистическую

обработку параметров для определения математического ожидания,

типа распределения

и других описательных статистик.

Выявление причинно-следственных связей. Определение независимых и зависимых переменных. Для этого используется математический аппарат кластерного анализа, называемый также аппаратом поиска естественной классификации.

Определение степени сложности и организации моделируемой

системы.

Выбор класса и вида модели. В зависимости от уровня организации объекта выбирается класс математической модели: линейная,

нелинейная, детерминированная, вероятностная. Класс модели во

многом определяет математический аппарат, наиболее подходящий

для описания работы модели. В выбранном классе определяется вид

модели. Существует множество видов внутри одного класса. Так, например, к классу нелинейных моделей относятся полиномиальные, дифференциальные уравнения и т. д.

Синтез параметров модели или собственно моделирование.

Верификация созданной модели с использованием независимого массива.

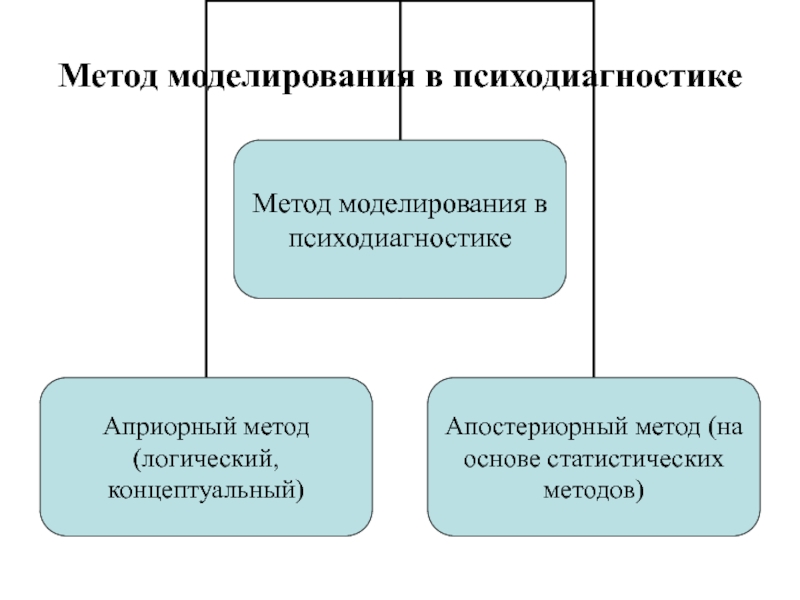

Слайд 160Метод моделирования в психодиагностике

Слайд 161Тема 17. Анализ данных на компьютере.

Использование MS Excel

Статистические

пакеты: SPSS, STATISTICA.

Особенности подготовки данных для анализа на компьютере.

Слайд 162Алгоритм применения анализа данных на компьютере

Слайд 163Использование MS Excel

Плюсы и минусы MC Excel

В Microsoft Excel

входит набор средств анализа данных (так называемый пакет анализа), предназначенный

для решения довольно сложных статистических задач. Для проведения анализа данных с помощью этих инструментов следует указать входные данные и выбрать параметры; анализ будет проведен с помощью подходящей статистической макрофункции, а результат будет помещен в выходной диапазон. Другие инструменты позволяют представить результаты анализа в графическом виде. Статистические методы, имеющихся в пакете анализа, достаточно для обработки первичных данных.

Однако при больших массивах данных, анализ в этой программной среде приводит к существенному увеличению ошибок. Кроме того, отсутствие в Microsoft Excel возможности кодирования номинальных и порядковых показателей приводит к необходимости многократной сортировки данных по номинальным показателям, если в исследовании их несколько. И, наконец, пакет анализа достаточно капризен. Например, если в массиве данных имеется, хотя бы один пропуск (незаполненная ячейка), Microsoft Excel отказывается считать корреляцию и т. д.

Слайд 164Статистические пакеты: SPSS, STATISTICA

STATISTICA for Windows представляет собой интегрированную

систему статистического анализа и обработки данных. Она состоит из следующих

основных компонент, которые объединены в рамках одной системы:

электронных таблиц для ввода и задания исходных данных, а также специальных таблиц для вывода численных результатов анализа;

мощной графической системы для визуализации данных и результатов статистического анализа;

набора специализированных статистических модулей, в которых собраны группы логически связанных между собой статистических процедур;

специального инструментария для подготовки отчетов;

встроенных языков программирования SCL (STATISTICA Command Language) и STATISTICA BASIC, которые позволяют пользователю расширить стандартные возможности системы.

Слайд 165SPSS

Альтернативное программное обеспечение SPSS включает также все процедуры ввода, отбора

и корректировки данных, а также большинство предлагаемых в SPSS статистических

методов, что и в STATISTICA. Наряду с простыми методиками статистического анализа, такими как частотный анализ, расчет статистических характеристик, таблиц сопряженности, корреляций, построения графиков, этот модуль включает t-тесты и большое количество других непараметрических тестов, а также усложненные методы, такие как многомерный линейный регрессионный анализ, дискриминантный анализ, факторный анализ, кластерный анализ, дисперсионный анализ, анализ пригодности (анализ надежности) и многомерное шкалирование.