Разделы презентаций

- Разное

- Английский язык

- Астрономия

- Алгебра

- Биология

- География

- Геометрия

- Детские презентации

- Информатика

- История

- Литература

- Математика

- Медицина

- Менеджмент

- Музыка

- МХК

- Немецкий язык

- ОБЖ

- Обществознание

- Окружающий мир

- Педагогика

- Русский язык

- Технология

- Физика

- Философия

- Химия

- Шаблоны, картинки для презентаций

- Экология

- Экономика

- Юриспруденция

Тема 1. Понятие информации и общая характеристика процессов ее сбора, передачи,

Содержание

- 1. Тема 1. Понятие информации и общая характеристика процессов ее сбора, передачи,

- 2. Слайд 2

- 3. Байт = 8 бит – наименьшая единица

- 4. В теории информации определяют синтаксическое количество

- 5. Для случая, когда все состояния системы равновероятны,

- 6. Формула Хартли выводится из формулы Шеннона при

- 7. Пример:По каналу связи передается n-разрядное сообщение, использующее

- 8. При Sp → 0 пользователь не воспринимает,

- 9. Sp = Spopt означает, что поступающая

- 10. Представление (кодирование) данныхПредставление данных – это подготовка

- 11. Система счисления – совокупность приемов записи и

- 12. Самым простым примером непозиционной системы счисления является

- 13. Двоичная система используется в цифровых устройствах, поскольку

- 14. В ВТ, с целью упрощения реализации арифметических

- 15. Обратный код для положительных чисел совпадает с

- 16. Дополнительный код положительного числа совпадает с

- 17. Кодирование текстовой информацииБазовая таблица закрепляет значения кодов

- 18. Необходимо помнить, что в настоящее время для

- 19. Скачать презентанцию

Байт = 8 бит – наименьшая единица информации, которая может иметь адрес;1 килобайт = 2 10 байта = 1024 байта;1 Мегабайт = 220 байта = 1 048 576 байтов;1 Гигабайт =

Слайды и текст этой презентации

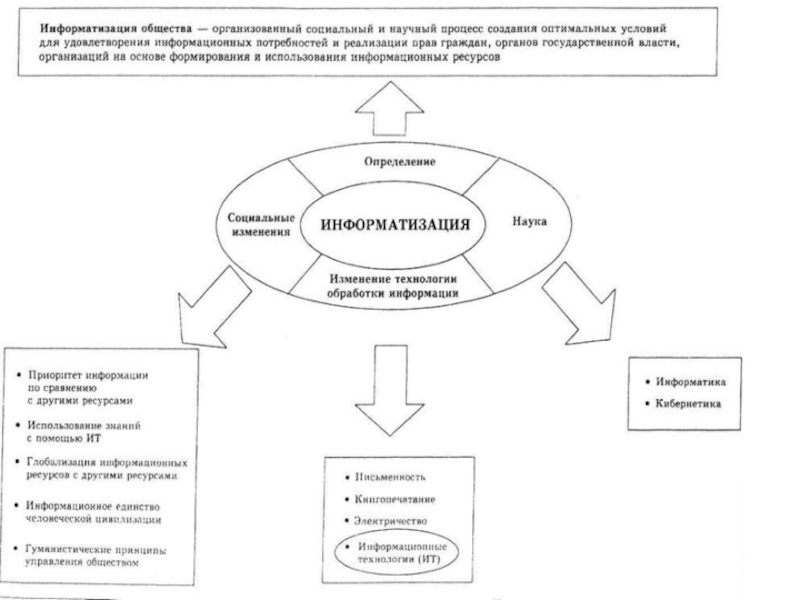

Слайд 1Тема 1. Понятие информации и общая характеристика процессов ее сбора,

передачи, обработка и накопления.

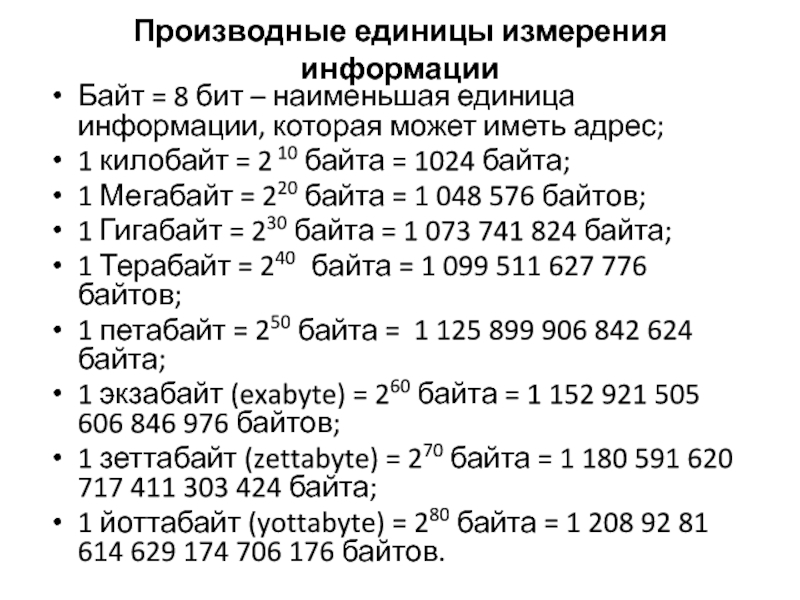

Слайд 3Байт = 8 бит – наименьшая единица информации, которая может

иметь адрес;

1 килобайт = 2 10 байта = 1024 байта;

1

Мегабайт = 220 байта = 1 048 576 байтов;1 Гигабайт = 230 байта = 1 073 741 824 байта;

1 Терабайт = 240 байта = 1 099 511 627 776 байтов;

1 петабайт = 250 байта = 1 125 899 906 842 624 байта;

1 экзабайт (exabyte) = 260 байта = 1 152 921 505 606 846 976 байтов;

1 зеттабайт (zettabyte) = 270 байта = 1 180 591 620 717 411 303 424 байта;

1 йоттабайт (yottabyte) = 280 байта = 1 208 92 81 614 629 174 706 176 байтов.

Производные единицы измерения информации

Слайд 4 В теории информации определяют синтаксическое количество информации на основе

энтропии системы.

Энтропия системы α, имеющая N возможных

состояний, согласно формуле Шеннона, равна:где pi — вероятность того, что система находится в i-ом состоянии.

Слайд 5Для случая, когда все состояния системы равновероятны, т.е. их вероятности

равны Pi =

ее энтропия определяется соотношением

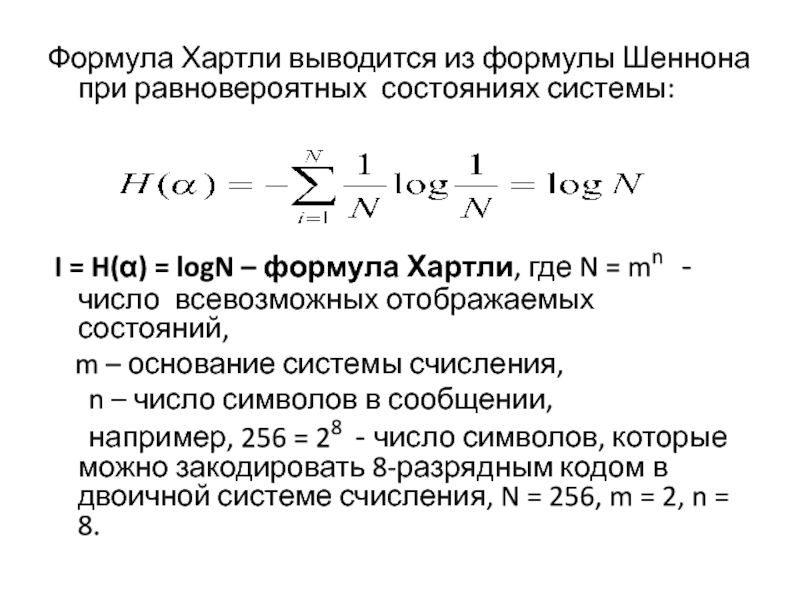

Слайд 6Формула Хартли выводится из формулы Шеннона при равновероятных состояниях системы:

I = H(α) = logN – формула Хартли,

где N = mn - число всевозможных отображаемых состояний,m – основание системы счисления,

n – число символов в сообщении,

например, 256 = 28 - число символов, которые можно закодировать 8-разрядным кодом в двоичной системе счисления, N = 256, m = 2, n = 8.

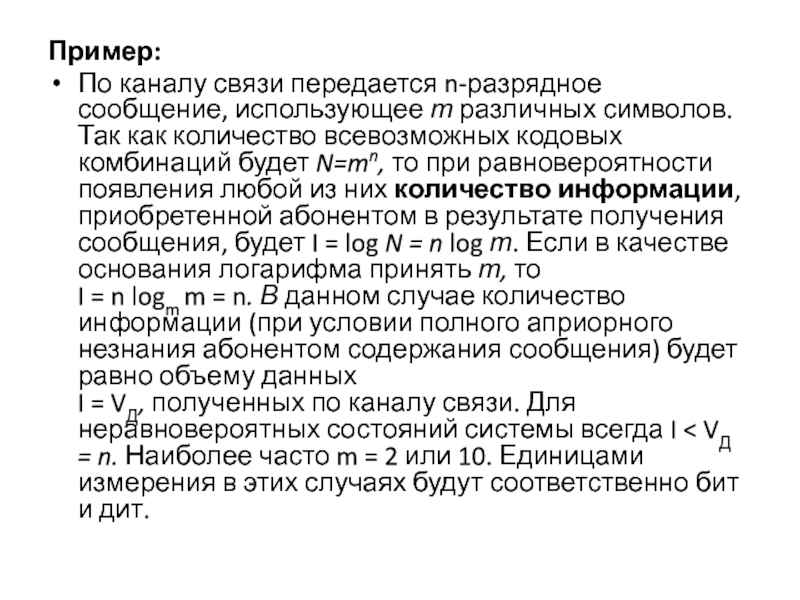

Слайд 7Пример:

По каналу связи передается n-разрядное сообщение, использующее т различных символов.

Так как количество всевозможных кодовых комбинаций будет N=mn, то при

равновероятности появления любой из них количество информации, приобретенной абонентом в результате получения сообщения, будет I = log N = n log т. Если в качестве основания логарифма принять т, то I = n logm m = n. В данном случае количество информации (при условии полного априорного незнания абонентом содержания сообщения) будет равно объему данных I = VД, полученных по каналу связи. Для неравновероятных состояний системы всегда I < VД = n. Наиболее часто m = 2 или 10. Единицами измерения в этих случаях будут соответственно бит и дит.Слайд 8

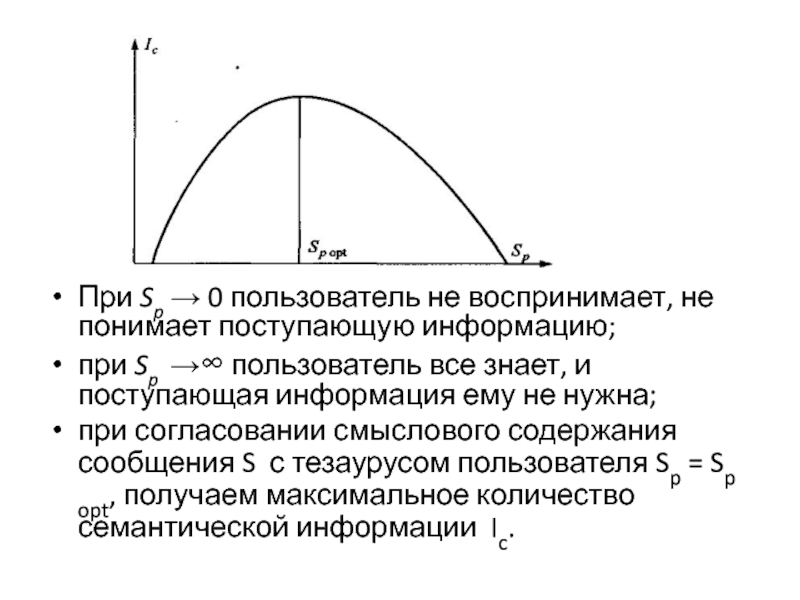

При Sp → 0 пользователь не воспринимает, не понимает поступающую

информацию;

при Sp →∞ пользователь все знает, и поступающая информация ему

не нужна;при согласовании смыслового содержания сообщения S с тезаурусом пользователя Sp = Sp opt, получаем максимальное количество семантической информации Ic.

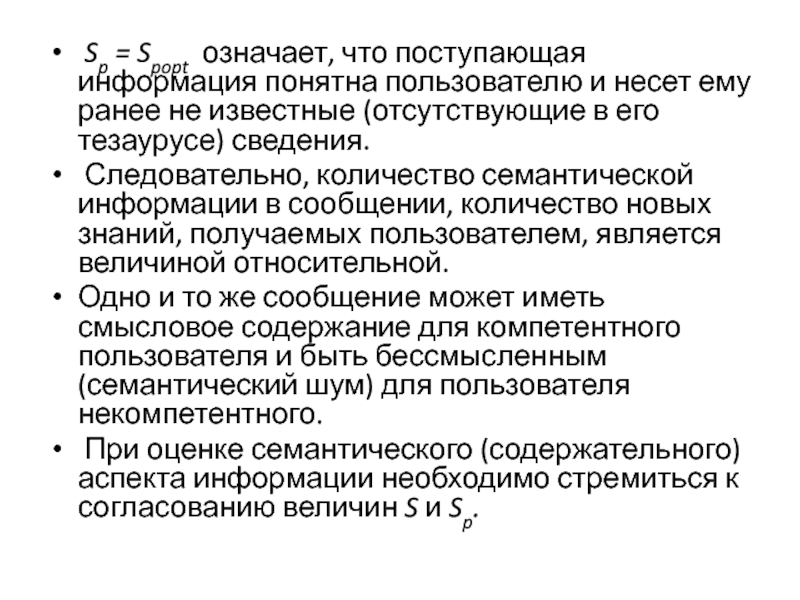

Слайд 9 Sp = Spopt означает, что поступающая информация понятна пользователю

и несет ему ранее не известные (отсутствующие в его тезаурусе)

сведения.Следовательно, количество семантической информации в сообщении, количество новых знаний, получаемых пользователем, является величиной относительной.

Одно и то же сообщение может иметь смысловое содержание для компетентного пользователя и быть бессмысленным (семантический шум) для пользователя некомпетентного.

При оценке семантического (содержательного) аспекта информации необходимо стремиться к согласованию величин S и Sp.

Слайд 10Представление (кодирование) данных

Представление данных – это подготовка данных для обработки

на компьютере.

Двоичное кодирование – универсальная форма представления данных для дальнейшей

обработки их средствами вычислительной техники.Данные располагаются в ячейках, представляющих упорядоченную совокупность из двоичных разрядов (каждый разряд может временно содержать одно из двух состояний - 0 или 1). Тогда группой из 8 двоичных разрядов можно закодировать 28 = 256 различных комбинаций кода.

Sp = Spopt означает, что поступающая информация понятна пользователю и несет ему ранее не известные (отсутствующие в его тезаурусе) сведения.

Слайд 11Система счисления – совокупность приемов записи и наименования чисел.

Системы счисления

подразделяются на позиционные и непозиционные.

В позиционных системах счисления величина, обозначаемая

цифрой в записи числа, зависит от её положения в числе (позиции). Количество используемых цифр называется основанием системы счисления

В непозиционных системах счисления величина, которую обозначает цифра, не зависит от положения в числе.

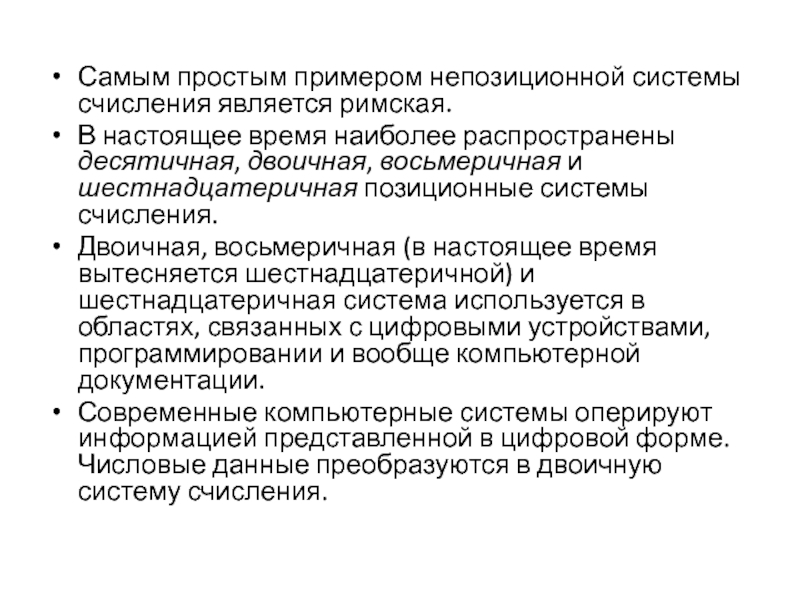

Слайд 12Самым простым примером непозиционной системы счисления является римская.

В настоящее

время наиболее распространены десятичная, двоичная, восьмеричная и шестнадцатеричная позиционные системы

счисления.Двоичная, восьмеричная (в настоящее время вытесняется шестнадцатеричной) и шестнадцатеричная система используется в областях, связанных с цифровыми устройствами, программировании и вообще компьютерной документации.

Современные компьютерные системы оперируют информацией представленной в цифровой форме. Числовые данные преобразуются в двоичную систему счисления.

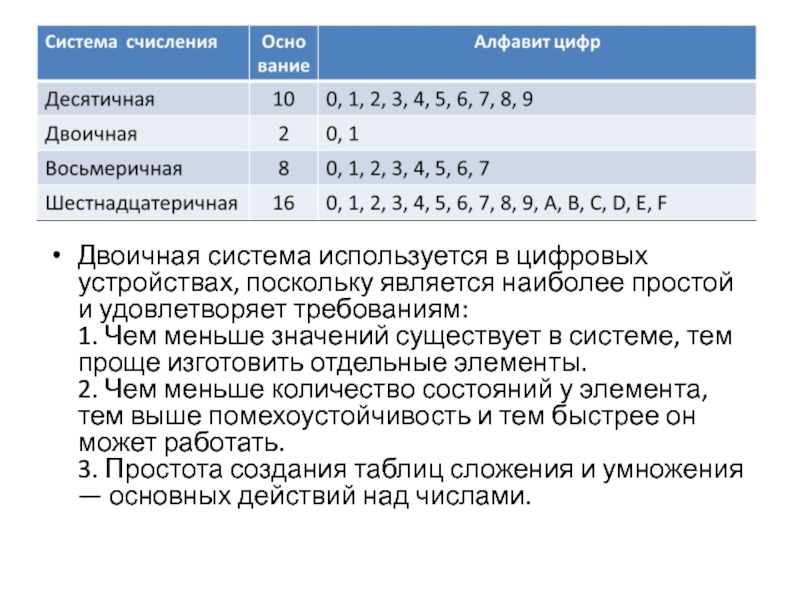

Слайд 13

Двоичная система используется в цифровых устройствах, поскольку является наиболее простой

и удовлетворяет требованиям: 1. Чем меньше значений существует в системе, тем

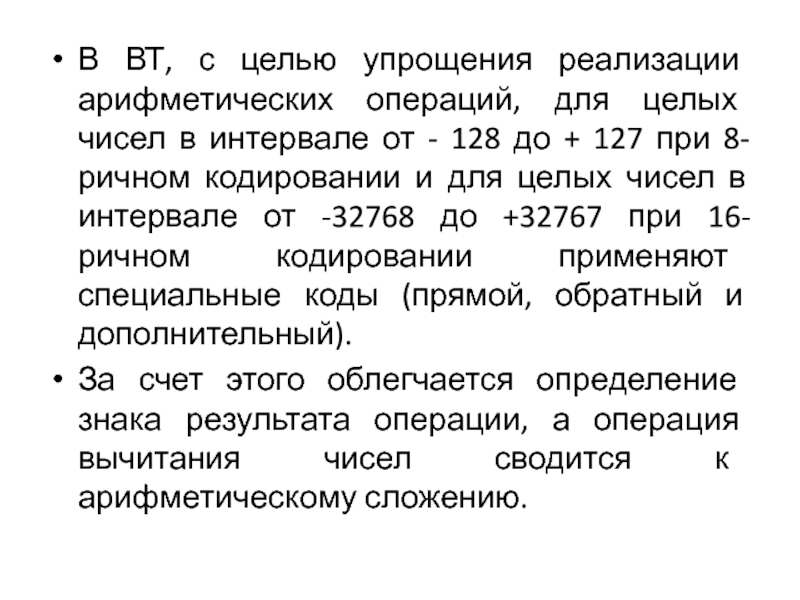

проще изготовить отдельные элементы. 2. Чем меньше количество состояний у элемента, тем выше помехоустойчивость и тем быстрее он может работать. 3. Простота создания таблиц сложения и умножения — основных действий над числами.Слайд 14В ВТ, с целью упрощения реализации арифметических операций, для целых

чисел в интервале от - 128 до + 127 при

8-ричном кодировании и для целых чисел в интервале от -32768 до +32767 при 16-ричном кодировании применяют специальные коды (прямой, обратный и дополнительный).За счет этого облегчается определение знака результата операции, а операция вычитания чисел сводится к арифметическому сложению.

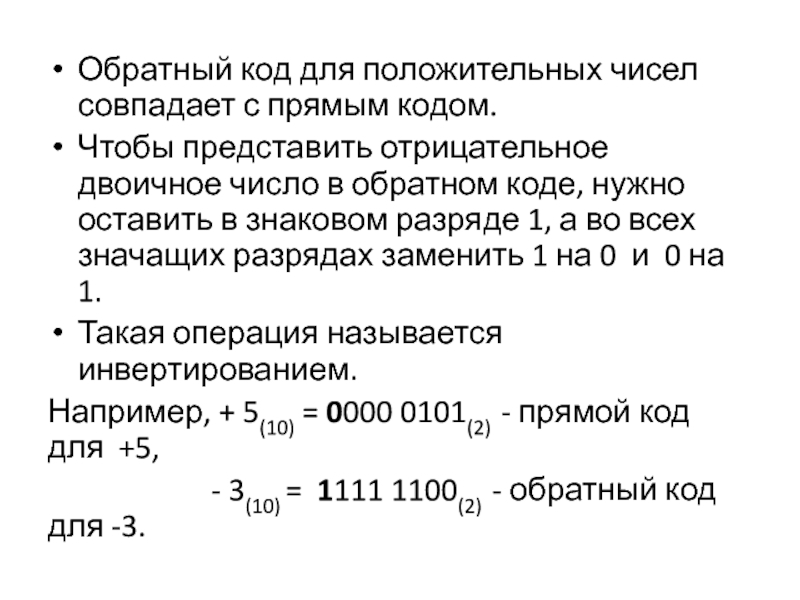

Слайд 15Обратный код для положительных чисел совпадает с прямым кодом.

Чтобы

представить отрицательное двоичное число в обратном коде, нужно оставить в

знаковом разряде 1, а во всех значащих разрядах заменить 1 на 0 и 0 на 1.Такая операция называется инвертированием.

Например, + 5(10) = 0000 0101(2) - прямой код для +5,

- 3(10) = 1111 1100(2) - обратный код для -3.

Слайд 16 Дополнительный код положительного числа совпадает с прямым кодом.

Дополнительный

код отрицательного числа может быть получен из обратного кода путем

прибавления 1 к младшему разряду обратного кода.Например, + 5(10) = 0000 0101(2) - прямой для +5,

- 3(10) = 1111 1100(2) - обратный код для -3,

+ 1

1111 1101(2) - дополнительный код для -3.

Слайд 17Кодирование текстовой информации

Базовая таблица закрепляет значения кодов от 0 до

127, а расширенная относится к символам с номерами от 128

до 255.Первые 32 кода базовой таблицы, начиная с нулевого, отданы производителям аппаратных средств(компьютеров, печатающих устройств). С 32 по 127 размещены коды символов латинского алфавита, знаков препинания, цифр, арифметических действий и специальных символов.

Национальные системы кодирования используют расширенную часть ASCII (коды 128 255).

Слайд 18Необходимо помнить, что в настоящее время для кодировки русских букв

используют пять различных кодовых таблиц (КОИ - 8, СР1251, СР866,

Мас, ISO), причем тексты, закодированные при помощи одной таблицы не будут правильно отображаться в другой кодировке.В большинстве случаев о перекодировке текстовых документов заботится не пользователь, а специальные программы - конверторы, которые встроены в приложения.