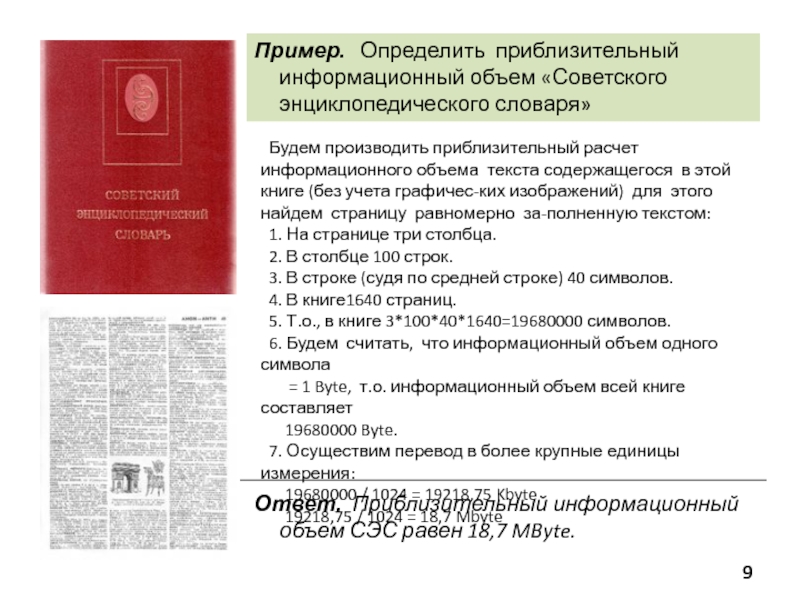

энциклопедического словаря»

Будем производить приблизительный расчет информационного объема текста

содержащегося в этой книге (без учета графичес-ких изображений) для этого найдем страницу равномерно за-полненную текстом:

1. На странице три столбца.

2. В столбце 100 строк.

3. В строке (судя по средней строке) 40 символов.

4. В книге1640 страниц.

5. Т.о., в книге 3*100*40*1640=19680000 символов.

6. Будем считать, что информационный объем одного символа

= 1 Byte, т.о. информационный объем всей книге составляет

19680000 Byte.

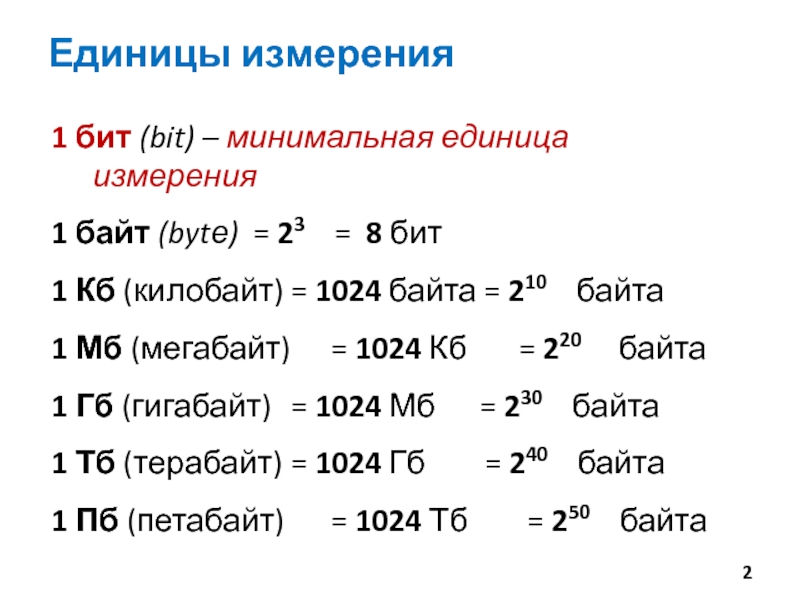

7. Осуществим перевод в более крупные единицы измерения:

19680000 / 1024 = 19218,75 Kbyte

19218,75 / 1024 = 18,7 Mbyte

Ответ. Приблизительный информационный

объем СЭС равен 18,7 MByte.