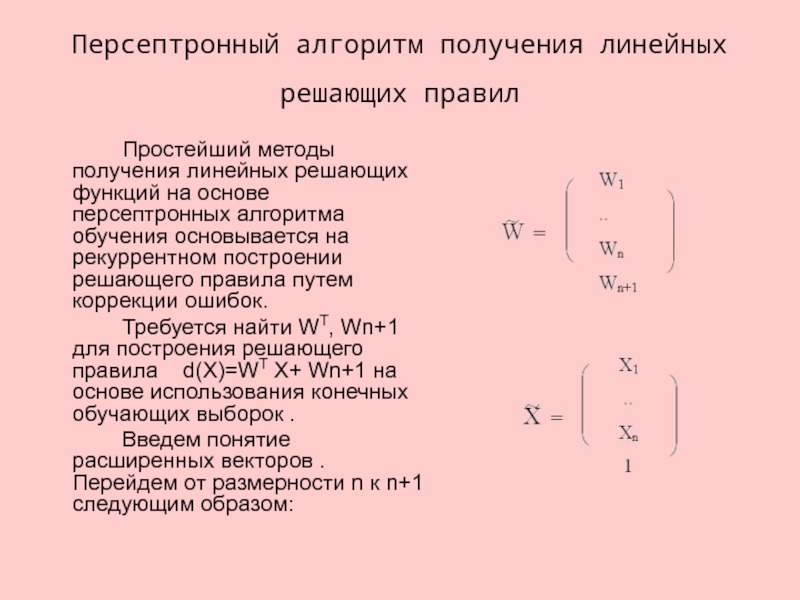

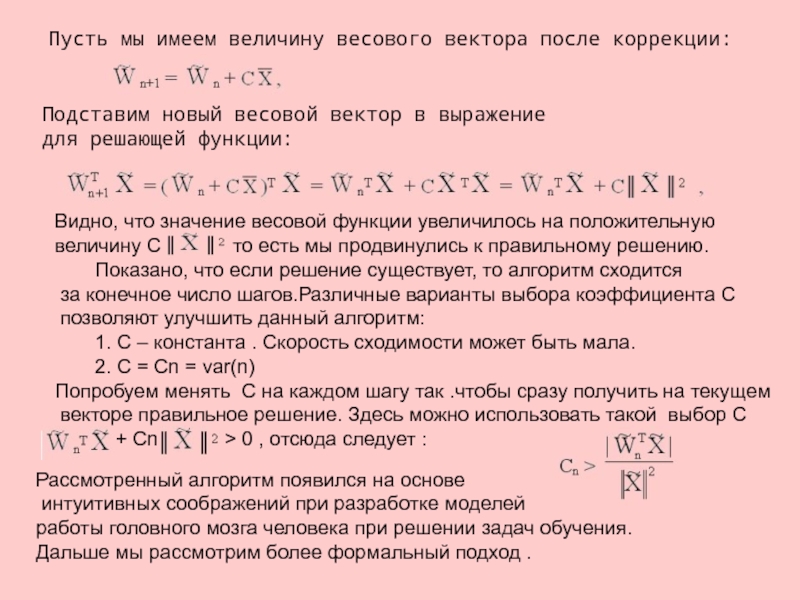

вектор в выражение

для решающей функции:

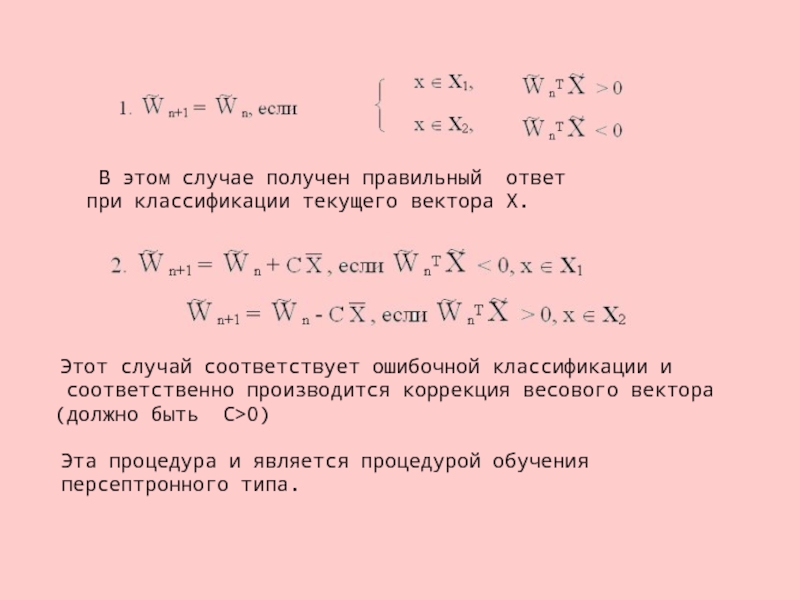

Видно, что значение весовой функции

увеличилось на положительную

величину C , то есть мы продвинулись к правильному решению.

Показано, что если решение существует, то алгоритм сходится

за конечное число шагов.Различные варианты выбора коэффициента C

позволяют улучшить данный алгоритм:

1. С – константа . Скорость сходимости может быть мала.

2. С = Cn = var(n)

Попробуем менять C на каждом шагу так .чтобы сразу получить на текущем

векторе правильное решение. Здесь можно использовать такой выбор С

+ Cn > 0 , отсюда следует :

Рассмотренный алгоритм появился на основе

интуитивных соображений при разработке моделей

работы головного мозга человека при решении задач обучения.

Дальше мы рассмотрим более формальный подход .