Разделы презентаций

- Разное

- Английский язык

- Астрономия

- Алгебра

- Биология

- География

- Геометрия

- Детские презентации

- Информатика

- История

- Литература

- Математика

- Медицина

- Менеджмент

- Музыка

- МХК

- Немецкий язык

- ОБЖ

- Обществознание

- Окружающий мир

- Педагогика

- Русский язык

- Технология

- Физика

- Философия

- Химия

- Шаблоны, картинки для презентаций

- Экология

- Экономика

- Юриспруденция

Лекция 6,7 Понятие информация Введение в теорию информации Понятие

Содержание

- 1. Лекция 6,7 Понятие информация Введение в теорию информации Понятие

- 2. Понятие «информация»Знания, сведения, сообщения, известия и т.д.Сознание

- 3. «Сигнал» - материальный носитель информации

- 4. Объекты достаточно устойчивы во времени и к

- 5. Непредсказуемость – основное свойств осигналов

- 6. Случайный процесс – модель сигнала

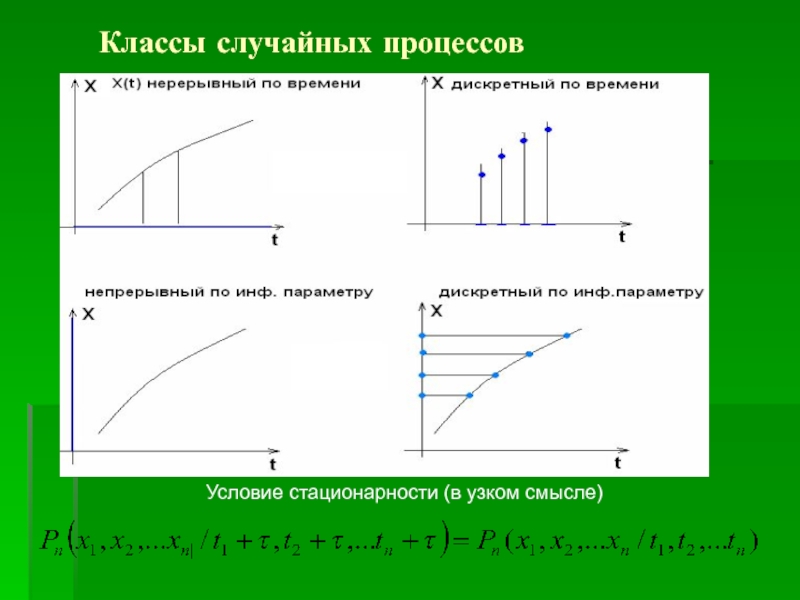

- 7. Классы случайных процессовУсловие стационарности (в узком смысле)

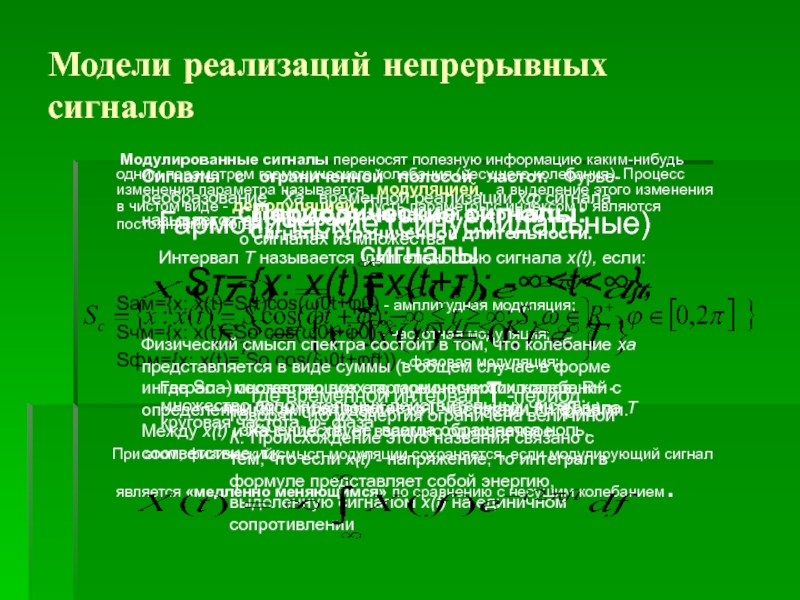

- 8. Модели реализаций непрерывных сигналовГармонические (синусоидальные) сигналы

- 9. Принцип частотно-временной неопределённости Т.к.

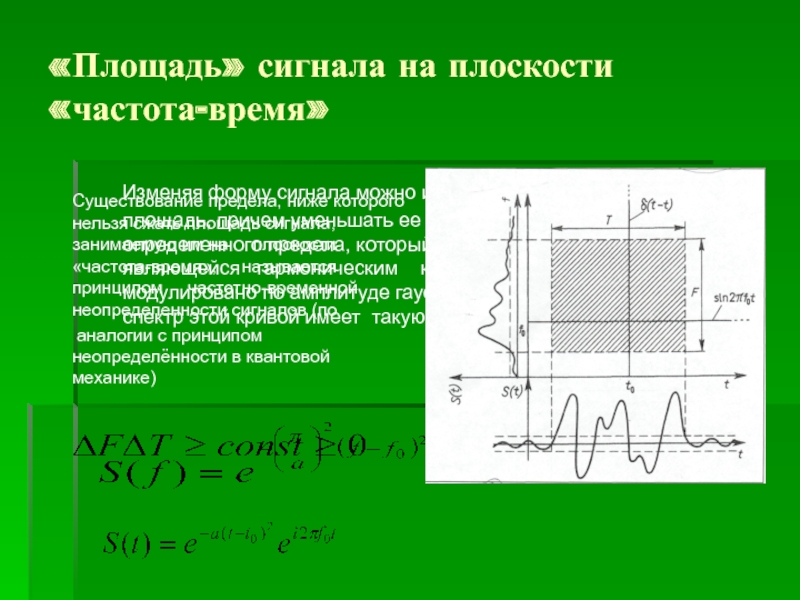

- 10. «Площадь» сигнала на плоскости «частота-время» Изменяя

- 11. Проблема дискретного представления непрерывных сигналов

- 12. Введение в теорию информации Научная

- 13. Понятие «энтропии» Для характеристики

- 14. Понятие «энтропии» Количественной мерой

- 15. Дифференциальная энтропия Теперь величину

- 16. Понятие «количество информации» Современное

- 17. Свойство симметрии количества информации

- 18. Единицы измерения количества информации и энтропии, их

- 19. Избыточность Для описания этого

- 20. Скорость передачи информации Существует

- 21. Основные результаты теории информации

- 22. Техническое выполнение презентации:Студент группы 41-Р Змеёв. А.А.Руководители:

- 23. Скачать презентанцию

Слайды и текст этой презентации

Слайд 1Лекция 6,7

Понятие «информация»

Введение в теорию информации

Понятие «энтропии»

Понятие «количество информации»

Основные результаты

теории информации

Слайд 2Понятие «информация»

Знания, сведения, сообщения, известия и т.д.

Сознание человека

Отражения реального мира

в различной форме

Психика (человека и животных)

Раздражимость(охватывает всю органическую природу)

Запечатление

взаимодействия (присуще и неорганической природе, элементарным частицам – т.е. материи вообще). Как только состояние одного объекта приходит в соответствие с состоянием другого объекта.

Соответствие устанавливается в результате физического взаимодействия между объектами, причём чаще всего посредством взаимодействия с одним или несколькими промежуточными объектами.

Слайд 3«Сигнал» - материальный носитель информации

Материальным

носителем информации в пространстве и времени являются состояния объектов, которые

называются сигналами Один и тот же объект может переносить разные сигналы

Не всякое состояние имеет сигнальные свойства

Объект носитель сигнала взаимодействует не только с объектами, которые обмениваются сигналами, но и с другими, что приводит к ослаблению соответствия состояний

Посторонние воздействия, нарушающие сигнальное соответствие называют помехами и шумами

Условия способствующие установлению и сохранению сигнального соответствия называются кодом

ночь

день

помеха / шум

небо

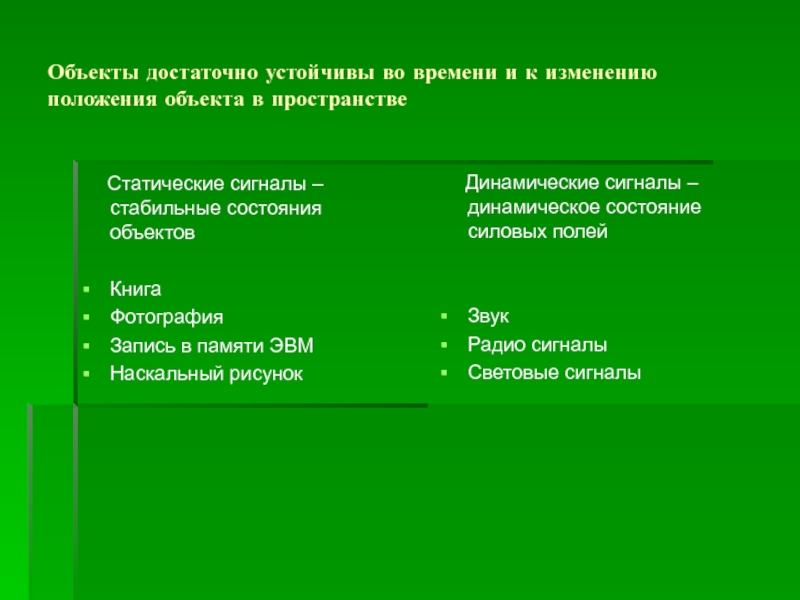

Слайд 4Объекты достаточно устойчивы во времени и к изменению положения объекта

в пространстве

Статические сигналы – стабильные состояния объектов

Книга

Фотография

Запись

в памяти ЭВМНаскальный рисунок

Динамические сигналы – динамическое состояние силовых полей

Звук

Радио сигналы

Световые сигналы

Используются для хранения информации

Используются для передачи информации

Слайд 5Непредсказуемость – основное свойств осигналов

x1(t)

x2(t)Реализация x3(t)

x4(t)

X5(t)

Таким образом x(t) приобретает сигнальные свойства если

является одной из возможных реализаций в ансамбле

неизвестно какая реализация будет отправлена

Пусть X(t) функциональная зависимость состояния объекта от времени

ансамбль

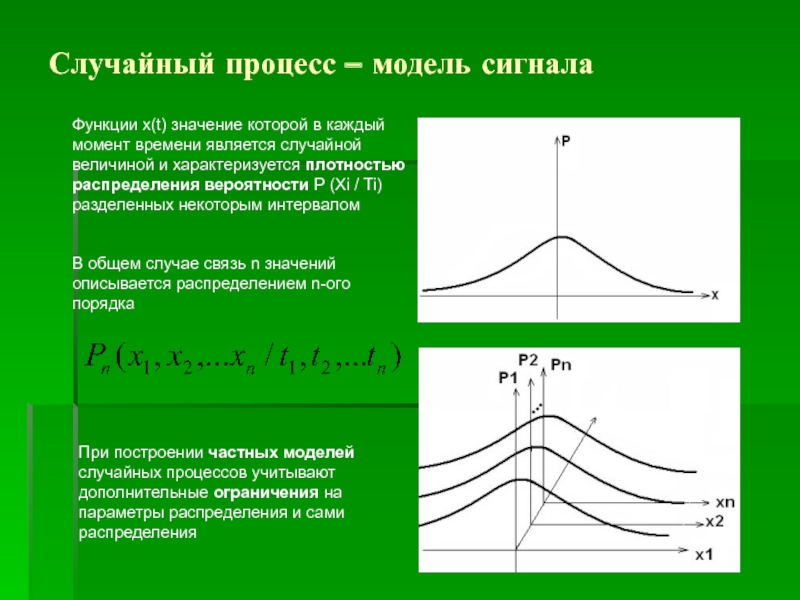

Слайд 6Случайный процесс – модель сигнала

При построении

частных моделей случайных процессов учитывают дополнительные ограничения на параметры распределения

и сами распределения Функции x(t) значение которой в каждый момент времени является случайной величиной и характеризуется плотностью распределения вероятности P (Xi / Ti) разделенных некоторым интервалом

В общем случае связь n значений описывается распределением n-ого порядка

Слайд 8Модели реализаций непрерывных сигналов

Гармонические (синусоидальные) сигналы

Где Sc

– множество всех гармонических сигналов, R+ - множество положительных действительных

чисел, ω – круговая частота, φ- фаза Модулированные сигналы переносят полезную информацию каким-нибудь одним параметром гармонического колебания (несущего колебания). Процесс изменения параметра называется модуляцией, а выделение этого изменения в чистом виде - демодуляцией. Пусть параметры с индексом 0 являются

постоянными, тогда :

Sам={x: x(t)=S(t)cos(ω0t+φ0) - амплитудная модуляция;

Sчм={x: x(t)=So cos(ω0t+φ0) - частотная модуляция;

Sфм={x: x(t)= Sо cos(ω0t+φ(t)) - фазовая модуляция;

При этом, физический смысл модуляции сохраняется, если модулирующий сигнал является «медленно меняющимся» по сравнению с несущим колебанием.

Периодические сигналы: Сигналы с ограниченной энергией: Сигналы ограниченной длительности. Сигналы с ограниченной полосой частот. Фурье-реобразование Хa временной реализации хф сигнала называется ее спектром:

Sτ={x: x(t)=x(t+τ); -∞

где временной интервал τ -период.

о сигналах из множества

Говорят, что их энергия ограничена величиной К. Происхождение этого названия связано с тем, что если x(t) - напряжение, то интеграл в формуле представляет собой энергию, выделенную сигналом x(t) на единичном сопротивлении

Интервал Т называется длительностью сигнала x(t), если:

при этом предполагается, что внутри интервала Т значение x(t) не всегда обращается ноль.

Физический смысл спектра состоит в том, что колебание хa представляется в виде суммы (в общем случае в форме интеграла) составляющих его гармонических колебаний с определенными амплитудами I хa I, частотами f и фазами. Между x(t) и Хa существует взаимно однозначное соответствие, т.к.

Слайд 9Принцип частотно-временной неопределённости

Т.к. некоторая функция x(t)

и ее спектр Х(f) однозначно выражаются друг через друга, то

сигнал можно рассматривать в любом из этих эквивалентных представлений - временном или частотном в реальности все сигналы конечны по длительности, а все чувствительные к сигналам устройства не могут воспринимать и воспроизводить абсолютно все частоты

Энергетический критерий точности: сигнал считается имеющим конечную длительность ΔТ, если в этом интервале времени сосредоточена основная часть всей энергии функции х(t), в то же время ширина спектра ΔF сигнала определяется как область частот, содержащая эту же часть всей энергии спектра х (f)

но

сигналы с ограниченной длительностью имеют спектры неограниченной ширины, а сигналы с ограниченной полосой частот длятся бесконечно долго

Слайд 10«Площадь» сигнала на плоскости «частота-время»

Изменяя форму сигнала можно

изменять и занимаемую им площадь, причем уменьшать ее можно только

до определенного предела, который достигается на кривой являющейся гармоническим колебанием, которое модулировано по амплитуде гауссовым импульсом. При этом спектр этой кривой имеет такую же форму: Существование предела, ниже которого нельзя сжать площадь сигнала, занимаемую им на плоскости «частота-время», называется принципом частотно-временной неопределенности сигналов (по

аналогии с принципом неопределённости в квантовой механике)

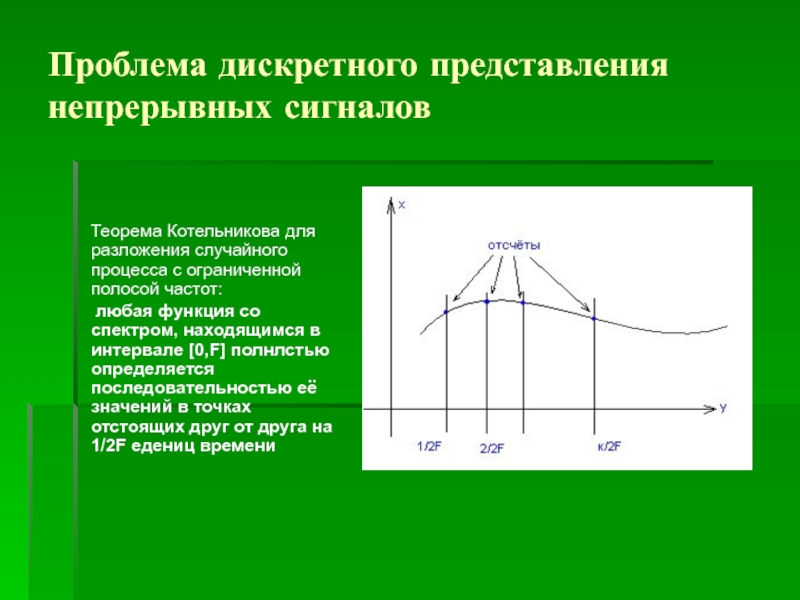

Слайд 11Проблема дискретного представления непрерывных сигналов

Теорема Котельникова для

разложения случайного процесса с ограниченной полосой частот:

любая функция со спектром, находящимся в интервале [0,F] полнлстью определяется последовательностью её значений в точках отстоящих друг от друга на 1/2F едениц времениСлайд 12Введение в теорию информации

Научная дисциплина, которая специально

рассматривает сигнальную специфику случайных процессов – теория информации

некоторые типы непрерывных сигналов допускают дискретное представление случайные процессы могут быть использованы в качестве адекватных моделей сигналов

Задачи исследования сигналов можно свести к рассмотрению случайных величин

Слайд 13Понятие «энтропии»

Для характеристики размытости распределений широко

используется дисперсия или доверительный интервал

Случайное

происходит с не происходитсобытие №2 вероятностью 0,5 с вероятностью 0,5

Случайное происходит с не происходит

Событие №1 вероятностью 0,99 с вероятностью 0,5

Но эти величины имеют смысл только для случайных числовых величин и не могут применяться к случайным объектам, состояния которых различаются качественно

Мера неопределенности, связанная с распределением, должна быть такой количественной характеристикой, которая не связана с тем в какой шкале измеряются реализации случайного объекта

но

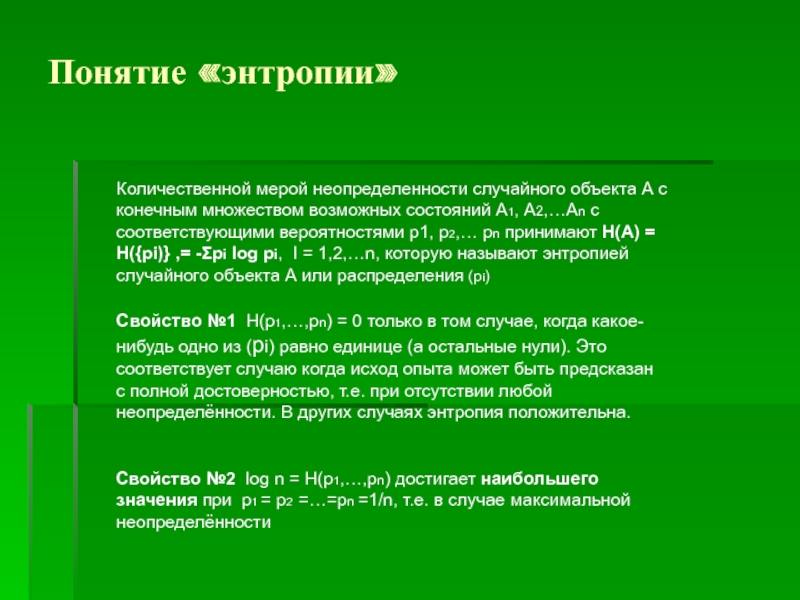

Слайд 14Понятие «энтропии»

Количественной мерой неопределенности случайного объекта

А с конечным множеством возможных состояний А1, А2,…Аn с соответствующими

вероятностями p1, p2,… pn принимают H(A) = H({pi)} ,= -Σpi log pi, I = 1,2,…n, которую называют энтропией случайного объекта А или распределения (pi) Свойство №2 log n = H(p1,…,pn) достигает наибольшего значения при p1 = p2 =…=pn =1/n, т.е. в случае максимальной неопределённости

Свойство №1 H(p1,…,pn) = 0 только в том случае, когда какое-нибудь одно из (pi) равно единице (а остальные нули). Это соответствует случаю когда исход опыта может быть предсказан с полной достоверностью, т.е. при отсутствии любой неопределённости. В других случаях энтропия положительна.

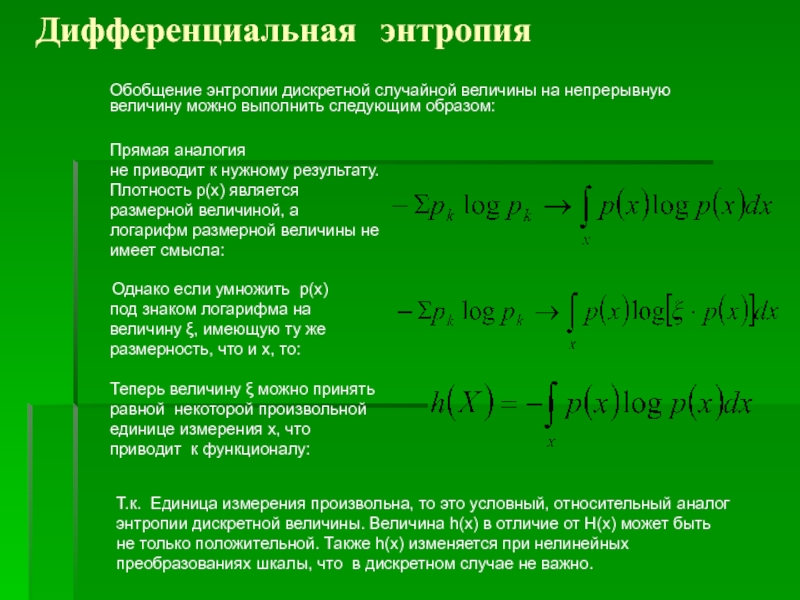

Слайд 15Дифференциальная энтропия

Теперь величину ξ можно принять

равной некоторой произвольной единице измерения х, что приводит к функционалу:

Однако если умножить p(x) под знаком логарифма на величину ξ, имеющую ту же размерность, что и х, то: Прямая аналогия не приводит к нужному результату. Плотность p(x) является размерной величиной, а логарифм размерной величины не имеет смысла:

Обобщение энтропии дискретной случайной величины на непрерывную величину можно выполнить следующим образом:

Т.к. Единица измерения произвольна, то это условный, относительный аналог энтропии дискретной величины. Величина h(x) в отличие от H(x) может быть не только положительной. Также h(x) изменяется при нелинейных преобразованиях шкалы, что в дискретном случае не важно.

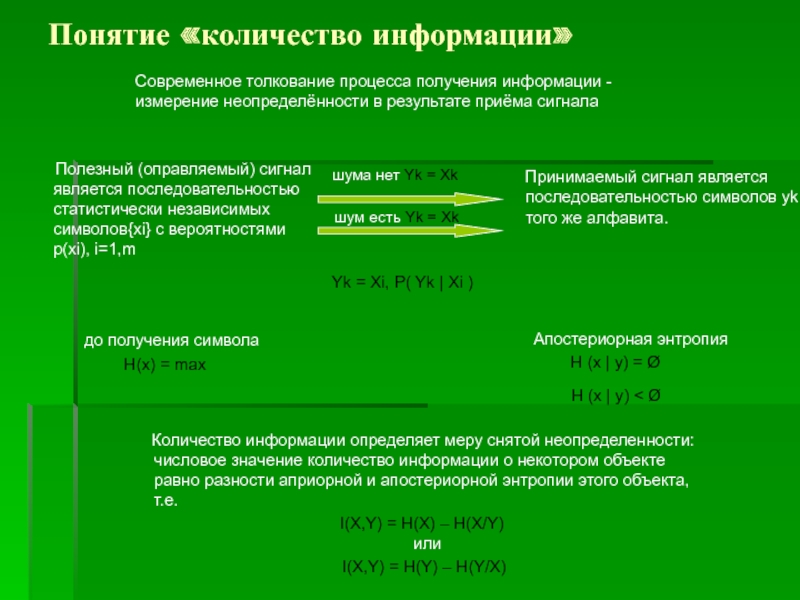

Слайд 16Понятие «количество информации»

Современное толкование процесса получения

информации - измерение неопределённости в результате приёма сигнала

Принимаемый сигнал является последовательностью символов yk того же алфавита. Полезный (оправляемый) сигнал является последовательностью статистически независимых символов{xi} с вероятностями p(xi), i=1,m

Yk = Xi, P( Yk | Xi )

до получения символа

H(x) = max

шума нет Yk = Xk

шум есть Yk = Xk

Апостериорная энтропия

H (x | y) = Ø

H (x | y) < Ø

Количество информации определяет меру снятой неопределенности: числовое значение количество информации о некотором объекте равно разности априорной и апостериорной энтропии этого объекта, т.е.

I(X,Y) = H(X) – H(X/Y) или

I(X,Y) = H(Y) – H(Y/X)

Слайд 17Свойство симметрии количества информации

Отражаемый и отражающий

объекты выступают совершенно равноправно

НО

Одно явление всегда

выступает как причина, другой – как следствие ,что никак не учитывается при введенном количественном описании информации Отражение одного объекта другим есть результат взаимодействия, т.е. взаимного, обоюдного изменения состояний

Количество информации в объекте Х об объекте Y равно количеству информации в объекте Y об объекте Х.

Таким образом количество информации, является не характеристикой одного из объектов, а характеристикой их связи.

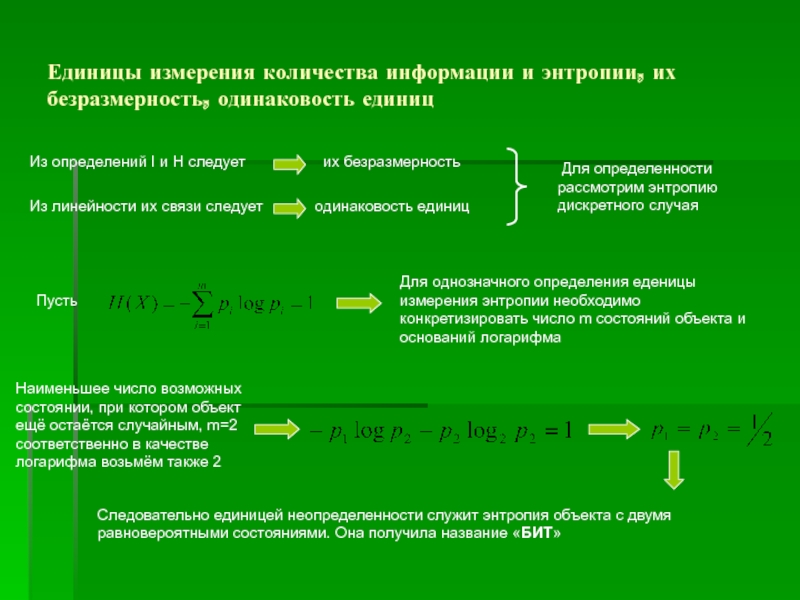

Слайд 18Единицы измерения количества информации и энтропии, их безразмерность, одинаковость единиц

Из

линейности их связи следует одинаковость

единицПусть

Из определений I и H следует их безразмерность

Для определенности рассмотрим энтропию дискретного случая

Следовательно единицей неопределенности служит энтропия объекта с двумя равновероятными состояниями. Она получила название «БИТ»

Для однозначного определения еденицы измерения энтропии необходимо конкретизировать число m состояний объекта и оснований логарифма

Наименьшее число возможных состоянии, при котором объект ещё остаётся случайным, m=2 соответственно в качестве логарифма возьмём также 2

Слайд 19Избыточность

Для описания этого свойства сигналов введено

понятие избыточности и определена её количественная мера

Количество информации которое несёт сигнал, обычно меньше, чем то, которое он мог бы нести по своей физической природе Если это представление информации обладает избыточностью, то такое же количество информации i может быть представлено меньшим количеством символов n0 без потерь

Пусть сигнал длиной в n символов содержит количество информации i

В качестве меры избыточности R принимается относительное удлинение сигнала, соответствующее данной избыточности:

Основные характеристики сигнала

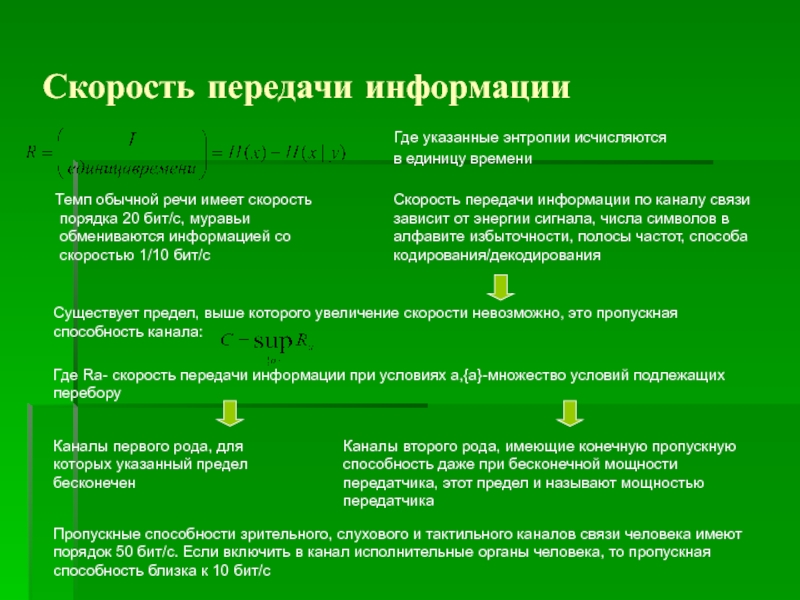

Слайд 20Скорость передачи информации

Существует предел, выше которого

увеличение скорости невозможно, это пропускная способность канала:

Где Ra- скорость передачи информации при условиях а,{a}-множество условий подлежащих перебору Скорость передачи информации по каналу связи зависит от энергии сигнала, числа символов в алфавите избыточности, полосы частот, способа кодирования/декодирования

Каналы первого рода, для которых указанный предел бесконечен

Темп обычной речи имеет скорость порядка 20 бит/с, муравьи обмениваются информацией со скоростью 1/10 бит/с

Где указанные энтропии исчисляются

в единицу времени

Каналы второго рода, имеющие конечную пропускную способность даже при бесконечной мощности передатчика, этот предел и называют мощностью передатчика

Пропускные способности зрительного, слухового и тактильного каналов связи человека имеют порядок 50 бит/с. Если включить в канал исполнительные органы человека, то пропускная способность близка к 10 бит/с

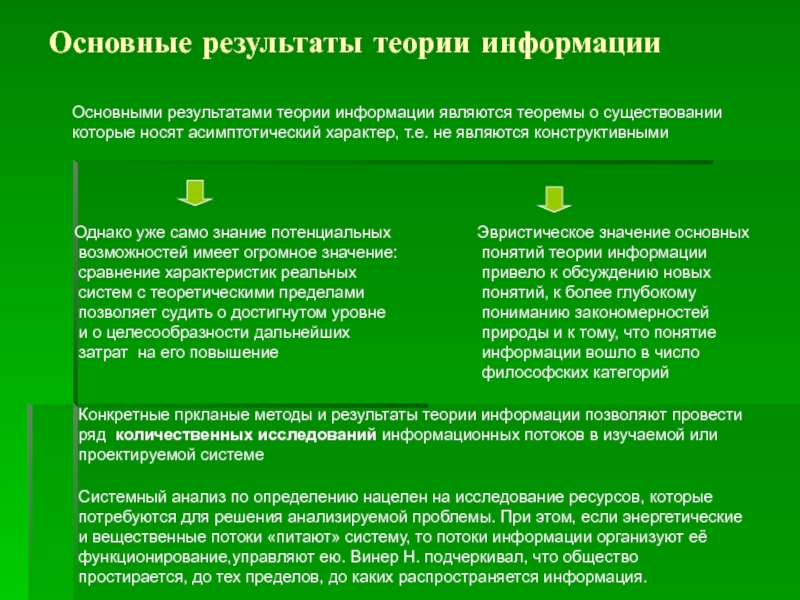

Слайд 21Основные результаты теории информации

Основными результатами теории

информации являются теоремы о существовании которые носят асимптотический характер, т.е.

не являются конструктивными Конкретные пркланые методы и результаты теории информации позволяют провести ряд количественных исследований информационных потоков в изучаемой или проектируемой системе

Эвристическое значение основных понятий теории информации привело к обсуждению новых понятий, к более глубокому пониманию закономерностей природы и к тому, что понятие информации вошло в число философских категорий

Однако уже само знание потенциальных возможностей имеет огромное значение: сравнение характеристик реальных систем с теоретическими пределами позволяет судить о достигнутом уровне и о целесообразности дальнейших затрат на его повышение

Системный анализ по определению нацелен на исследование ресурсов, которые потребуются для решения анализируемой проблемы. При этом, если энергетические и вещественные потоки «питают» систему, то потоки информации организуют её функционирование,управляют ею. Винер Н. подчеркивал, что общество простирается, до тех пределов, до каких распространяется информация.