Разделы презентаций

- Разное

- Английский язык

- Астрономия

- Алгебра

- Биология

- География

- Геометрия

- Детские презентации

- Информатика

- История

- Литература

- Математика

- Медицина

- Менеджмент

- Музыка

- МХК

- Немецкий язык

- ОБЖ

- Обществознание

- Окружающий мир

- Педагогика

- Русский язык

- Технология

- Физика

- Философия

- Химия

- Шаблоны, картинки для презентаций

- Экология

- Экономика

- Юриспруденция

Тестирование автокорреляции

Содержание

- 1. Тестирование автокорреляции

- 2. Цели лекцииПрирода проблемы автокорреляции остатковПоследствия автокорреляцииСредства обнаружения автокорреляцииСредства для решения проблемы автокорреляции.

- 3. Понятие автокорреляцииМодель называется автокоррелированной, если не выполняется

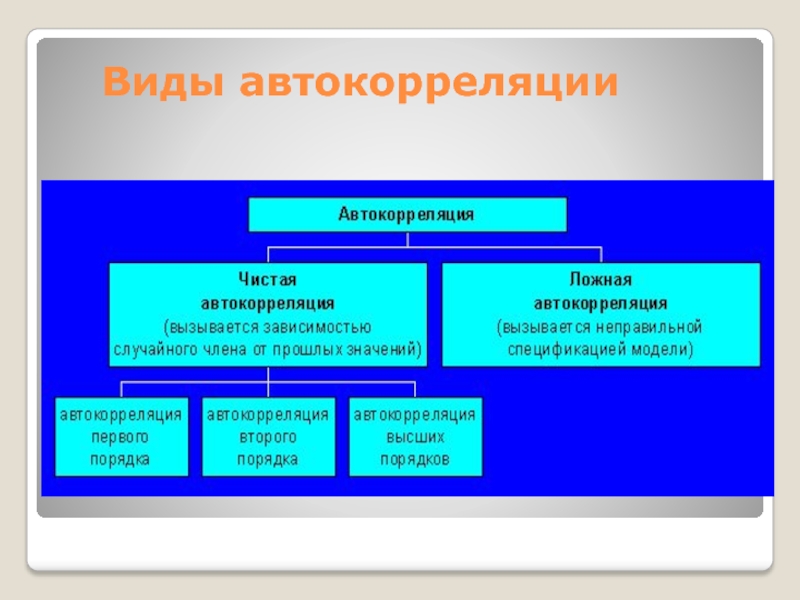

- 4. Виды автокорреляции

- 5. Причины чистой автокорреляции1. Инерция факторов Трансформация, изменение многих

- 6. Автокорреляция первого порядка случайный член рассматриваемого

- 7. Сезонная автокорреляция случайный член рассматриваемого уравнения

- 8. Автокорреляция второго порядка случайный член рассматриваемого

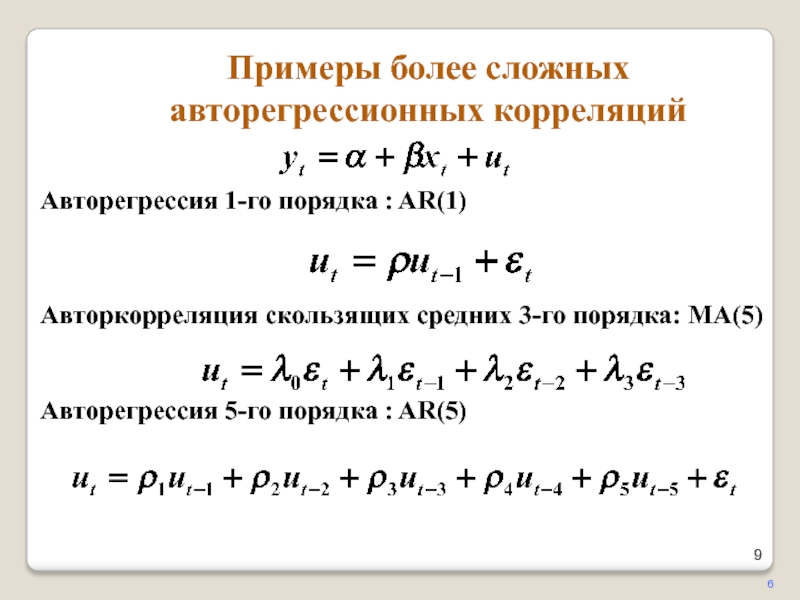

- 9. Авторегрессия 1-го порядка : AR(1)Авторкорреляция скользящих средних

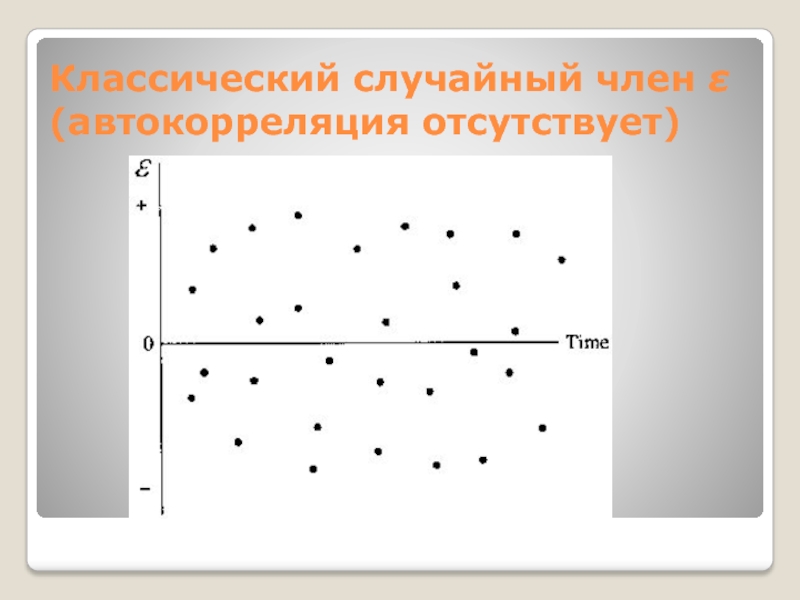

- 10. Классический случайный член (автокорреляция отсутствует)

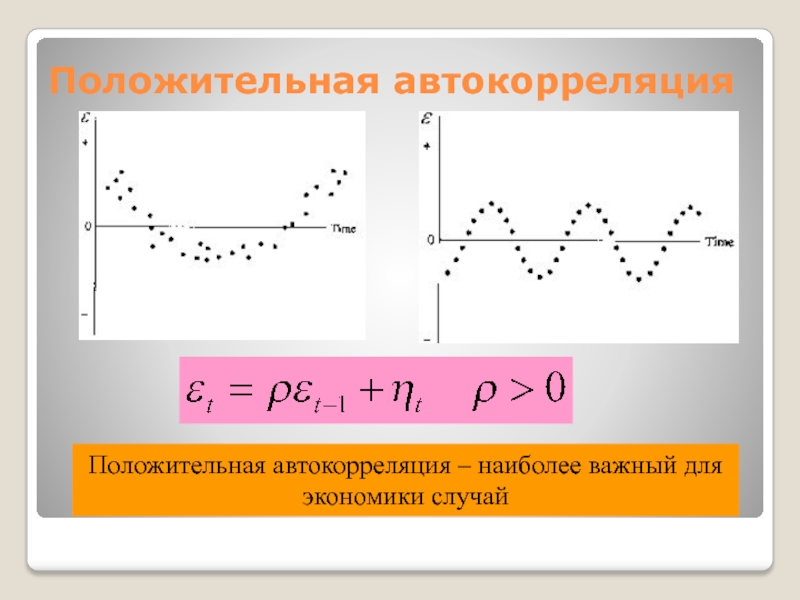

- 11. Положительная автокорреляцияПоложительная автокорреляция – наиболее важный для экономики случай

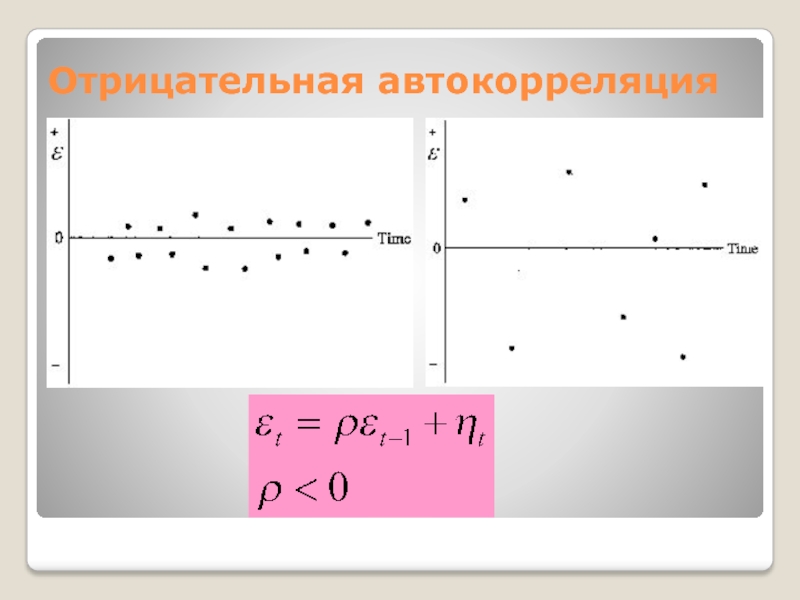

- 12. Отрицательная автокорреляция

- 13. ПОЛОЖИТЕЛЬНАЯ АВТОКОРРЕЛЯЦИЯТретье условие теоремы Гаусса-Маркова – независимость

- 14. ОТРИЦАТЕЛЬНАЯ АВТОКОРЕЛЛЯЦИЯ 3Пример отрицательной автокорреляции.За положительными чаще

- 15. Пример влияния автокорреляции на случайную выборкуРассмотрим пример

- 16. Пример влияния автокорреляции на случайную выборкуρ = 0, т.е. автокорреляция отсутствует. Процесс - нормальная случайная величина

- 17. Пример влияния автокорреляции на случайную выборку

- 18. Пример влияния автокорреляции на случайную выборку

- 19. Пример влияния автокорреляции на случайную выборкуначинает проявляться небольшая положительная автокорреляция

- 20. Пример влияния автокорреляции на случайную выборку

- 21. Пример влияния автокорреляции на случайную выборку

- 22. Пример влияния автокорреляции на случайную выборкуС ρ

- 23. Пример влияния автокорреляции на случайную выборку

- 24. Пример влияния автокорреляции на случайную выборку

- 25. Пример влияния автокорреляции на случайную выборкуС ρ

- 26. Пример влияния автокорреляции на случайную выборкуПри больших значениях ρ процесс становится нестационарным, приближаясь к случайному блужданию

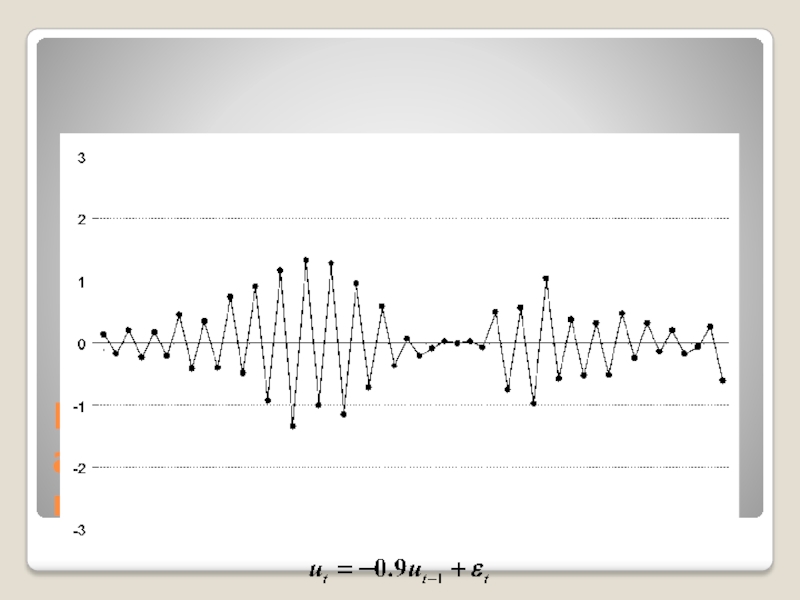

- 27. Пример влияния автокорреляции на случайную выборкуПримеры отрицательной автокорреляции для тех же значений et

- 28. Пример влияния автокорреляции на случайную выборку

- 29. Пример влияния автокорреляции на случайную выборкуС ρ

- 30. Пример влияния автокорреляции на случайную выборку

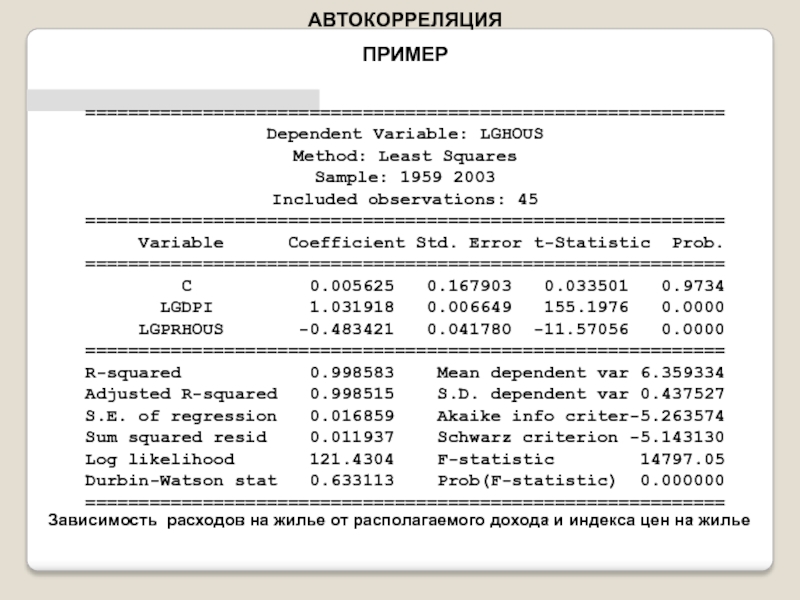

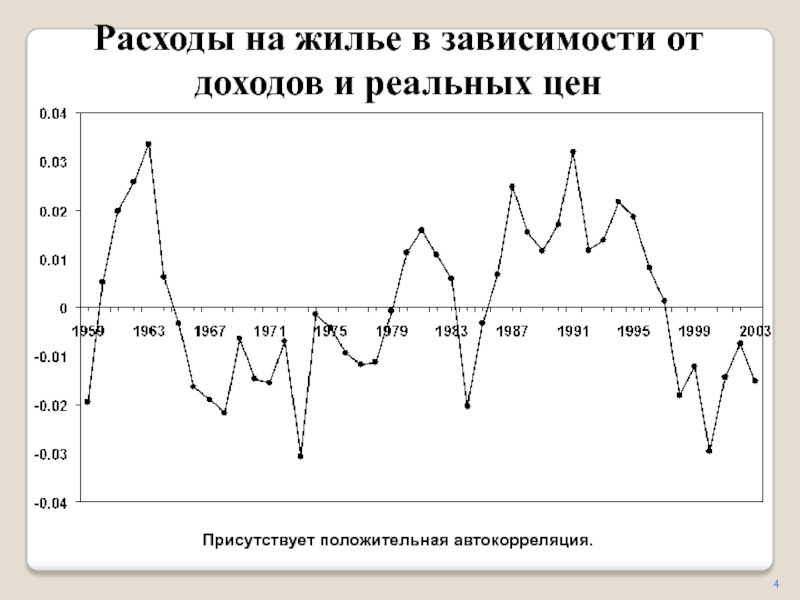

- 31. АВТОКОРЕЛЛЯЦИЯ На графике видно, что случайные

- 32. ============================================================Dependent Variable: LGHOUS

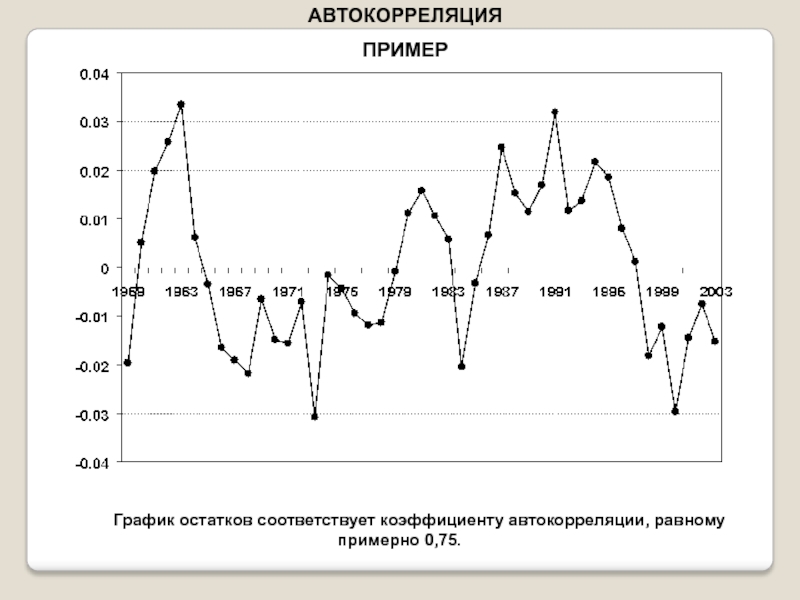

- 33. График остатков соответствует коэффициенту автокорреляции, равному примерно 0,75.АВТОКОРРЕЛЯЦИЯ ПРИМЕР

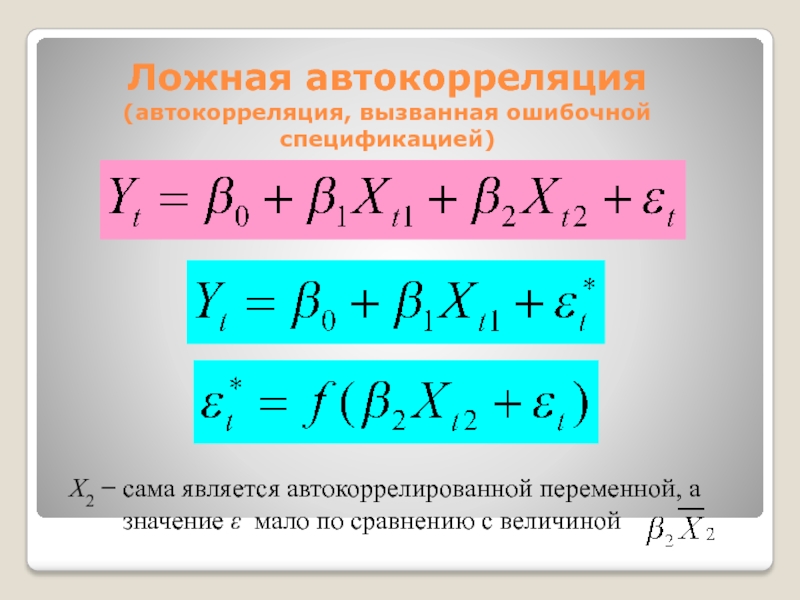

- 34. Ложная автокорреляция (автокорреляция, вызванная ошибочной спецификацией)X2

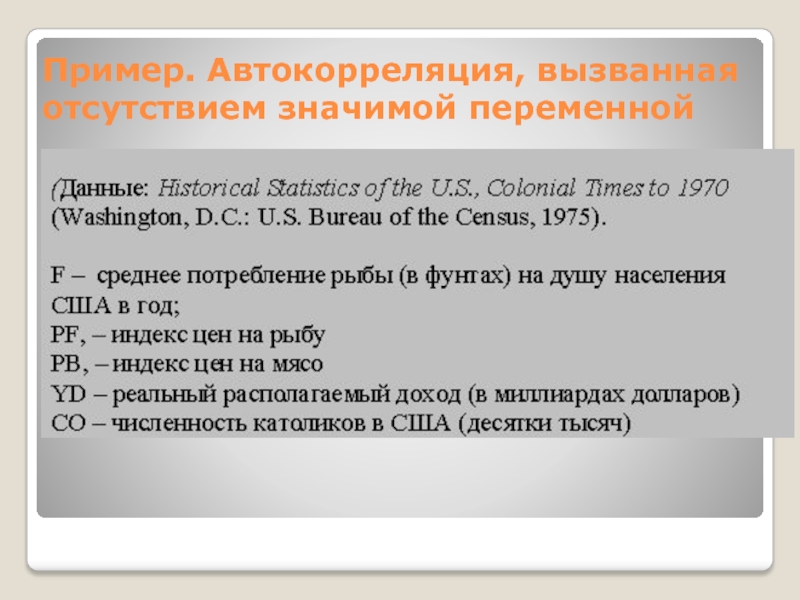

- 35. Пример. Автокорреляция, вызванная отсутствием значимой переменной

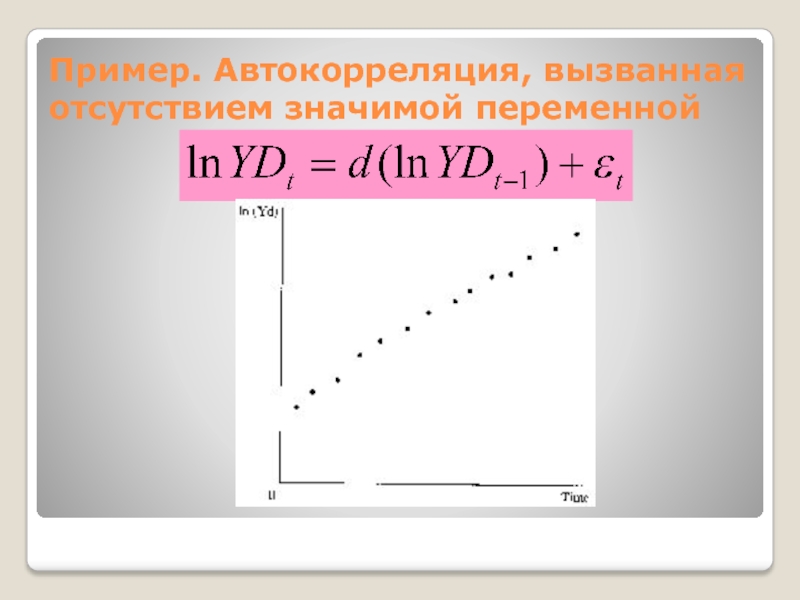

- 36. Пример. Автокорреляция, вызванная отсутствием значимой переменной

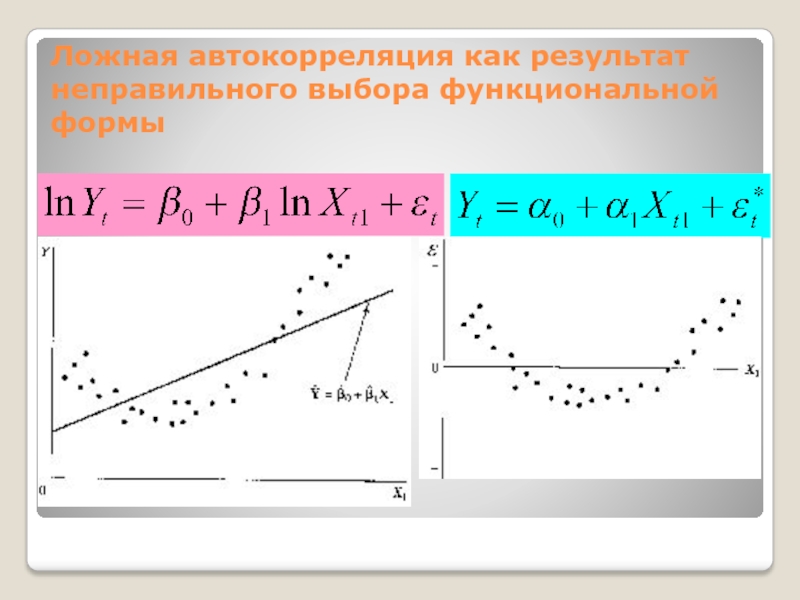

- 37. Ложная автокорреляция как результат неправильного выбора функциональной формы

- 38. Последствия автокорреляции1. Истинная автокорреляция не приводит к

- 39. Обнаружение автокорреляции1. Графический метод. 2. Метод рядов.3. Специальные тесты.

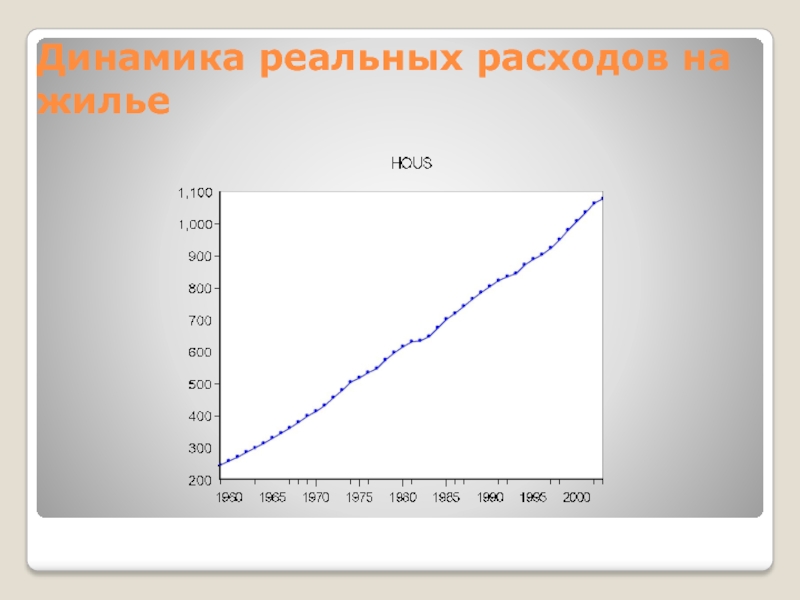

- 40. Динамика реальных расходов на жилье

- 41. 4Присутствует положительная автокорреляция.Расходы на жилье в зависимости от доходов и реальных цен

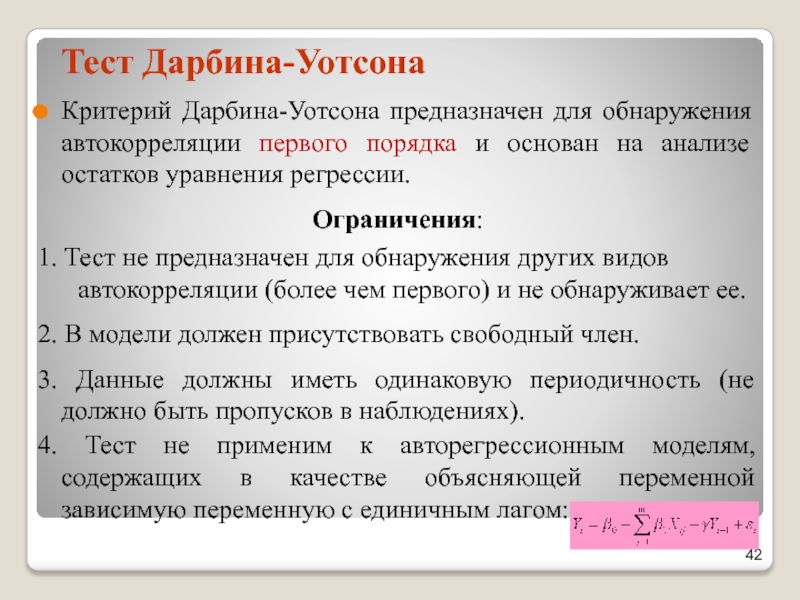

- 42. Тест Дарбина-УотсонаКритерий Дарбина-Уотсона предназначен для обнаружения автокорреляции

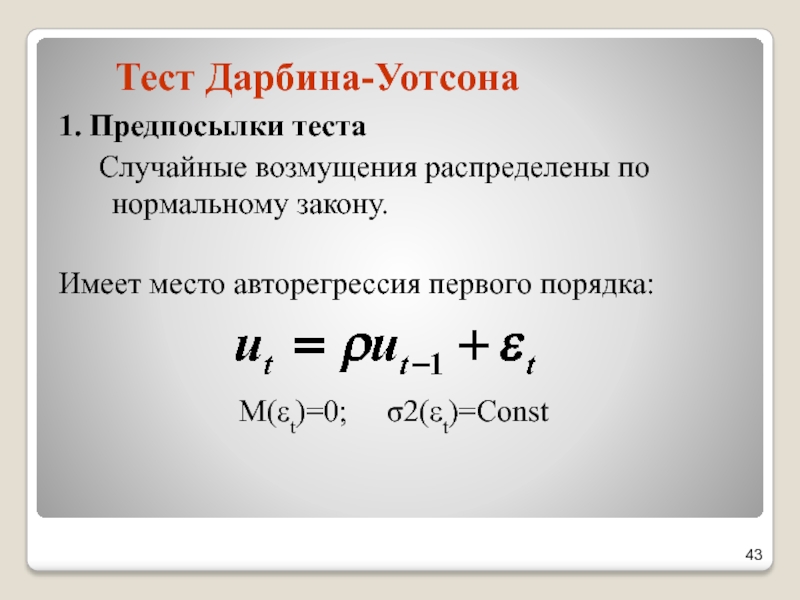

- 43. Тест Дарбина-Уотсона1. Предпосылки теста Случайные возмущения распределены по нормальному закону. Имеет место авторегрессия первого порядка:М(εt)=0; σ2(εt)=Const

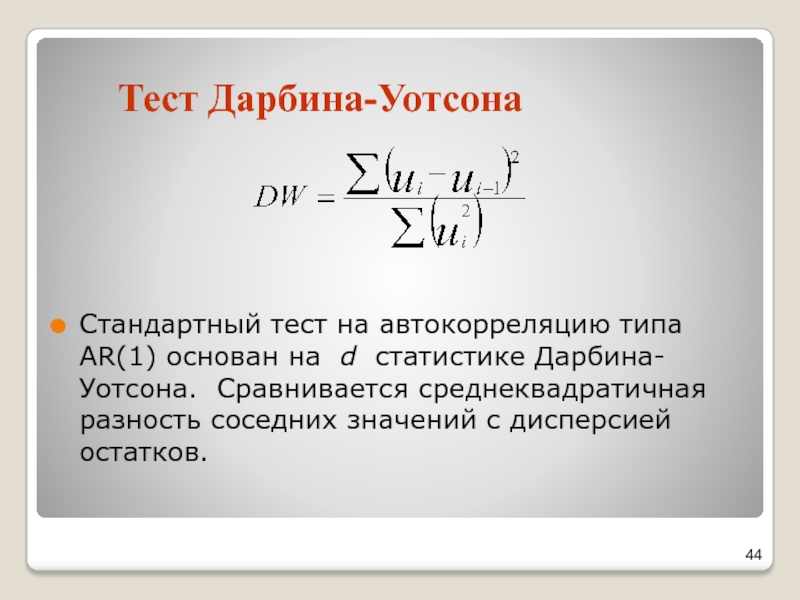

- 44. Тест Дарбина-УотсонаСтандартный тест на автокорреляцию типа AR(1)

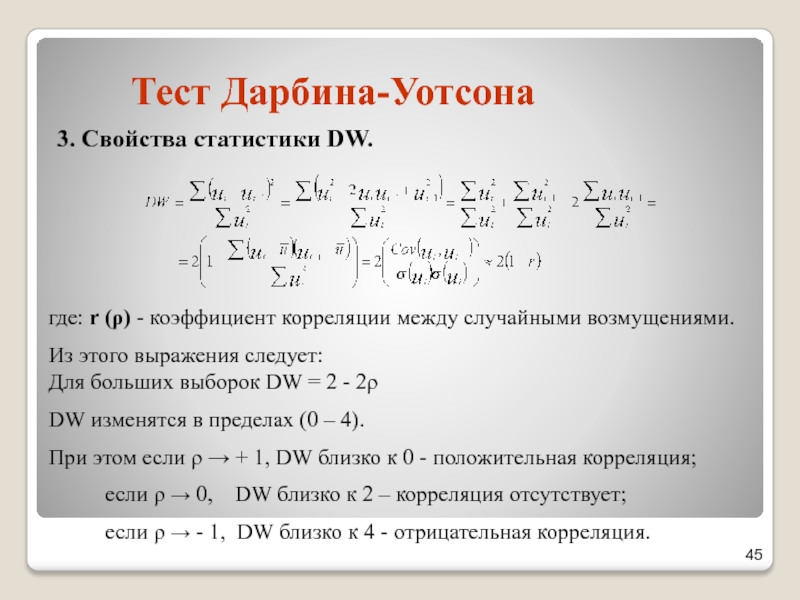

- 45. Тест Дарбина-Уотсона3. Свойства статистики DW.где: r (ρ)

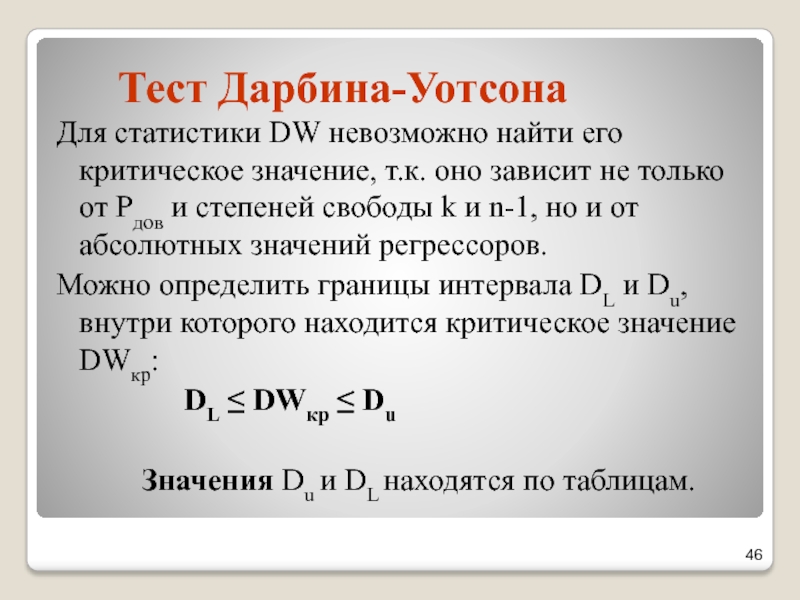

- 46. Тест Дарбина-УотсонаДля статистики DW невозможно найти его

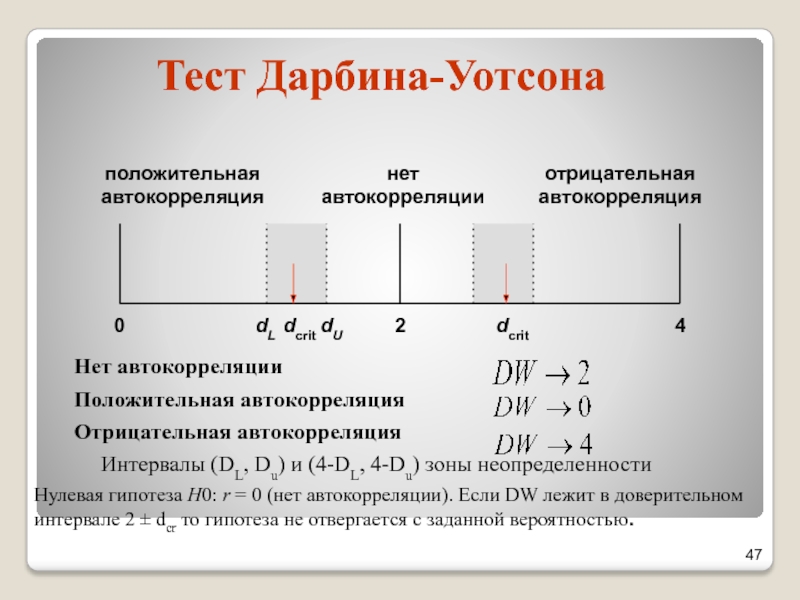

- 47. Тест Дарбина-Уотсона Нет автокорреляции Положительная автокорреляция Отрицательная автокорреляция

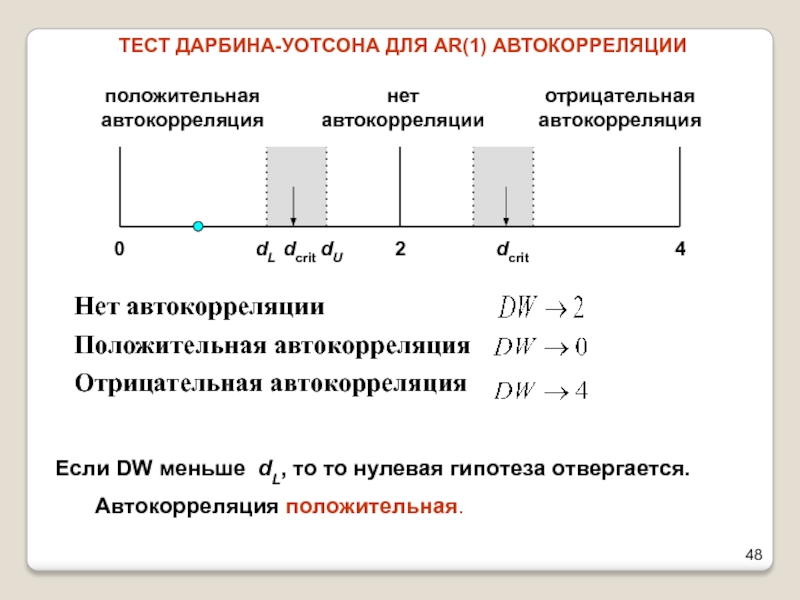

- 48. Нет автокорреляции Положительная автокорреляция Отрицательная автокорреляцияТЕСТ ДАРБИНА-УОТСОНА ДЛЯ AR(1)

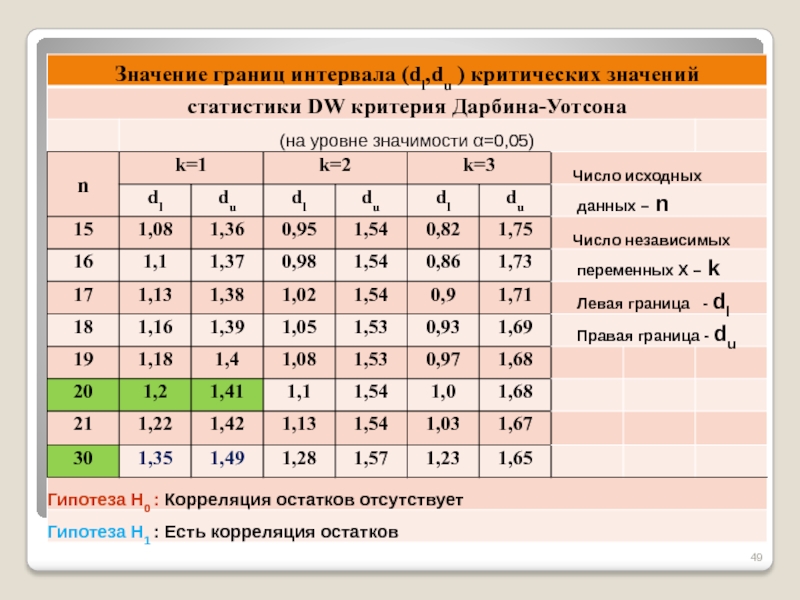

- 49. Слайд 49

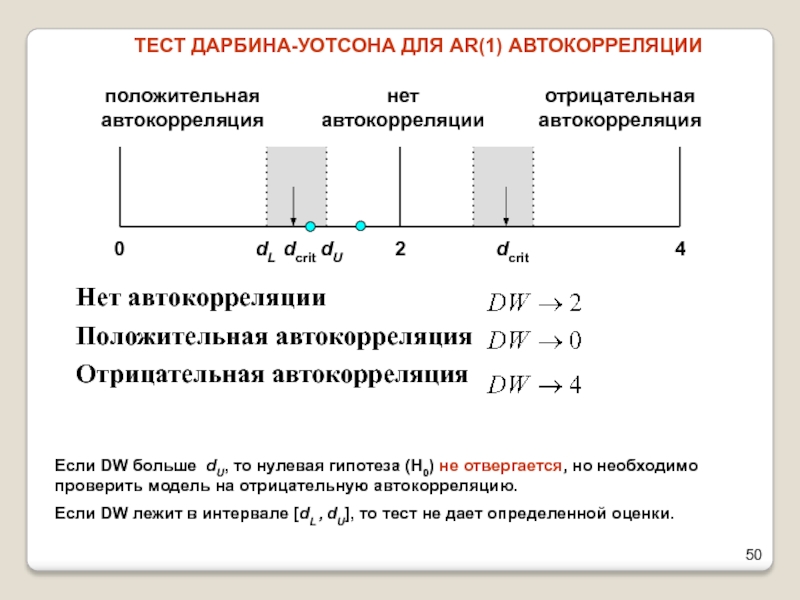

- 50. Нет автокорреляции Положительная автокорреляция Отрицательная автокорреляцияТЕСТ ДАРБИНА-УОТСОНА ДЛЯ AR(1)

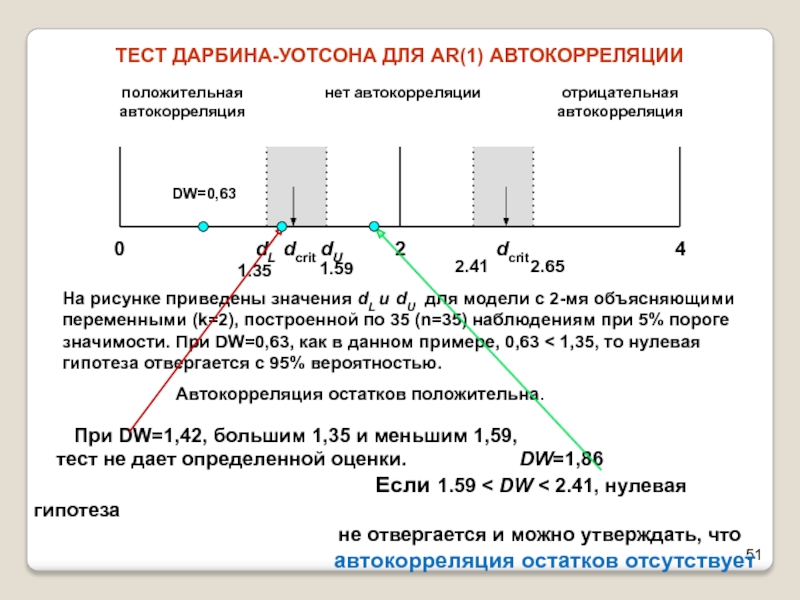

- 51. При DW=1,42, большим 1,35 и меньшим

- 52. Если

- 53. Тестирование автокорреляцииГосударственные расходы на образование в различных странах

- 54. Тестирование автокорреляцииМодель: Y= - 2.32 + 0.669X

- 55. Метод исправления автокорреляцииРассматривается случай авторегрессии первого порядка:

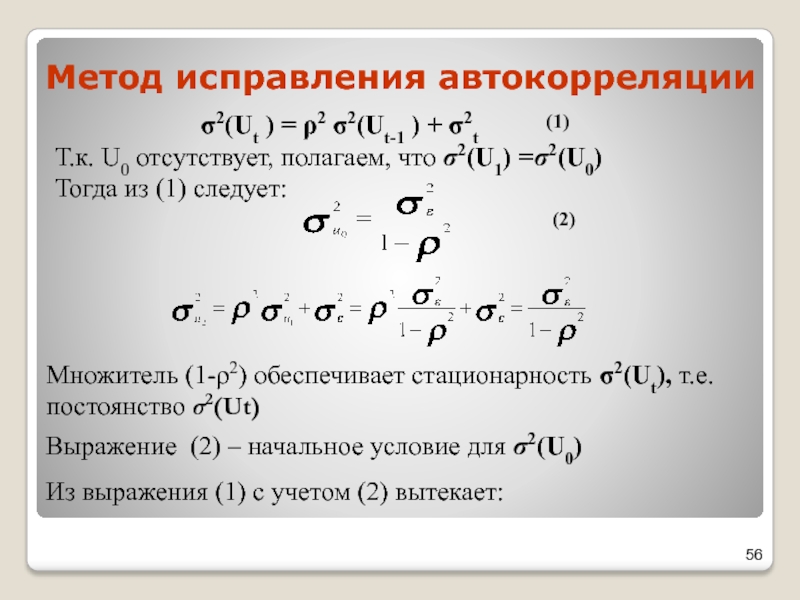

- 56. Метод исправления автокорреляцииМножитель (1-ρ2) обеспечивает стационарность σ2(Ut),

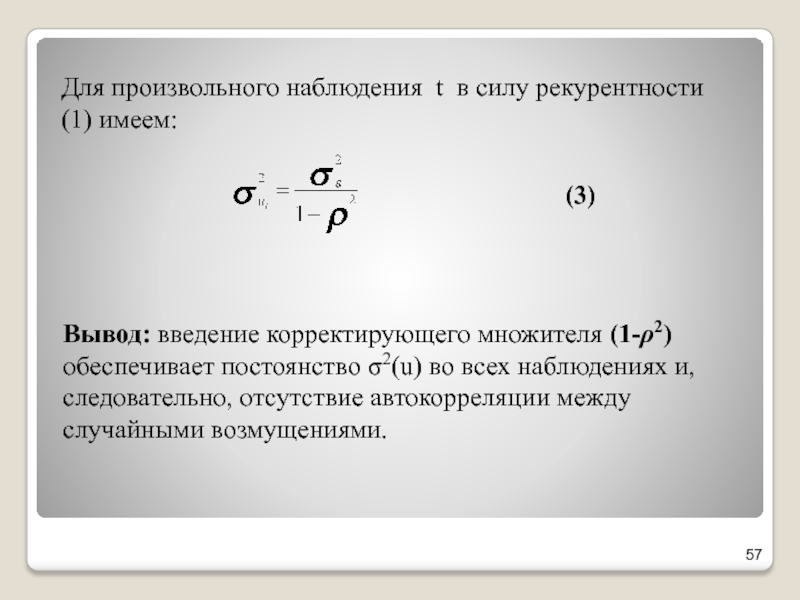

- 57. Для произвольного наблюдения t в силу рекурентности

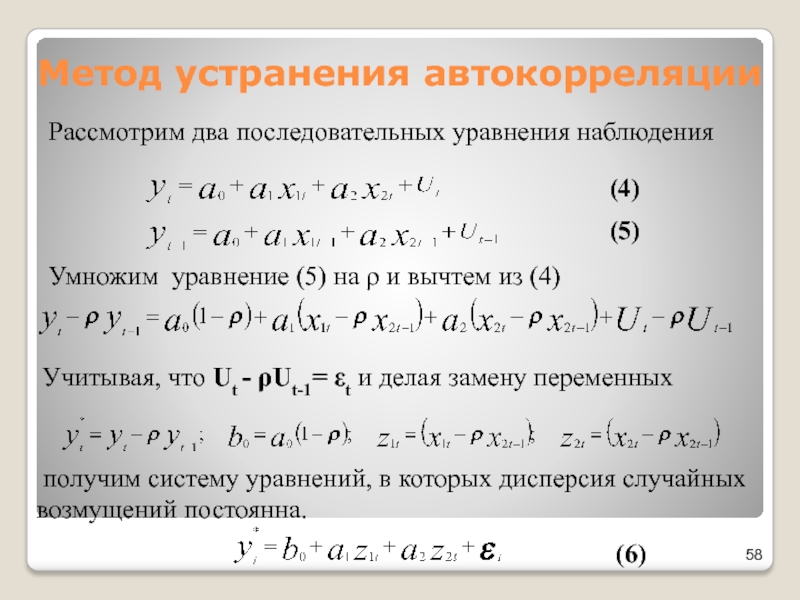

- 58. Метод устранения автокорреляцииРассмотрим два последовательных уравнения наблюдения(4)(5)Умножим

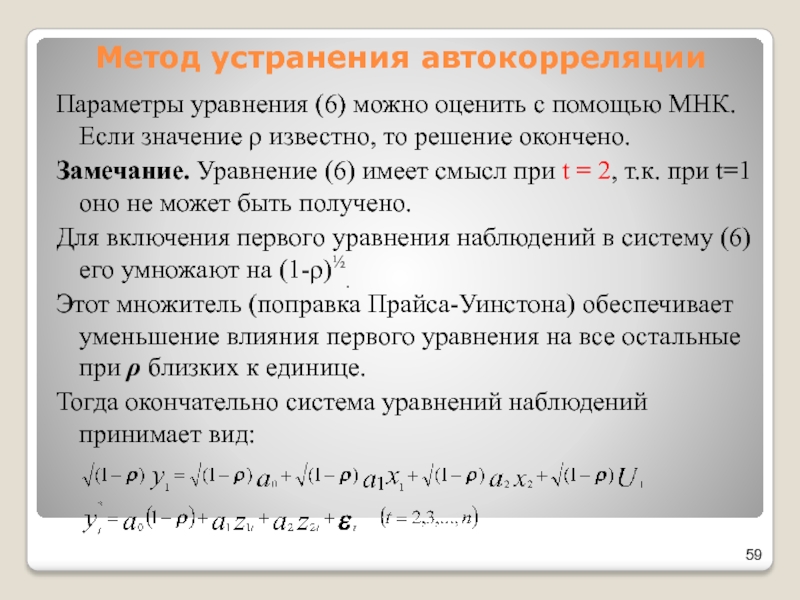

- 59. Метод устранения автокорреляцииПараметры уравнения (6) можно оценить

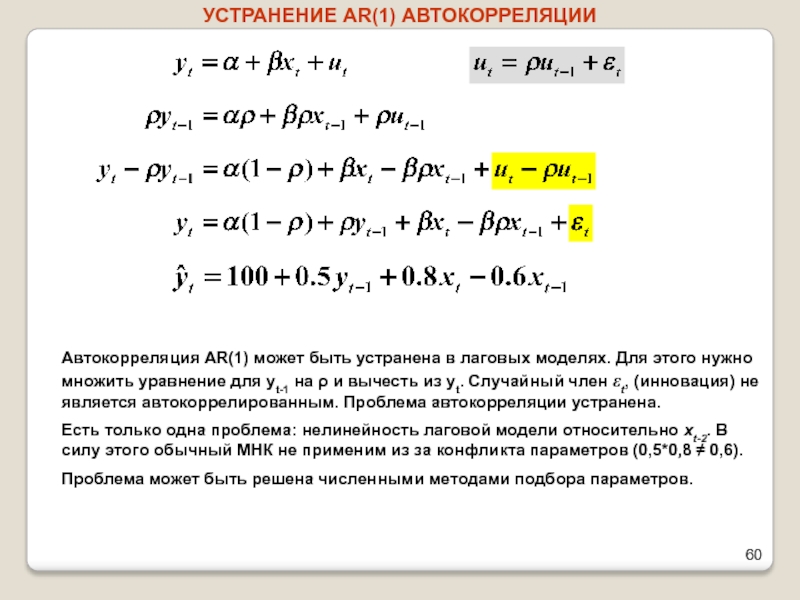

- 60. УСТРАНЕНИЕ AR(1) АВТОКОРРЕЛЯЦИИАвтокорреляция AR(1) может быть устранена

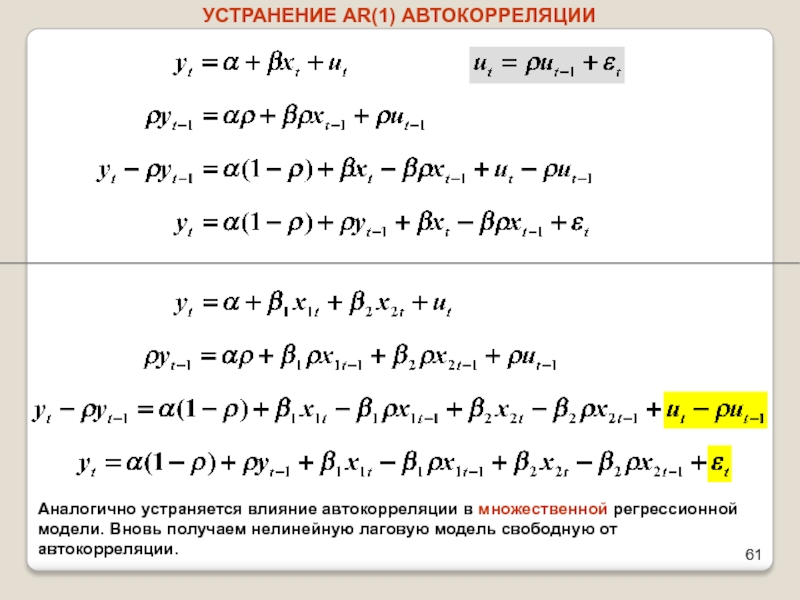

- 61. УСТРАНЕНИЕ AR(1) АВТОКОРРЕЛЯЦИИАналогично устраняется влияние автокорреляции в

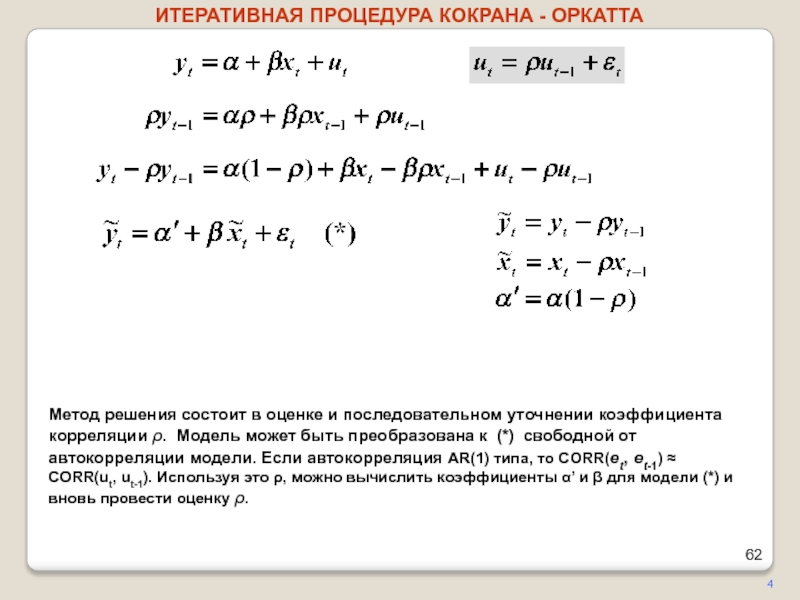

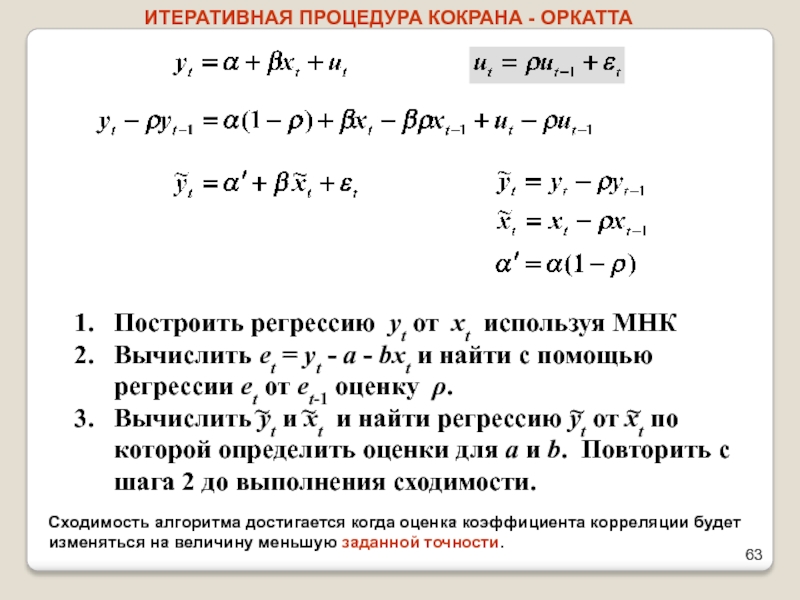

- 62. 4Метод решения состоит в оценке и последовательном

- 63. 1. Построить регрессию yt от xt используя МНК2. Вычислить

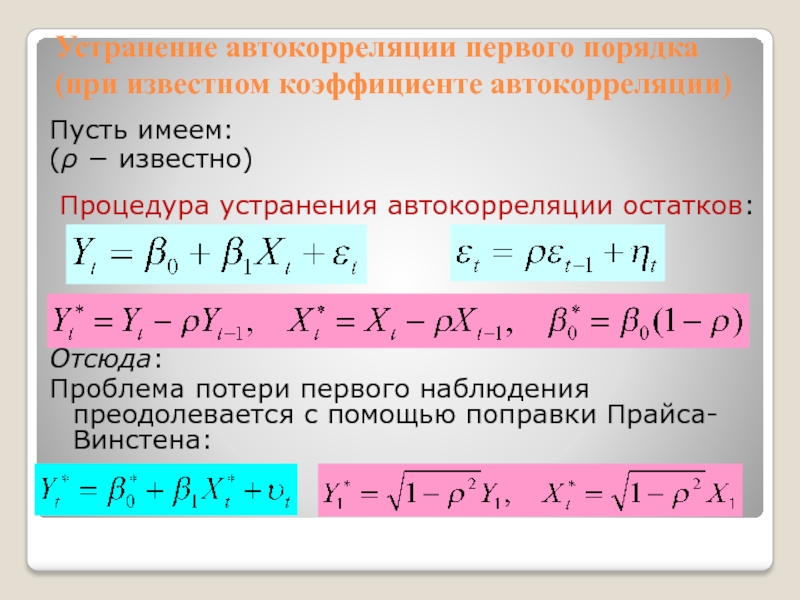

- 64. Устранение автокорреляции первого порядка (при известном коэффициенте

- 65. Устранение автокорреляции первого порядка. Обобщения Рассмотренное авторегрессионное преобразование

- 66. Способы оценивания коэффициента автокорреляции 1. На основе

- 67. Определение коэффициента на основе статистики Дарбина-УотсонаЭтот метод дает удовлетворительные результаты при большом числе наблюдений.

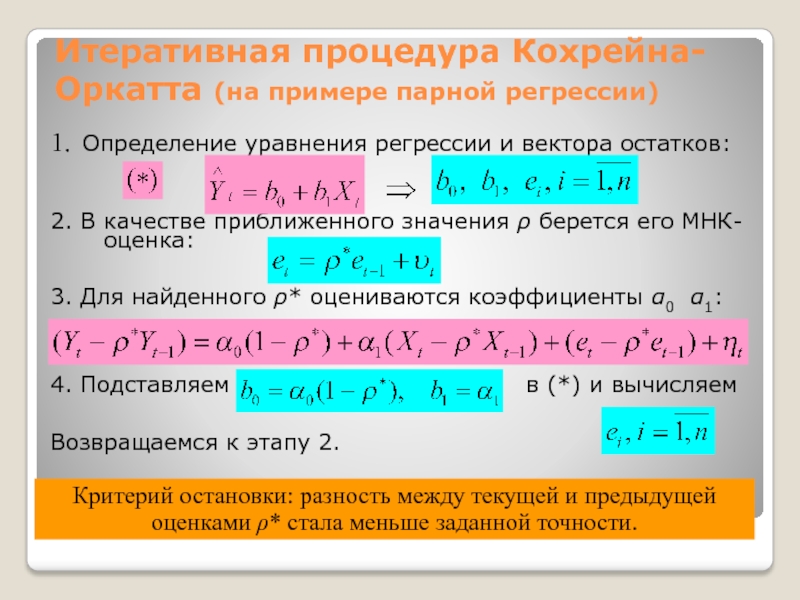

- 68. Итеративная процедура Кохрейна-Оркатта (на примере парной регрессии)1.

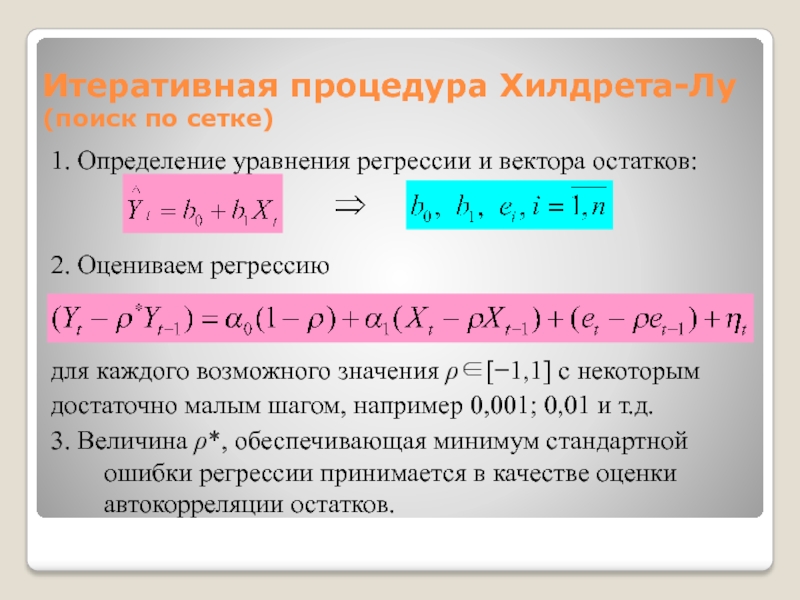

- 69. Итеративная процедура Хилдрета-Лу (поиск по сетке)1.

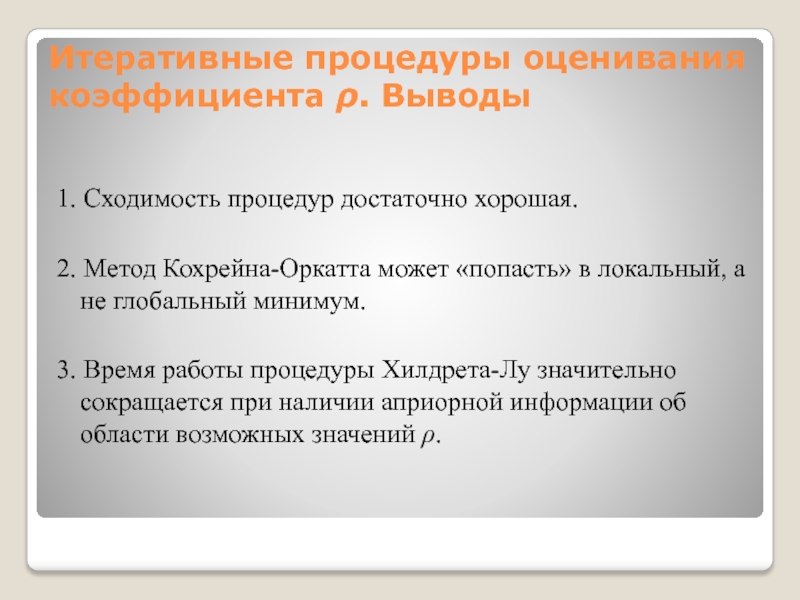

- 70. Итеративные процедуры оценивания коэффициента . Выводы1. Сходимость

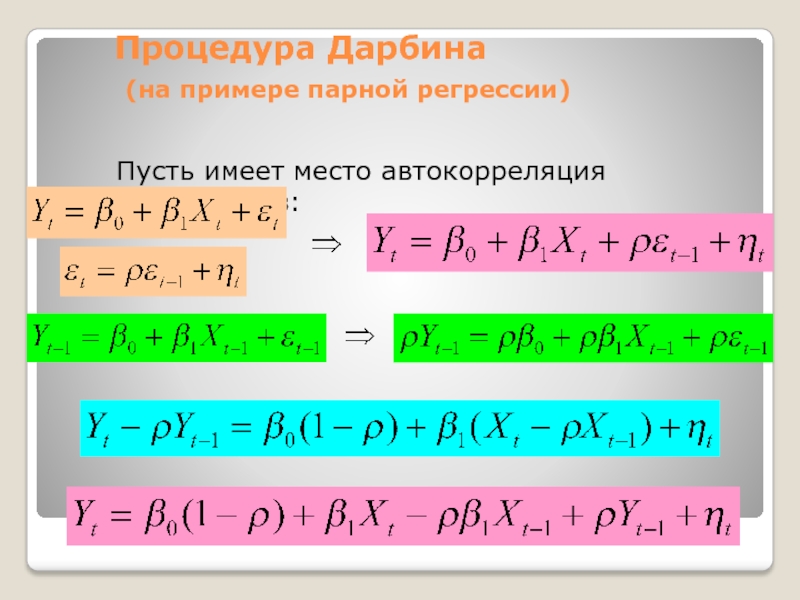

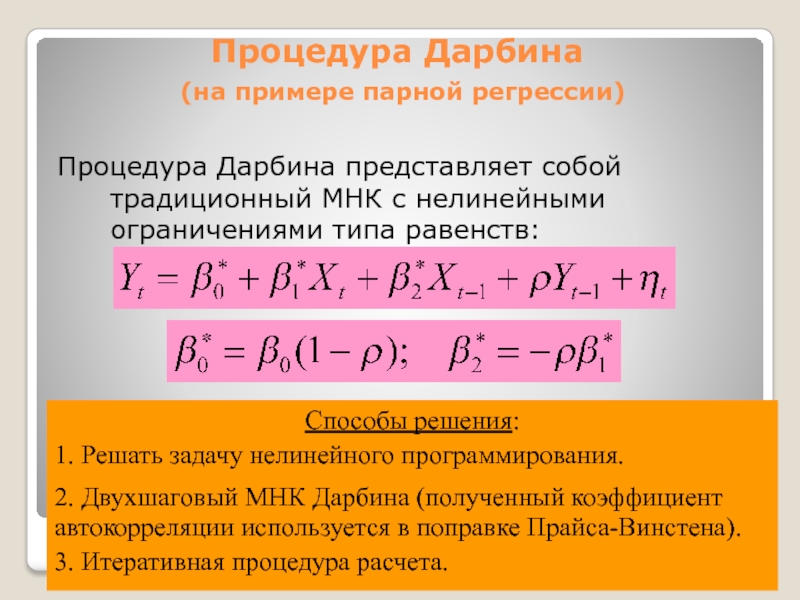

- 71. Процедура Дарбина (на примере парной регрессии)Пусть имеет место автокорреляция остатков:

- 72. Процедура Дарбина представляет собой традиционный МНК с

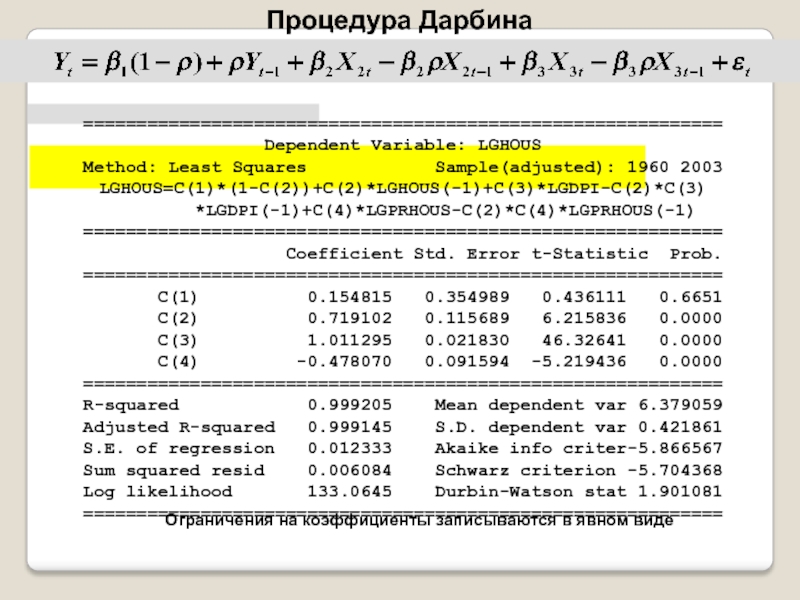

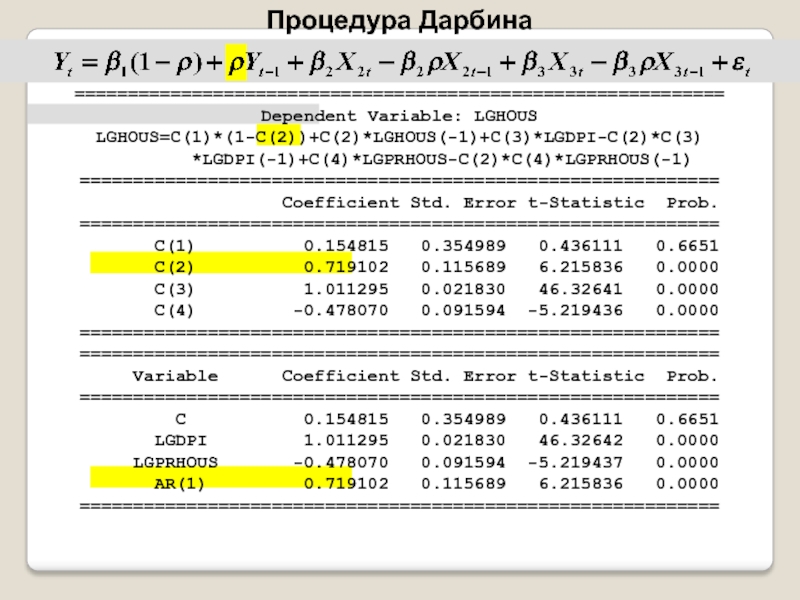

- 73. Процедура Дарбина Ограничения на коэффициенты записываются в явном

- 74. ============================================================Dependent Variable: LGHOUS

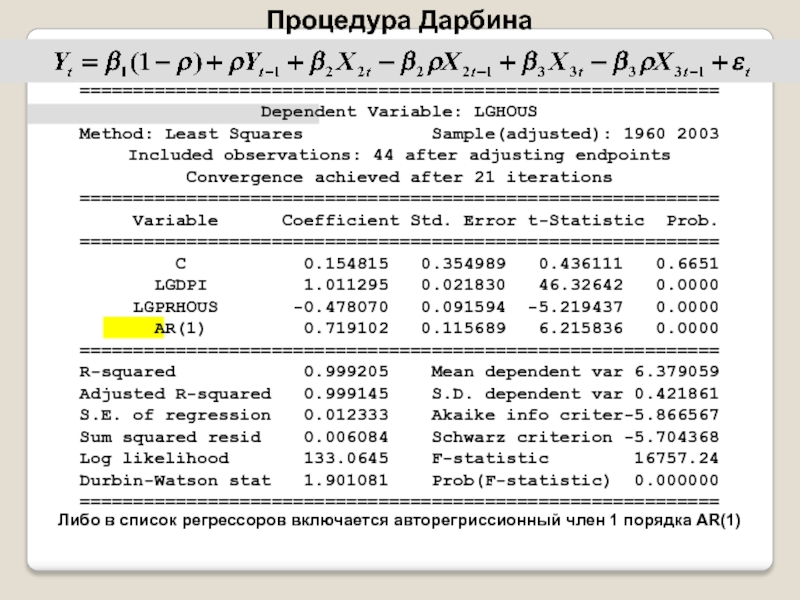

- 75. =============================================================Dependent Variable: LGHOUS

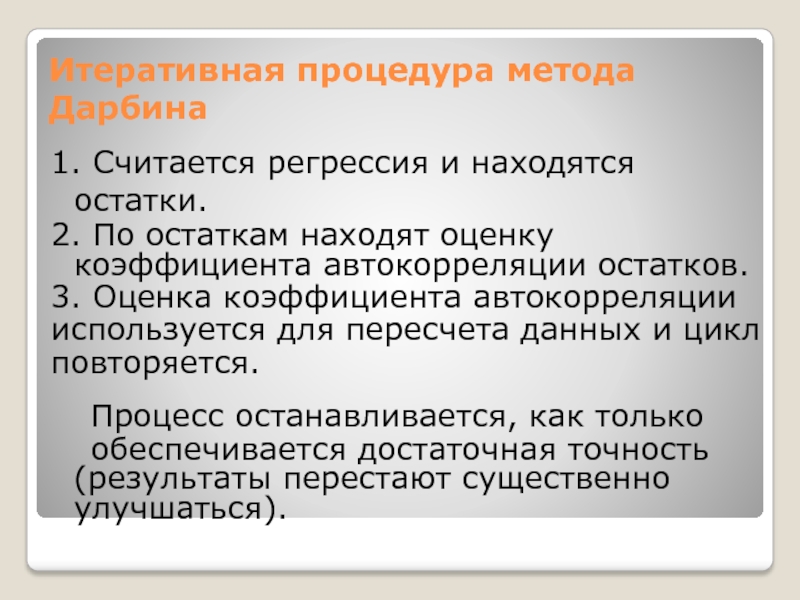

- 76. Итеративная процедура метода Дарбина1. Считается регрессия и

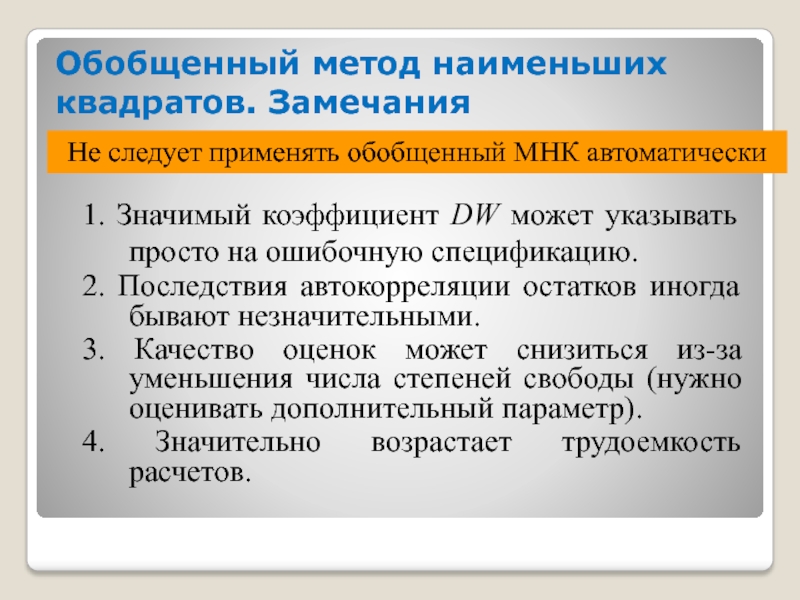

- 77. Обобщенный метод наименьших квадратов. Замечания1. Значимый коэффициент

- 78. Скачать презентанцию

Слайды и текст этой презентации

Слайд 2Цели лекции

Природа проблемы автокорреляции остатков

Последствия автокорреляции

Средства обнаружения автокорреляции

Средства для решения

проблемы автокорреляции.

Слайд 3Понятие автокорреляции

Модель называется автокоррелированной, если не выполняется третья предпосылка теоремы

Гаусса-Маркова:

Cov(ui,uj)≠0 при i≠j.

Автокорреляция (последовательная корреляция) – это корреляция между

наблюдаемыми показателями во времени (временные ряды) или в пространстве (перекрестные данные).Причина – неправильный выбор спецификации модели.

Последствия автокорреляции

- оценки коэффициентов теряют эффективность;

- стандартные ошибки коэффициентов занижены.

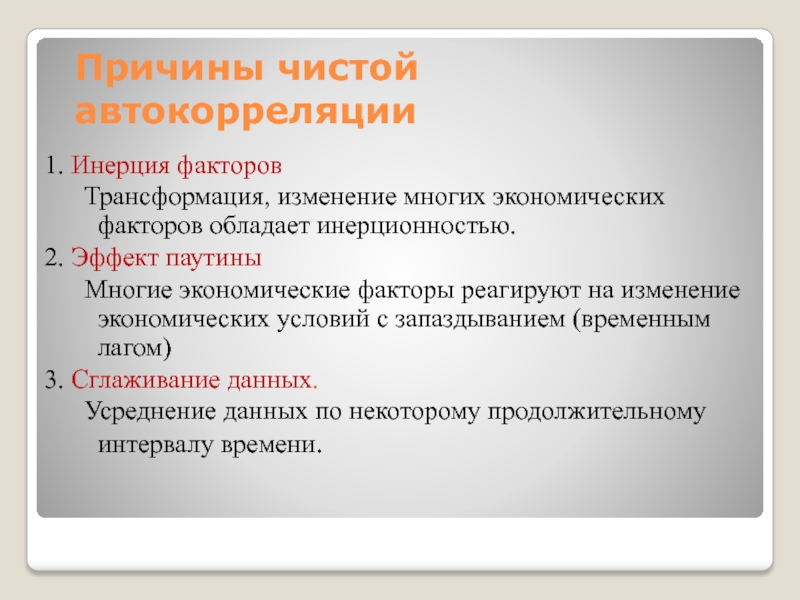

Слайд 5Причины чистой автокорреляции

1. Инерция факторов

Трансформация, изменение многих экономических факторов обладает

инерционностью.

2. Эффект паутины

Многие экономические факторы реагируют на изменение экономических условий

с запаздыванием (временным лагом)3. Сглаживание данных.

Усреднение данных по некоторому продолжительному интервалу времени.

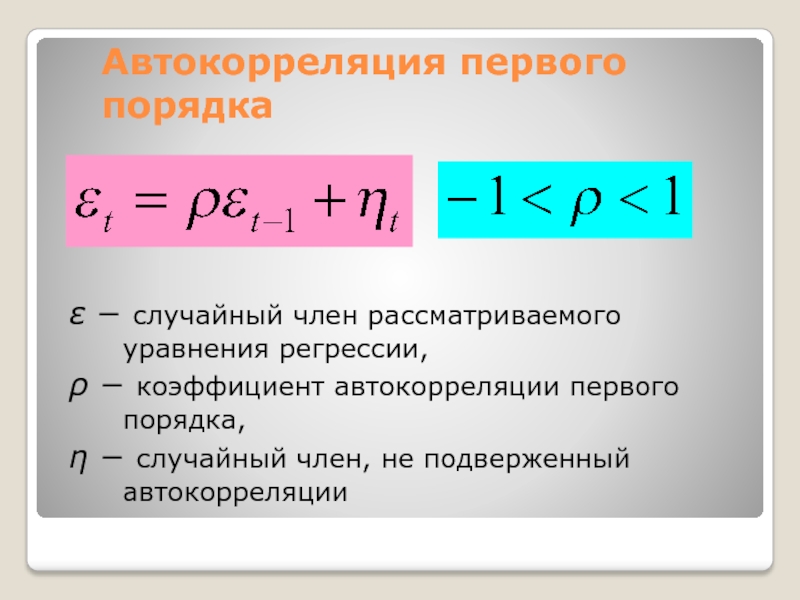

Слайд 6Автокорреляция первого порядка

случайный член рассматриваемого уравнения регрессии,

коэффициент автокорреляции первого порядка,

случайный член, не подверженный автокорреляции

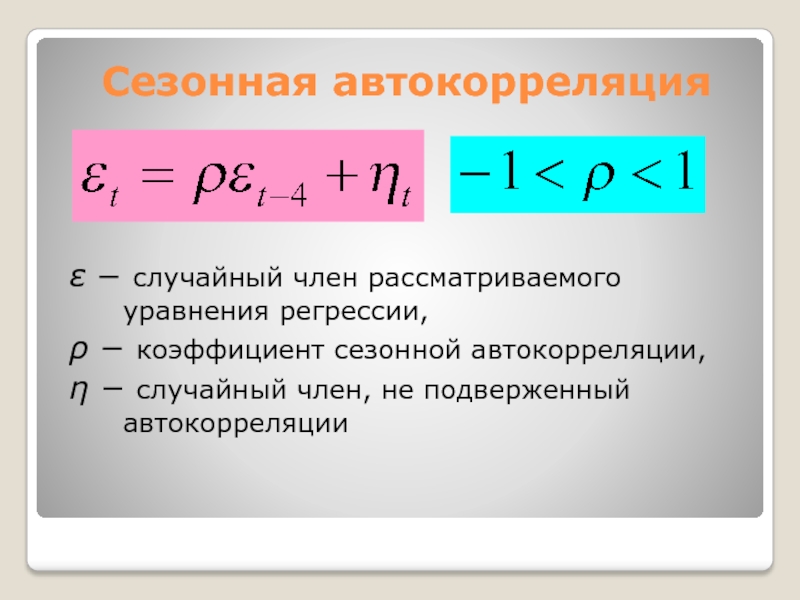

Слайд 7Сезонная автокорреляция

случайный член рассматриваемого уравнения регрессии,

коэффициент

сезонной автокорреляции,

случайный член, не подверженный автокорреляции

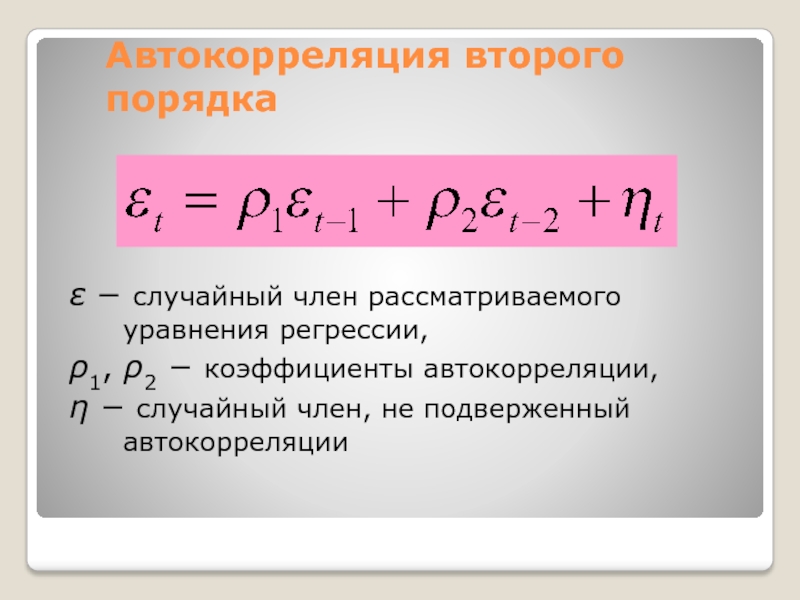

Слайд 8Автокорреляция второго порядка

случайный член рассматриваемого уравнения регрессии,

1, 2

коэффициенты автокорреляции,

случайный член, не подверженный автокорреляции

Слайд 9

Авторегрессия 1-го порядка : AR(1)

Авторкорреляция скользящих средних 3-го порядка: MA(5)

Авторегрессия

5-го порядка : AR(5)

6

Примеры более сложных авторегрессионных корреляций

Слайд 11Положительная автокорреляция

Положительная автокорреляция – наиболее важный для экономики случай

Слайд 13ПОЛОЖИТЕЛЬНАЯ АВТОКОРРЕЛЯЦИЯ

Третье условие теоремы Гаусса-Маркова – независимость случайных возмущений друг

от друга. На диаграмме видно, что это условие нарушено.

Если за

положительными отклонениями следуют положительные или за отрицательными – отрицательные - это положительная автокорреляция.y

x

y = a + bx

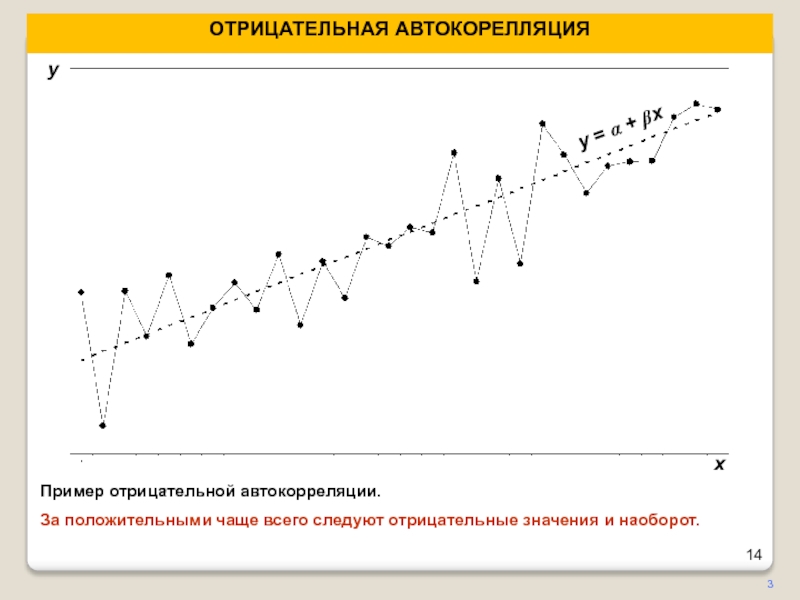

Слайд 14ОТРИЦАТЕЛЬНАЯ АВТОКОРЕЛЛЯЦИЯ

3

Пример отрицательной автокорреляции.

За положительными чаще всего следуют отрицательные

значения и наоборот.

y

y = a + bx

x

Слайд 15Пример влияния автокорреляции на случайную выборку

Рассмотрим пример с выборкой из

50 независимых нормально распределенных с нулевым средним значений i.

et –

распределена по стандартному нормальному закону с 0 средним и дисперсией 1, r (ρ) меняется.С целью ознакомления с влиянием автокорреляции будем вводить в нее положительную, а затем отрицательную автокорреляцию.

Слайд 16Пример влияния автокорреляции на случайную выборку

ρ = 0, т.е. автокорреляция

отсутствует. Процесс - нормальная случайная величина

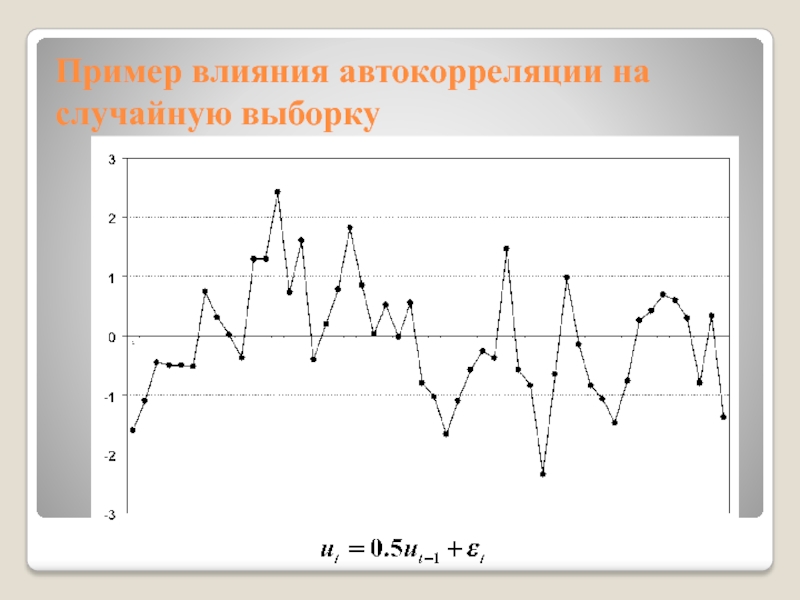

Слайд 19Пример влияния автокорреляции на случайную выборку

начинает проявляться небольшая положительная автокорреляция

Слайд 22Пример влияния автокорреляции на случайную выборку

С ρ = 0.6 u

подвержена положительной автокорреляции. Положительные значения чаще следуют за положительными, а

отрицательные за отрицательными.Слайд 25Пример влияния автокорреляции на случайную выборку

С ρ = 0.9 последовательность

значений с одним знаком становится длинной, а тенденция возврата к

0 слабоСлайд 26Пример влияния автокорреляции на случайную выборку

При больших значениях ρ процесс

становится нестационарным, приближаясь к случайному блужданию

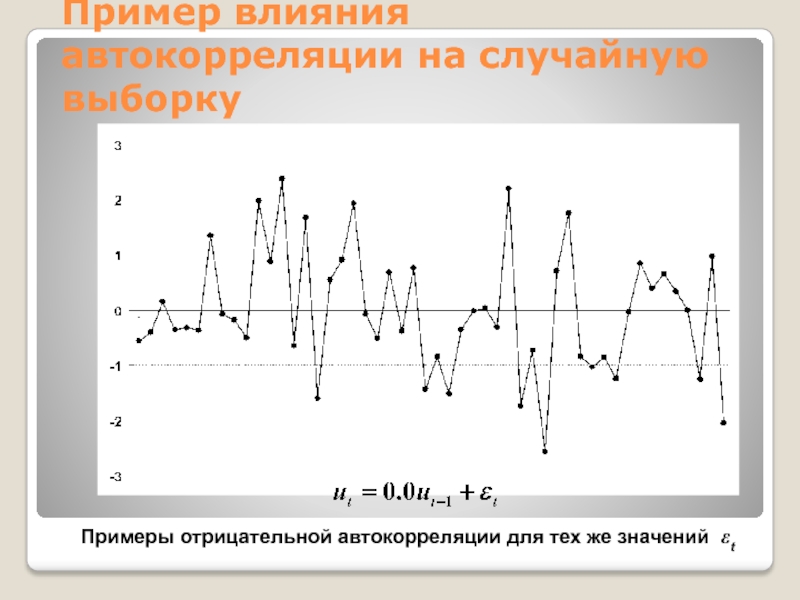

Слайд 27Пример влияния автокорреляции на случайную выборку

Примеры отрицательной автокорреляции для тех

же значений et

Слайд 29Пример влияния автокорреляции на случайную выборку

С ρ = 0.6 можно

видеть что положительные значения имеют тенденцию следовать за отрицательными и

наоборот. Отрицательная автокорреляция становится очевидноСлайд 31

АВТОКОРЕЛЛЯЦИЯ

На графике видно, что случайные возмущения подвержены положительной

автокорреляции. Сравнивая с примерами имитационного моделирования можно предполагать, что коэффициент

корреляции r не ниже 0.6.Слайд 32

============================================================

Dependent Variable: LGHOUS

Method: Least Squares

Sample: 1959 2003

Included observations: 45

============================================================

Variable Coefficient Std. Error t-Statistic Prob.

============================================================

C 0.005625 0.167903 0.033501 0.9734

LGDPI 1.031918 0.006649 155.1976 0.0000

LGPRHOUS -0.483421 0.041780 -11.57056 0.0000

============================================================

R-squared 0.998583 Mean dependent var 6.359334

Adjusted R-squared 0.998515 S.D. dependent var 0.437527

S.E. of regression 0.016859 Akaike info criter-5.263574

Sum squared resid 0.011937 Schwarz criterion -5.143130

Log likelihood 121.4304 F-statistic 14797.05

Durbin-Watson stat 0.633113 Prob(F-statistic) 0.000000

============================================================

АВТОКОРРЕЛЯЦИЯ

ПРИМЕР

Зависимость расходов на жилье от располагаемого дохода и индекса цен на жилье

Слайд 33

График остатков соответствует коэффициенту автокорреляции, равному примерно 0,75.

АВТОКОРРЕЛЯЦИЯ

ПРИМЕР

Слайд 34Ложная автокорреляция

(автокорреляция, вызванная ошибочной спецификацией)

X2 сама является автокоррелированной переменной,

а значение мало по сравнению с величиной

Слайд 38Последствия автокорреляции

1. Истинная автокорреляция не приводит к смещению оценок регрессии,

но оценки перестают быть эффективными.

2. Автокорреляция (особенно положительная) часто

приводит к уменьшению стандартных ошибок коэффициентов, что влечет за собой увеличение t-статистик.3. Оценка дисперсии остатков Se2 является смещенной оценкой истинного значения e2 , во многих случаях занижая его.

4. В силу вышесказанного выводы по оценке качества коэффициентов и модели в целом, возможно, будут неверными. Это приводит к ухудшению прогнозных качеств модели.

Слайд 414

Присутствует положительная автокорреляция.

Расходы на жилье в зависимости от доходов и

реальных цен

Слайд 42Тест Дарбина-Уотсона

Критерий Дарбина-Уотсона предназначен для обнаружения автокорреляции первого порядка и

основан на анализе остатков уравнения регрессии.

Ограничения:

1. Тест не предназначен для

обнаружения других видовавтокорреляции (более чем первого) и не обнаруживает ее.

2. В модели должен присутствовать свободный член.

3. Данные должны иметь одинаковую периодичность (не должно быть пропусков в наблюдениях).

4. Тест не применим к авторегрессионным моделям, содержащих в качестве объясняющей переменной зависимую переменную с единичным лагом:

Слайд 43Тест Дарбина-Уотсона

1. Предпосылки теста

Случайные возмущения распределены по нормальному закону.

Имеет место

авторегрессия первого порядка:

М(εt)=0; σ2(εt)=Const

Слайд 44Тест Дарбина-Уотсона

Стандартный тест на автокорреляцию типа AR(1) основан на d

статистике Дарбина-Уотсона. Сравнивается среднеквадратичная разность соседних значений с дисперсией остатков.

Слайд 45Тест Дарбина-Уотсона

3. Свойства статистики DW.

где: r (ρ) - коэффициент корреляции

между случайными возмущениями.

Из этого выражения следует:

Для больших выборок DW =

2 - 2ρDW изменятся в пределах (0 – 4).

При этом если ρ → + 1, DW близко к 0 - положительная корреляция;

если ρ → 0, DW близко к 2 – корреляция отсутствует;

если ρ → - 1, DW близко к 4 - отрицательная корреляция.

Слайд 46Тест Дарбина-Уотсона

Для статистики DW невозможно найти его критическое значение, т.к.

оно зависит не только от Рдов и степеней свободы k

и n-1, но и от абсолютных значений регрессоров.Можно определить границы интервала DL и Du, внутри которого находится критическое значение DWкр:

DL ≤ DWкр ≤ Du

Значения Du и DL находятся по таблицам.

Слайд 47Тест Дарбина-Уотсона

Нет автокорреляции

Положительная автокорреляция

Отрицательная автокорреляция

Интервалы (DL, Du) и (4-DL, 4-Du) зоны неопределенности

Нулевая гипотеза

H0: r = 0 (нет автокорреляции). Если DW лежит в доверительном интервале 2 ± dcr то гипотеза не отвергается с заданной вероятностью.10

2

4

0

dL

dU

dcrit

положительная автокорреляция

отрицательная автокорреляция

нет автокорреляции

dcrit

Слайд 48

Нет автокорреляции

Положительная автокорреляция

Отрицательная автокорреляция

ТЕСТ ДАРБИНА-УОТСОНА ДЛЯ AR(1) АВТОКОРРЕЛЯЦИИ

Если DW меньше

dL, то то нулевая гипотеза отвергается.

Автокорреляция положительная.

2

4

0

dL

dU

dcrit

положительная автокорреляция

отрицательная автокорреляция

нет автокорреляции

dcrit

Слайд 50

Нет автокорреляции

Положительная автокорреляция

Отрицательная автокорреляция

ТЕСТ ДАРБИНА-УОТСОНА ДЛЯ AR(1) АВТОКОРРЕЛЯЦИИ

Если DW больше

dU, то нулевая гипотеза (H0) не отвергается, но необходимо проверить

модель на отрицательную автокорреляцию.Если DW лежит в интервале [dL , dU], то тест не дает определенной оценки.

2

4

0

dL

dU

dcrit

положительная автокорреляция

отрицательная автокорреляция

нет автокорреляции

dcrit

Слайд 51

При DW=1,42, большим 1,35 и меньшим 1,59,

тест

не дает определенной оценки. DW=1,86

Если 1.59 < DW < 2.41, нулевая гипотезане отвергается и можно утверждать, что

автокорреляция остатков отсутствует

ТЕСТ ДАРБИНА-УОТСОНА ДЛЯ AR(1) АВТОКОРРЕЛЯЦИИ

На рисунке приведены значения dL и dU для модели с 2-мя объясняющими переменными (k=2), построенной по 35 (n=35) наблюдениям при 5% пороге значимости. При DW=0,63, как в данном примере, 0,63 < 1,35, то нулевая гипотеза отвергается с 95% вероятностью.

Автокорреляция остатков положительна.

2

4

0

dL

dU

dcrit

положительная автокорреляция

отрицательная автокорреляция

нет автокорреляции

dcrit

1.35

1.59

2.41

2.65

DW=0,63

Слайд 52

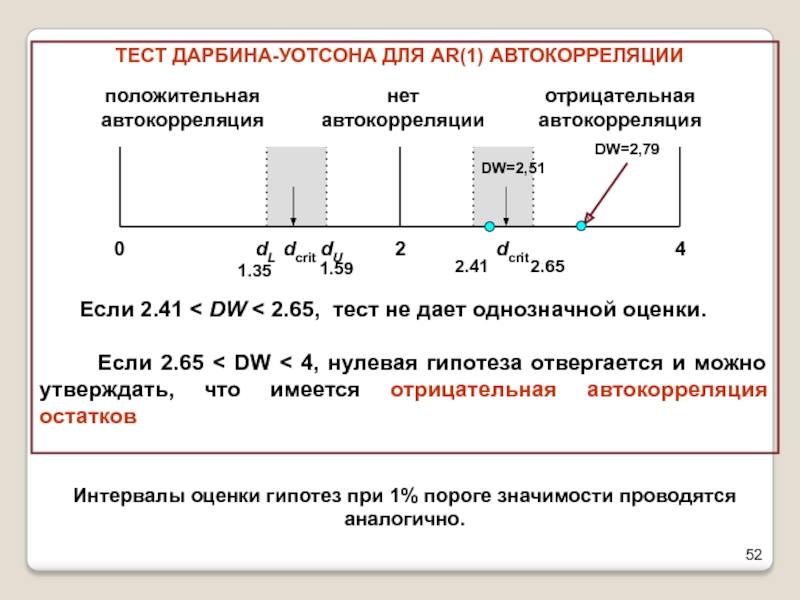

Если 2.41 < DW

< 2.65, тест не дает однозначной оценки.

Если 2.65 < DW < 4, нулевая гипотеза отвергается и можно утверждать, что имеется отрицательная автокорреляция остатковИнтервалы оценки гипотез при 1% пороге значимости проводятся аналогично.

ТЕСТ ДАРБИНА-УОТСОНА ДЛЯ AR(1) АВТОКОРРЕЛЯЦИИ

2

4

0

dL

dU

dcrit

положительная автокорреляция

отрицательная автокорреляция

нет автокорреляции

dcrit

1.35

1.59

2.41

2.65

DW=2,51

DW=2,79

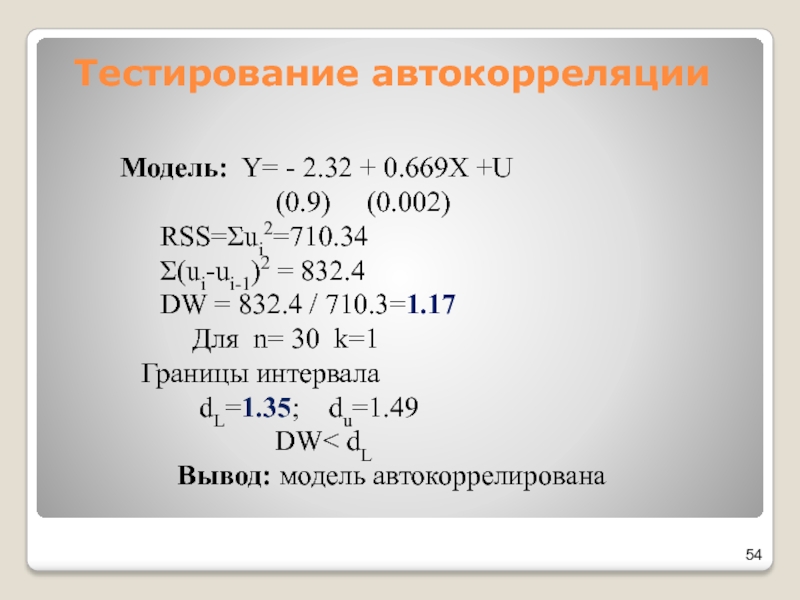

Слайд 54Тестирование автокорреляции

Модель: Y= - 2.32 + 0.669X +U

(0.9) (0.002)

RSS=Σui2=710.34

Σ(ui-ui-1)2 = 832.4

DW = 832.4 /

710.3=1.17Для n= 30 k=1

Границы интервала

dL=1.35; du=1.49

DW< dL

Вывод: модель автокоррелирована

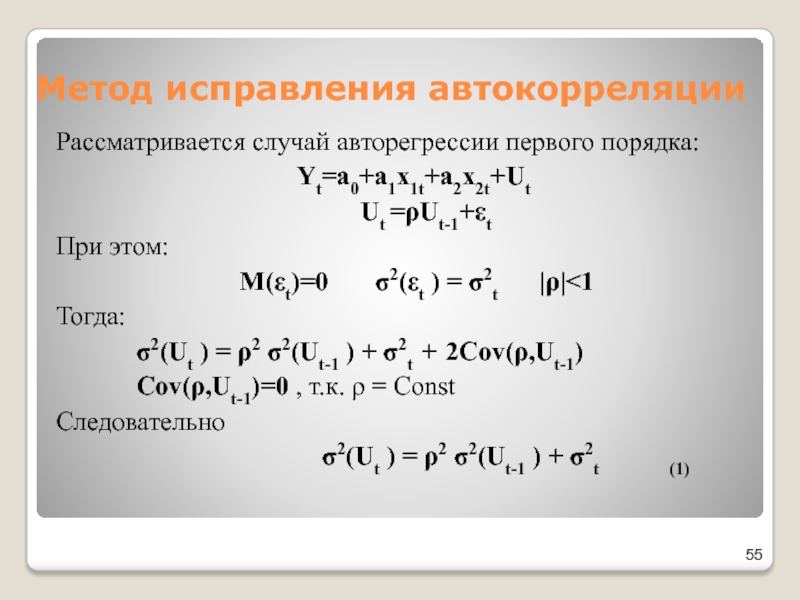

Слайд 55Метод исправления автокорреляции

Рассматривается случай авторегрессии первого порядка:

Yt=a0+a1x1t+a2x2t+Ut

Ut =ρUt-1+εt

При

этом:

M(εt)=0 σ2(εt ) = σ2t |ρ|

σ2(Ut ) = ρ2 σ2(Ut-1 ) + σ2t + 2Cov(ρ,Ut-1)

Cov(ρ,Ut-1)=0 , т.к. ρ = Const

Следовательно

σ2(Ut ) = ρ2 σ2(Ut-1 ) + σ2t (1)

Слайд 56Метод исправления автокорреляции

Множитель (1-ρ2) обеспечивает стационарность σ2(Ut), т.е. постоянство σ2(Ut)

(2)

σ2(Ut ) = ρ2 σ2(Ut-1 ) + σ2t

Т.к. U0 отсутствует, полагаем, что σ2(U1) =σ2(U0)

Тогда из (1) следует:

Выражение (2) – начальное условие для σ2(U0)

Из выражения (1) с учетом (2) вытекает:

(1)

Слайд 57Для произвольного наблюдения t в силу рекурентности (1) имеем:

(3)

Вывод: введение

корректирующего множителя (1-ρ2) обеспечивает постоянство σ2(u) во всех наблюдениях и,

следовательно, отсутствие автокорреляции между случайными возмущениями.Слайд 58Метод устранения автокорреляции

Рассмотрим два последовательных уравнения наблюдения

(4)

(5)

Умножим уравнение (5) на

ρ и вычтем из (4)

Учитывая, что Ut - ρUt-1= εt

и делая замену переменных получим систему уравнений, в которых дисперсия случайных возмущений постоянна.

(6)

Слайд 59Метод устранения автокорреляции

Параметры уравнения (6) можно оценить с помощью МНК.

Если значение ρ известно, то решение окончено.

Замечание. Уравнение (6) имеет

смысл при t = 2, т.к. при t=1 оно не может быть получено.Для включения первого уравнения наблюдений в систему (6) его умножают на (1-ρ)½.

Этот множитель (поправка Прайса-Уинстона) обеспечивает уменьшение влияния первого уравнения на все остальные при ρ близких к единице.

Тогда окончательно система уравнений наблюдений принимает вид:

Слайд 60УСТРАНЕНИЕ AR(1) АВТОКОРРЕЛЯЦИИ

Автокорреляция AR(1) может быть устранена в лаговых моделях.

Для этого нужно множить уравнение для yt-1 на ρ и

вычесть из yt. Случайный член et, (инновация) не является автокоррелированным. Проблема автокорреляции устранена.Есть только одна проблема: нелинейность лаговой модели относительно xt-2. В силу этого обычный МНК не применим из за конфликта параметров (0,5*0,8 ≠ 0,6).

Проблема может быть решена численными методами подбора параметров.

Слайд 61УСТРАНЕНИЕ AR(1) АВТОКОРРЕЛЯЦИИ

Аналогично устраняется влияние автокорреляции в множественной регрессионной модели.

Вновь получаем нелинейную лаговую модель свободную от автокорреляции.

Слайд 624

Метод решения состоит в оценке и последовательном уточнении коэффициента корреляции

ρ. Модель может быть преобразована к (*) свободной от автокорреляции

модели. Если автокорреляция AR(1) типа, то CORR(et, et-1) ≈ CORR(ut, ut-1). Используя это ρ, можно вычислить коэффициенты α’ и β для модели (*) и вновь провести оценку ρ.ИТЕРАТИВНАЯ ПРОЦЕДУРА КОКРАНА - ОРКАТТА

Слайд 63

1. Построить регрессию yt от xt используя МНК

2. Вычислить et = yt

- a - bxt и найти с помощью регрессии et

от et-1 оценку r.3. Вычислить yt и xt и найти регрессию yt от xt по которой определить оценки для a и b. Повторить с шага 2 до выполнения сходимости.

Сходимость алгоритма достигается когда оценка коэффициента корреляции будет изменяться на величину меньшую заданной точности.

ИТЕРАТИВНАЯ ПРОЦЕДУРА КОКРАНА - ОРКАТТА

~

~

~

~

Слайд 64Устранение автокорреляции первого порядка (при известном коэффициенте автокорреляции)

Пусть имеем:

(

известно)

Процедура устранения автокорреляции остатков:

Отсюда:

Проблема потери первого наблюдения преодолевается с помощью

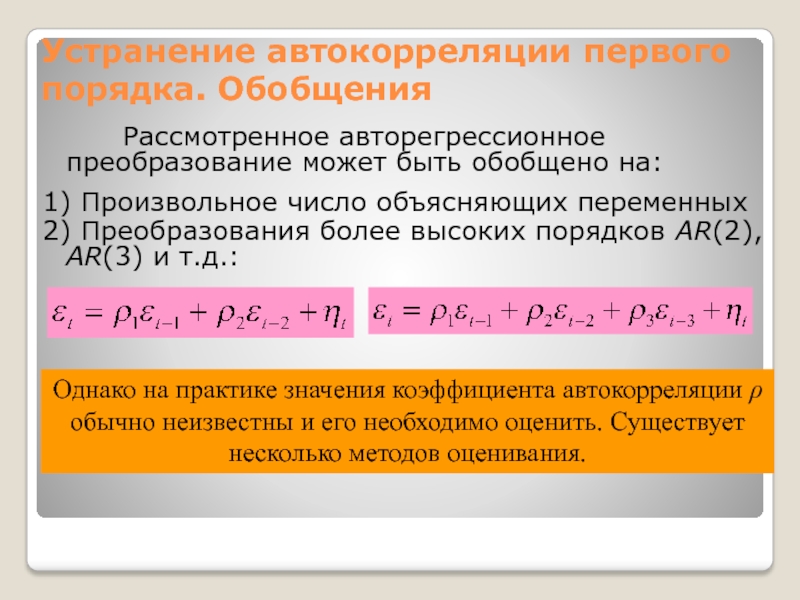

поправки Прайса-Винстена:Слайд 65Устранение автокорреляции первого порядка. Обобщения

Рассмотренное авторегрессионное преобразование может быть обобщено

на:

1) Произвольное число объясняющих переменных

2) Преобразования более высоких порядков AR(2),

AR(3) и т.д.:Однако на практике значения коэффициента автокорреляции обычно неизвестны и его необходимо оценить. Существует несколько методов оценивания.

Слайд 66Способы оценивания коэффициента автокорреляции

1. На основе статистики Дарбина-Уотсона.

2.

Процедура Кохрейна-Оркатта.

3. Процедура Хилдрета-Лу.

4. Процедура Дарбина

5. Метод первых разностей.

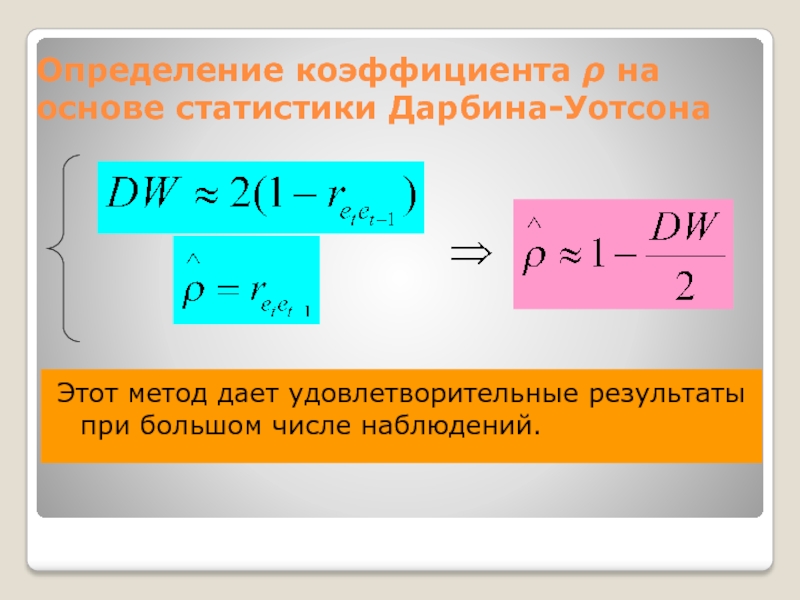

Слайд 67Определение коэффициента на основе статистики Дарбина-Уотсона

Этот метод дает удовлетворительные

результаты при большом числе наблюдений.

Слайд 68Итеративная процедура Кохрейна-Оркатта (на примере парной регрессии)

1. Определение уравнения регрессии

и вектора остатков:

2. В качестве приближенного значения берется

его МНК-оценка:3. Для найденного * оцениваются коэффициенты 0 1:

4. Подставляем в (*) и вычисляем

Возвращаемся к этапу 2.

Критерий остановки: разность между текущей и предыдущей оценками * стала меньше заданной точности.

Слайд 69Итеративная процедура Хилдрета-Лу

(поиск по сетке)

1. Определение уравнения регрессии и

вектора остатков:

2. Оцениваем регрессию

для каждого возможного значения [1,1] с некоторым

достаточно

малым шагом, например 0,001; 0,01 и т.д.3. Величина *, обеспечивающая минимум стандартной ошибки регрессии принимается в качестве оценки автокорреляции остатков.

Слайд 70Итеративные процедуры оценивания коэффициента . Выводы

1. Сходимость процедур достаточно хорошая.

2.

Метод Кохрейна-Оркатта может «попасть» в локальный, а не глобальный минимум.

3.

Время работы процедуры Хилдрета-Лу значительно сокращается при наличии априорной информации об области возможных значений .Слайд 72Процедура Дарбина представляет собой традиционный МНК с нелинейными ограничениями типа

равенств:

Способы решения:

1. Решать задачу нелинейного программирования.

2. Двухшаговый МНК Дарбина (полученный

коэффициент автокорреляции используется в поправке Прайса-Винстена).3. Итеративная процедура расчета.

Процедура Дарбина

(на примере парной регрессии)

Слайд 73Процедура Дарбина

Ограничения на коэффициенты записываются в явном виде

============================================================

Dependent Variable: LGHOUS

Method: Least Squares Sample(adjusted): 1960 2003

LGHOUS=C(1)*(1-C(2))+C(2)*LGHOUS(-1)+C(3)*LGDPI-C(2)*C(3)

*LGDPI(-1)+C(4)*LGPRHOUS-C(2)*C(4)*LGPRHOUS(-1)

============================================================

Coefficient Std. Error t-Statistic Prob.

============================================================

C(1) 0.154815 0.354989 0.436111 0.6651

C(2) 0.719102 0.115689 6.215836 0.0000

C(3) 1.011295 0.021830 46.32641 0.0000

C(4) -0.478070 0.091594 -5.219436 0.0000

============================================================

R-squared 0.999205 Mean dependent var 6.379059

Adjusted R-squared 0.999145 S.D. dependent var 0.421861

S.E. of regression 0.012333 Akaike info criter-5.866567

Sum squared resid 0.006084 Schwarz criterion -5.704368

Log likelihood 133.0645 Durbin-Watson stat 1.901081

============================================================

Слайд 74

============================================================

Dependent Variable: LGHOUS

Method:

Least Squares Sample(adjusted): 1960 2003Included observations: 44 after adjusting endpoints

Convergence achieved after 21 iterations

============================================================

Variable Coefficient Std. Error t-Statistic Prob.

============================================================

C 0.154815 0.354989 0.436111 0.6651

LGDPI 1.011295 0.021830 46.32642 0.0000

LGPRHOUS -0.478070 0.091594 -5.219437 0.0000

AR(1) 0.719102 0.115689 6.215836 0.0000

============================================================

R-squared 0.999205 Mean dependent var 6.379059

Adjusted R-squared 0.999145 S.D. dependent var 0.421861

S.E. of regression 0.012333 Akaike info criter-5.866567

Sum squared resid 0.006084 Schwarz criterion -5.704368

Log likelihood 133.0645 F-statistic 16757.24

Durbin-Watson stat 1.901081 Prob(F-statistic) 0.000000

============================================================

Либо в список регрессоров включается авторегриссионный член 1 порядка AR(1)

Процедура Дарбина

Слайд 75

=============================================================

Dependent Variable: LGHOUS

LGHOUS=C(1)*(1-C(2))+C(2)*LGHOUS(-1)+C(3)*LGDPI-C(2)*C(3)

*LGDPI(-1)+C(4)*LGPRHOUS-C(2)*C(4)*LGPRHOUS(-1) ============================================================

Coefficient Std. Error t-Statistic Prob.

============================================================

C(1) 0.154815 0.354989 0.436111 0.6651

C(2) 0.719102 0.115689 6.215836 0.0000

C(3) 1.011295 0.021830 46.32641 0.0000

C(4) -0.478070 0.091594 -5.219436 0.0000

============================================================

============================================================

Variable Coefficient Std. Error t-Statistic Prob.

============================================================

C 0.154815 0.354989 0.436111 0.6651

LGDPI 1.011295 0.021830 46.32642 0.0000

LGPRHOUS -0.478070 0.091594 -5.219437 0.0000

AR(1) 0.719102 0.115689 6.215836 0.0000

============================================================

Процедура Дарбина

Слайд 76Итеративная процедура метода Дарбина

1. Считается регрессия и находятся остатки.

2. По

остаткам находят оценку коэффициента автокорреляции остатков.

3. Оценка коэффициента автокорреляции

используется для

пересчета данных и циклповторяется.

Процесс останавливается, как только

обеспечивается достаточная точность (результаты перестают существенно улучшаться).

Слайд 77Обобщенный метод наименьших квадратов. Замечания

1. Значимый коэффициент DW может указывать

просто на ошибочную спецификацию.

2. Последствия автокорреляции остатков иногда бывают незначительными.

3.

Качество оценок может снизиться из-за уменьшения числа степеней свободы (нужно оценивать дополнительный параметр).4. Значительно возрастает трудоемкость расчетов.

Не следует применять обобщенный МНК автоматически